Microsoft DeBERTa supera i gracili umani nel test di comprensione della lettura di SuperGlue

2 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

Recentemente sono stati compiuti enormi progressi nelle reti di formazione con milioni di parametri. Microsoft ha recentemente aggiornato il modello DeBERTa (Decoding-enhanced BERT with disentangled attention) addestrando una versione più grande che consiste in 48 strati Transformer con 1.5 miliardi di parametri. Il significativo aumento delle prestazioni fa sì che il singolo modello DeBERTa superi per la prima volta le prestazioni umane sull'elaborazione e la comprensione del linguaggio SuperGLUE in termini di punteggio macro-medio (89.9 contro 89.8), superando di un discreto margine la linea di base umana (90.3 contro 89.8) . Il benchmark SuperGLUE consiste in un'ampia gamma di attività di comprensione del linguaggio naturale, tra cui la risposta alle domande e l'inferenza del linguaggio naturale. Il modello si trova anche in cima alla classifica dei benchmark GLUE con un punteggio medio macro di 90.8.

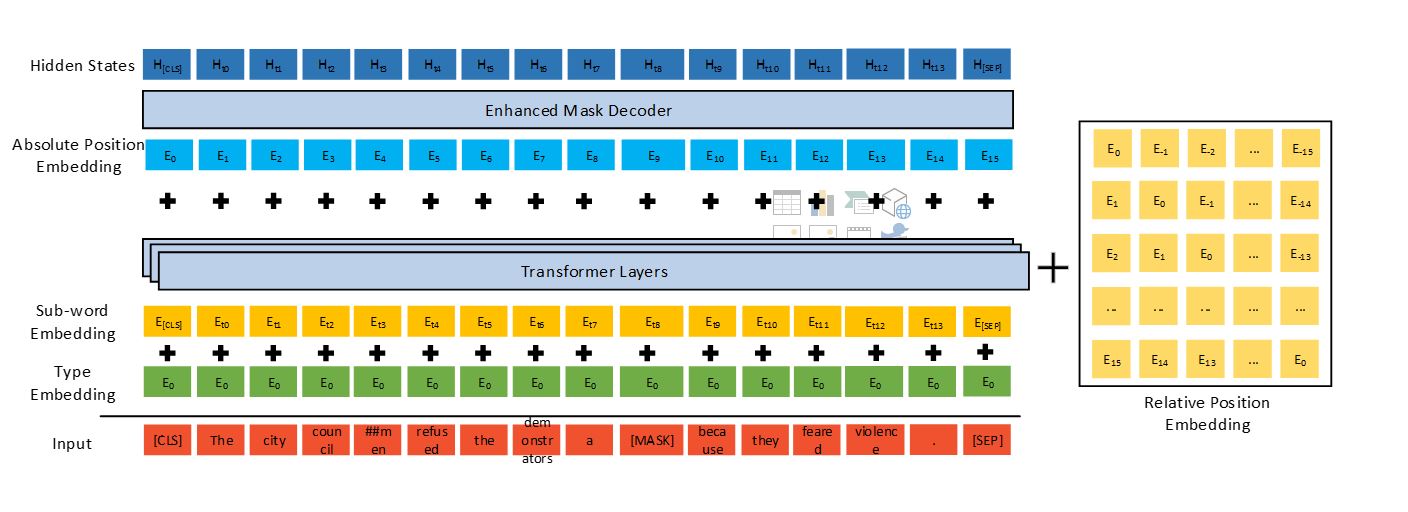

DeBERTa migliora i precedenti PLM all'avanguardia (ad esempio, BERT, RoBERTa, UniLM) utilizzando tre nuove tecniche: un meccanismo di attenzione districato, un decodificatore maschera potenziato e un metodo di addestramento del contraddittorio virtuale per la messa a punto.

Rispetto al modello T5 di Google, che consiste in 11 miliardi di parametri, DeBERTa da 1.5 miliardi di parametri è molto più efficiente dal punto di vista energetico da addestrare e mantenere ed è più facile da comprimere e distribuire su app con varie impostazioni.

DeBERTa supera le prestazioni umane su SuperGLUE segna un'importante pietra miliare verso l'IA generale. Nonostante i suoi risultati promettenti su SuperGLUE, il modello non sta affatto raggiungendo l'intelligenza a livello umano di NLU. Gli esseri umani sono estremamente bravi a sfruttare le conoscenze apprese da diversi compiti per risolvere un nuovo compito con nessuna o poca dimostrazione specifica del compito.

Microsoft integrerà la tecnologia nella prossima versione del modello di rappresentazione in linguaggio naturale di Microsoft Turing, utilizzato in luoghi come Bing, Office, Dynamics e Azure Cognitive Services, alimentando un'ampia gamma di scenari che coinvolgono interazioni uomo-macchina e uomo-uomo tramite linguaggio naturale (come chatbot, raccomandazione, risposta alle domande, ricerca, assistenza personale, automazione dell'assistenza clienti, generazione di contenuti e altro). Inoltre, Microsoft rilascerà al pubblico il modello DeBERTa da 1.5 miliardi di parametri e il codice sorgente.

Leggi tutti i dettagli su Microsoft qui.