A Microsoft DeBERTa felülmúlja az apró embereket a SuperGlue szövegértési tesztben

2 perc olvas

Publikálva

Olvassa el közzétételi oldalunkat, hogy megtudja, hogyan segítheti az MSPowerusert a szerkesztői csapat fenntartásában Tovább

A közelmúltban hatalmas előrelépés történt a több millió paramétert tartalmazó képzési hálózatok terén. A Microsoft a közelmúltban frissítette a DeBERTa (Decoding-enhanced BERT with disentangled attention) modellt egy nagyobb változat betanításával, amely 48 Transformer rétegből áll, 1.5 milliárd paraméterrel. A jelentős teljesítménynövekedés miatt az egyetlen DeBERTa-modell a SuperGLUE nyelvi feldolgozás és -értés terén először haladja meg az emberi teljesítményt a makroátlagos pontszámok tekintetében (89.9 versus 89.8), tisztességes különbséggel felülmúlva az emberi alapvonalat (90.3 versus 89.8). . A SuperGLUE benchmark természetes nyelv megértési feladatok széles skálájából áll, beleértve a kérdések megválaszolását, a természetes nyelvi következtetéseket. A modell a GLUE benchmark rangsor élén is áll 90.8-as makroátlaggal.

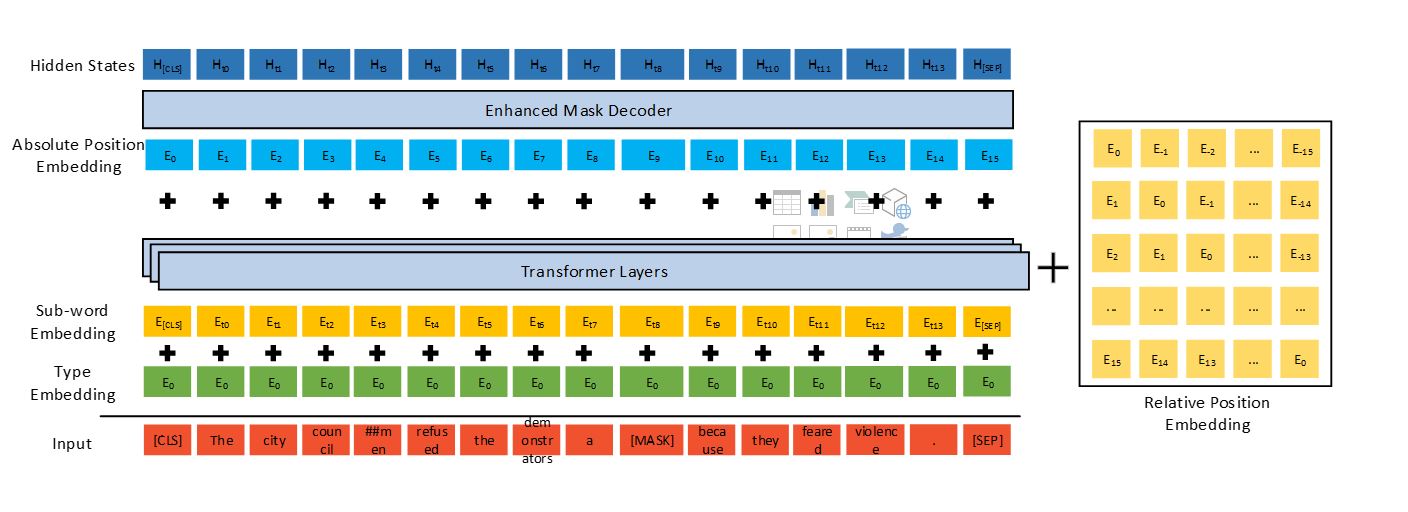

A DeBERTa három új technikával fejleszti a korábbi csúcstechnológiás PLM-eket (például BERT, RoBERTa, UniLM): egy szétválasztott figyelemmechanizmust, egy továbbfejlesztett maszkdekódert és egy virtuális ellenséges képzési módszert a finomhangoláshoz.

A Google 5 milliárd paraméterből álló T11 modelljéhez képest az 1.5 milliárd paraméterű DeBERTa sokkal energiahatékonyabb a betanítása és karbantartása során, valamint könnyebben tömöríthető és telepíthető különféle beállításokkal rendelkező alkalmazásokba.

A DeBERTa, hogy felülmúlja az emberi teljesítményt a SuperGLUE-n, fontos mérföldkövet jelent az általános mesterséges intelligencia felé. A SuperGLUE-n elért ígéretes eredményei ellenére a modell semmiképpen sem éri el az NLU emberi szintű intelligenciáját. Az emberek rendkívül jól tudják hasznosítani a különböző feladatokból tanult ismereteket egy új feladat megoldására anélkül, hogy a feladatspecifikus demonstrációt, vagy csak csekély mértékben.

A Microsoft integrálja a technológiát a Microsoft Turing természetes nyelvű reprezentációs modelljének következő verziójába, amelyet olyan helyeken használnak, mint a Bing, az Office, a Dynamics és az Azure Cognitive Services, és az ember-gép és ember-ember interakciókat is magában foglaló forgatókönyvek széles skáláját hajtja végre. természetes nyelv (például chatbot, ajánlás, kérdések megválaszolása, keresés, személyes segítségnyújtás, ügyfélszolgálati automatizálás, tartalomgenerálás stb.). Emellett a Microsoft nyilvánosságra hozza az 1.5 milliárd paraméterű DeBERTa modellt és a forráskódot.

Olvasson el minden részletet a Microsoftnál itt.