Microsoft i NVIDIA najavljuju najveći i najsnažniji jezični model obučen do sada

1 min. čitati

Objavljeno na

Pročitajte našu stranicu za otkrivanje kako biste saznali kako možete pomoći MSPoweruseru da održi urednički tim Čitaj više

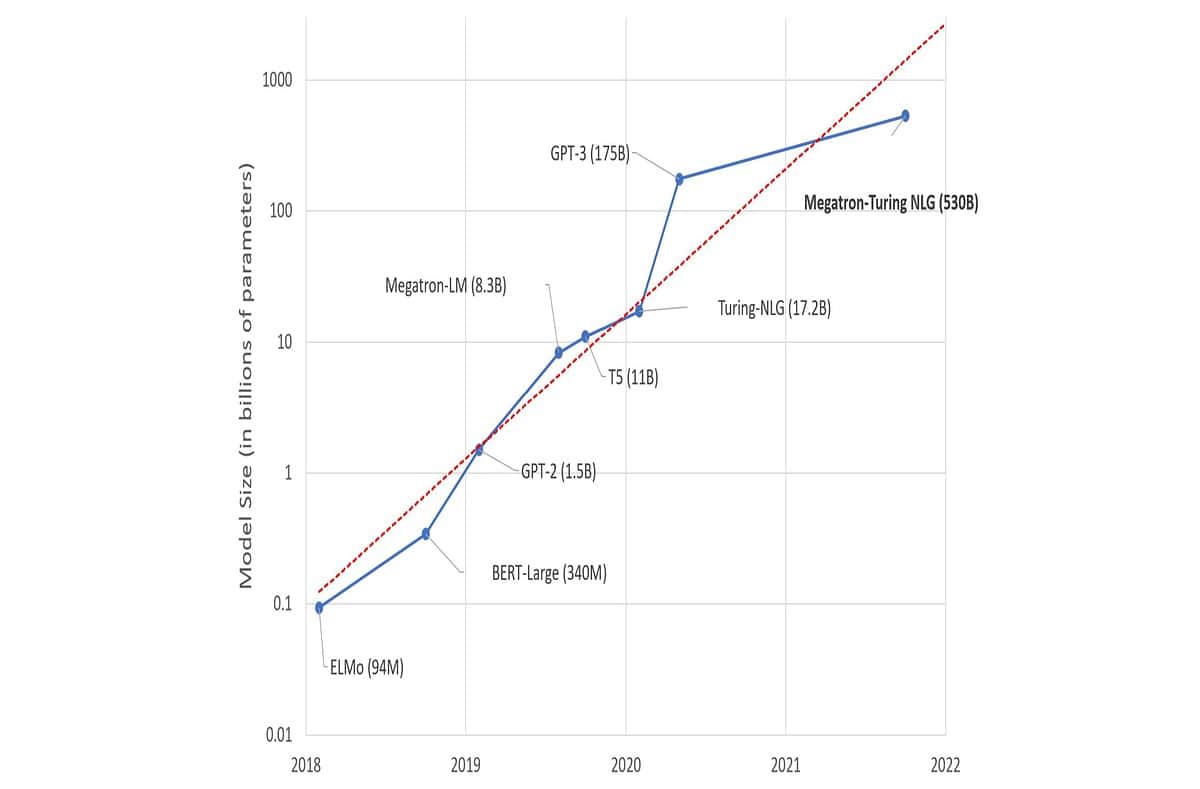

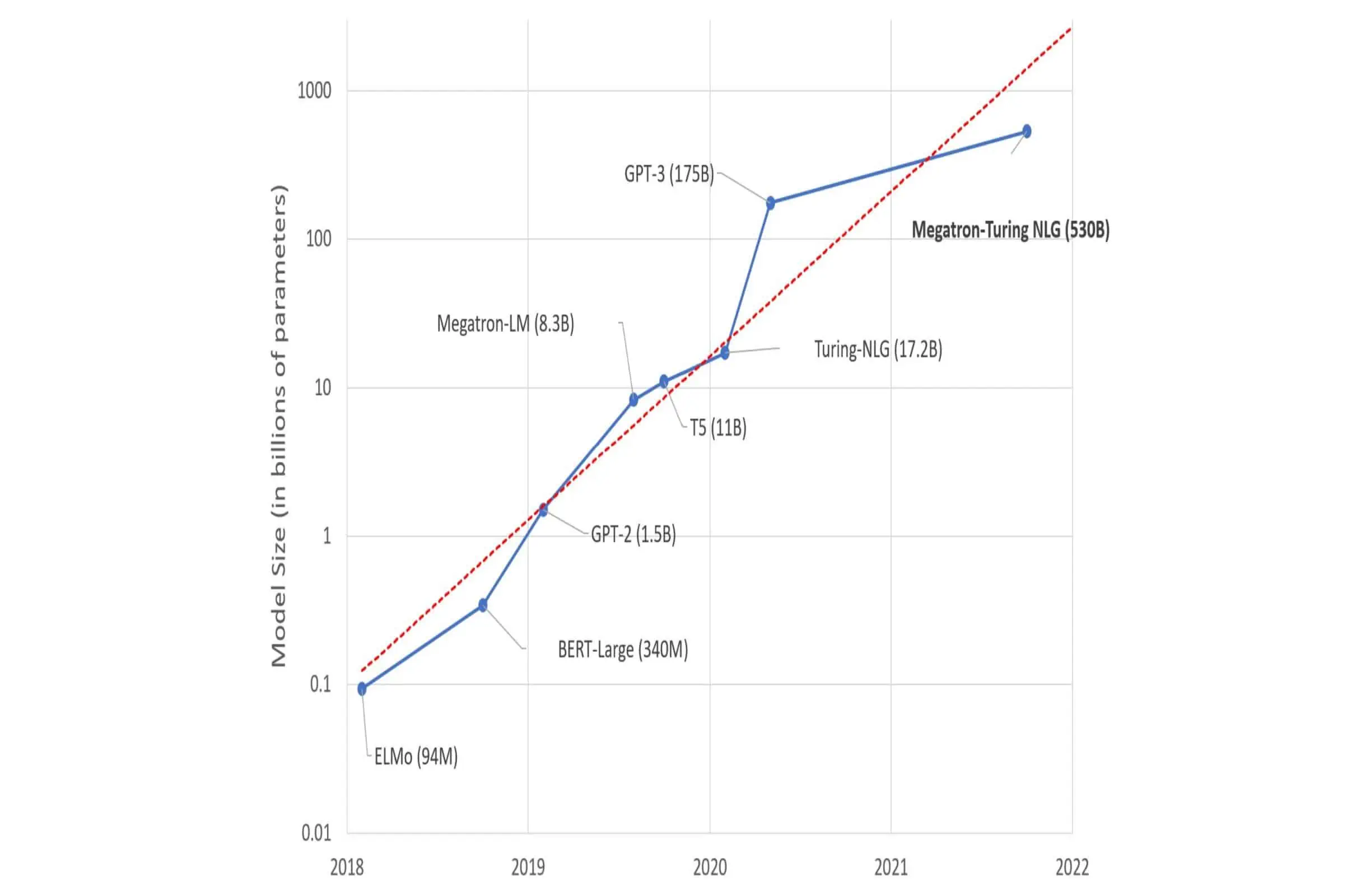

Microsoft i NVIDIA danas su najavili model generiranja prirodnog jezika Megatron-Turing (MT-NLG) koji pokreće DeepSpeed i Megatron, najveći i najsnažniji monolitni transformator jezični model koji je treniran do danas. Ovaj model uključuje 530 milijardi parametara, 3x veći broj parametara u odnosu na postojeći najveći model, GPT-3. Obuka tako velikog modela uključuje razne izazove. NVIDIA i Microsoft radili su na mnogim inovacijama i otkrićima duž svih AI osi.

Na primjer, blisko surađujući, NVIDIA i Microsoft postigli su neviđenu učinkovitost obuke konvergirajući najsuvremeniju infrastrukturu za obuku ubrzanu GPU-om s vrhunskim softverskim stogom za distribuirano učenje. Izgradili smo visokokvalitetne korpuse za obuku prirodnog jezika sa stotinama milijardi tokena i zajednički razvili recepte za obuku kako bismo poboljšali učinkovitost i stabilnost optimizacije.

Više o ovom projektu možete saznati na poveznicama u nastavku.