Microsoft predstavlja Phi-3 obitelj modela koji nadmašuju ostale modele svoje klase

2 min. čitati

Objavljeno na

Pročitajte našu stranicu za otkrivanje kako biste saznali kako možete pomoći MSPoweruseru da održi urednički tim Čitaj više

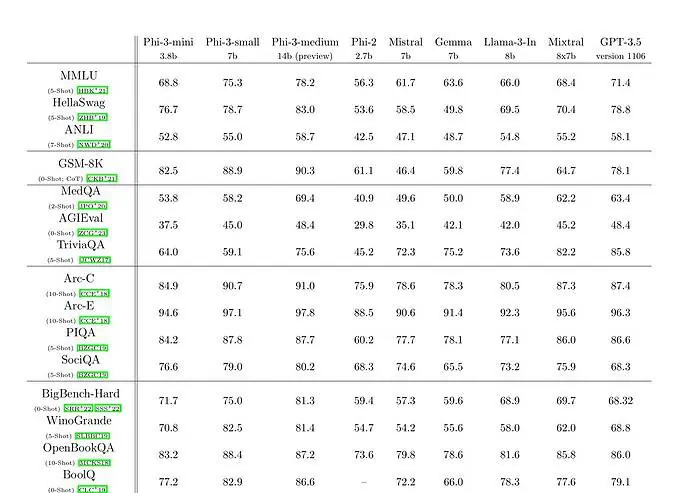

Još u prosincu 2023. Microsoft je objavio Phi-2 model s 2.7 milijardi parametara koji je pružio najsuvremeniju izvedbu među modelima osnovnog jezika s manje od 13 milijardi parametara. U posljednja četiri mjeseca, nekoliko drugih modela koji su pušteni nadmašili su Phi-2. Nedavno je Meta izdala Llama-3 obitelj modela koji su nadmašili sve prethodno objavljene open-source modele.

Sinoć je Microsoft Research najavio Phi-3 obitelj modela putem tehničko izvješće. U obitelji Phi-3 postoje tri modela:

- phi-3-mini (3.8B)

- fi-3-mali (7B)

- fi-3-srednji (14B)

Phi-3-mini s jezičnim modelom od 3.8 milijardi parametara trenira se na 3.3 trilijuna tokena. Prema mjerilima, phi-3-mini pobjeđuje Mixtral 8x7B i GPT-3.5. Microsoft tvrdi da je ovaj model dovoljno malen da se postavi na telefon. Microsoft je koristio smanjenu verziju skupa podataka koji je korišten za phi-2, sastavljen od jako filtriranih web podataka i sintetičkih podataka. Prema Microsoftovim referentnim rezultatima u Tehničkom dokumentu, phi-3-small i phi-3-medium postižu impresivan MMLU rezultat od 75.3 odnosno 78.2.

Što se tiče mogućnosti LLM-a, iako model Phi-3-mini postiže sličnu razinu razumijevanja jezika i sposobnosti zaključivanja kao i mnogo veći modeli, još uvijek je fundamentalno ograničen svojom veličinom za određene zadatke. Model jednostavno nema kapacitet za pohranu opsežnog činjeničnog znanja, što se može vidjeti, na primjer, u niskim performansama na TriviaQA. Međutim, vjerujemo da se ova slabost može riješiti proširenjem pomoću tražilice.