Microsoft Azure AI predstavlja 'Prompt Shields' za borbu protiv manipulacije LLM-a

2 min. čitati

Objavljeno na

Pročitajte našu stranicu za otkrivanje kako biste saznali kako možete pomoći MSPoweruseru da održi urednički tim Čitaj više

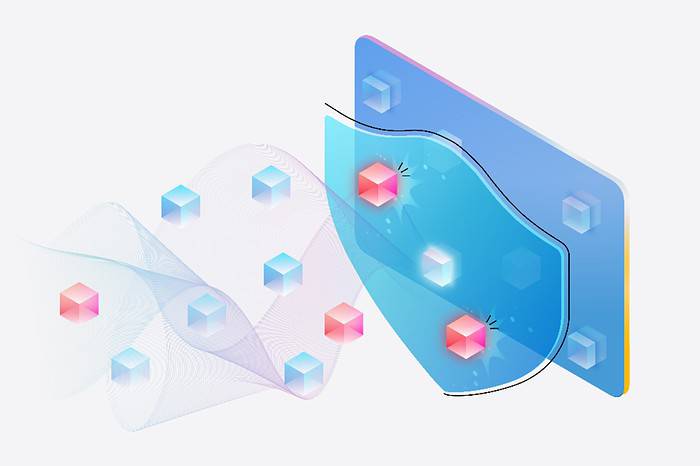

Microsoft danas najavio veliko sigurnosno poboljšanje za svoje platforme Azure OpenAI Service i Azure AI Content Safety. Nazvana "Prompt Shields", nova značajka nudi robusnu obranu od sve sofisticiranijih napada usmjerenih na velike jezične modele (LLM).

Prompt Shields štiti od:

- Izravni napadi: Također poznati kao napadi bjekstvom iz zatvora, ovi pokušaji izričito upućuju LLM da zanemari sigurnosne protokole ili izvrši zlonamjerne radnje.

- Neizravni napadi: Ovi napadi suptilno ugrađuju štetne upute unutar naizgled normalnog teksta, s ciljem da LLM-a navedu na neželjeno ponašanje.

Prompt Shields integriran je s filtrima sadržaja Azure OpenAI Service i dostupan je u Azure AI Content Safety. Zahvaljujući naprednim algoritmima strojnog učenja i obradi prirodnog jezika, Prompt Shields može identificirati i neutralizirati potencijalne prijetnje u korisničkim upitima i podacima trećih strana.

Spotlighting: Nova obrambena tehnika

Microsoft je također predstavio "Spotlighting", specijalizirani brzi inženjerski pristup osmišljen za sprječavanje neizravnih napada. Tehnike osvjetljavanja, kao što su razgraničenje i označavanje podataka, pomažu LLM-u da jasno razlikuje legitimne upute od potencijalno štetnih ugrađenih naredbi.

Dostupnost

Prompt Shields trenutno je u javnom pregledu kao dio Azure AI Content Safety i bit će dostupan unutar Azure OpenAI usluge 1. travnja. Integracija u Azure AI Studio planira se u bliskoj budućnosti.