Stability AI lance Stable LM 2 1.6B qui surpasse le modèle Phi-2 2.7B de Microsoft

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Les petits modèles de langage (SLM) deviennent très populaires de nos jours. Depuis l'année dernière, Microsoft Research a été libération une suite de petits modèles de langage (SLM) appelés « Phi ». En décembre, Microsoft Research a publié Modèle Phi-2 avec 2.7 milliards de paramètres. Ce nouveau modèle offre des performances de pointe parmi les modèles de langage de base avec moins de 13 milliards de paramètres.

Aujourd'hui, Stability AI annoncé la sortie de Stable LM 2 1.6B, un petit modèle linguistique de pointe de 1.6 milliard de paramètres formé sur des données multilingues en anglais, espagnol, allemand, italien, français, portugais et néerlandais.

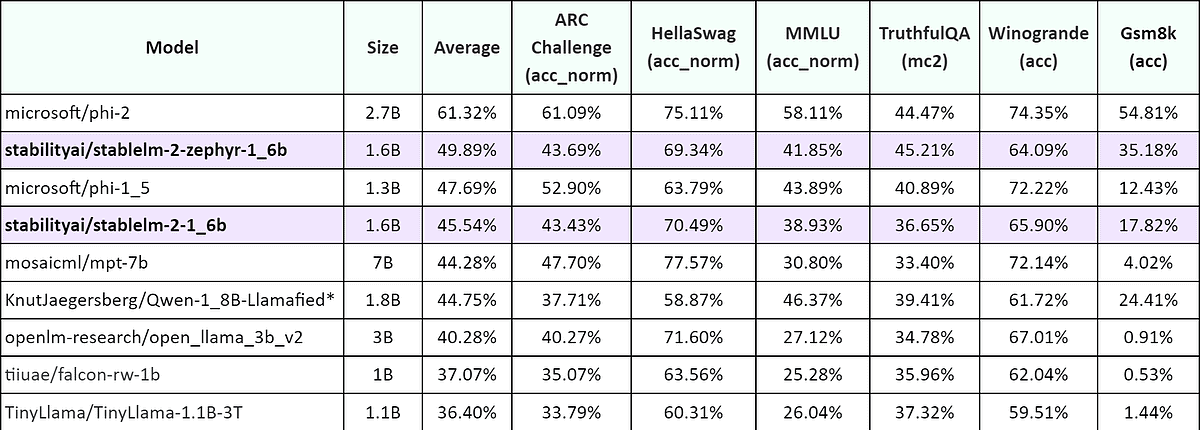

Comparé à d'autres modèles de petits langages populaires tels que Phi-1.5 (1.3B) et Phi-2 (2.7B) de Microsoft, TinyLlama 1.1B ou Falcon 1B, Stable LM 2 1.6B fonctionne mieux sur la plupart des tâches. Vous pouvez consulter les données de référence ci-dessous.

Étant donné que ce modèle est également entraîné sur du texte multilingue, il surpasse considérablement les autres modèles comparables en termes de versions traduites d'ARC Challenge, HellaSwag, TruthfulQA, MMLU et LAMBADA.

"En publiant l'un des petits modèles de langage les plus puissants à ce jour et en fournissant une transparence totale sur les détails de sa formation, nous visons à permettre aux développeurs et aux créateurs de modèles d'expérimenter et d'itérer rapidement", a écrit l'équipe Stability AI.

Le modèle stable LM 2 1.6B est désormais disponible à la fois commercialement et non commercialement avec un Adhésion à Stability AI. Vous pouvez découvrir le modèle sur Étreindre le visage maintenant.