Le modèle Phi-2 2.7B de Microsoft surpasse le modèle Google Gemini Nano-2 3.2B récemment annoncé

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

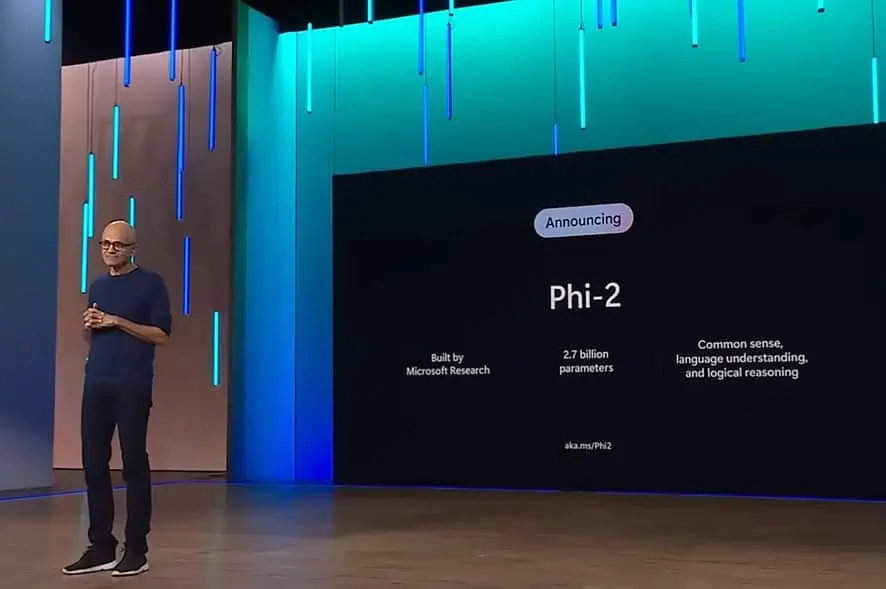

Au cours des derniers mois, Microsoft Research a publié une suite de petits modèles de langage (SLM) appelée « Phi ». Le Phi-1 a été lancé pour la première fois avec 1.3 milliard de paramètres et était spécialisé pour le codage Python de base. En septembre, Microsoft Research libéré Modèle Phi-1.5 avec 1.3 milliard de paramètres, mais il a été formé avec une nouvelle source de données comprenant divers textes synthétiques PNL. Malgré sa petite taille, le phi-1.5 offrait des performances presque à la pointe de la technologie, comparables à d'autres modèles de taille similaire.

Aujourd'hui, Microsoft a annoncé la sortie du modèle Phi-2 avec 2.7 milliards de paramètres. Microsoft Research affirme que ce nouveau SLM offre des performances de pointe parmi les modèles de langage de base comportant moins de 13 milliards de paramètres. Sur certains benchmarks complexes, le Phi-2 correspond ou surpasse des modèles jusqu'à 25 fois plus grands.

La semaine dernière, Google annoncé Suite Gemini de modèles de langage. Le Gemini Nano est le modèle le plus efficace de Google conçu pour les tâches sur appareil et il peut fonctionner directement sur le silicium mobile. Le petit modèle de langage de type Gemini Nano permet des fonctionnalités telles que le résumé de texte, les réponses intelligentes contextuelles et la relecture avancée et la correction grammaticale.

Selon Microsoft, le nouveau modèle Phi-2 correspond ou surpasse le nouveau Google Gemini Nano-2, bien qu'il soit de plus petite taille. Vous pouvez trouver ci-dessous la comparaison des benchmarks entre les modèles Google Gemini Nano-2 et Phi-2.

| Modèle | Taille | BBH | BoolQ | MBPP | MMLU |

|---|---|---|---|---|---|

| Gémeaux Nano 2 | 3.2M | 42.4 | 79.3 | 27.2 | 55.8 |

| Phi-2 | 2.7M | 59.3 | 83.3 | 59.1 | 56.7 |

En plus de surpasser Gemini Nano-2, Phi-2 surpasse également les performances des modèles Mistral et Llama-2 aux paramètres 7B et 13B sur divers benchmarks. Retrouvez les détails ci-dessous.

| Modèle | Taille | BBH | Bon sens Raisonnement | Connection Linguistique LUMIÈRE SUR NOS | Mathématique | Codage |

|---|---|---|---|---|---|---|

| Lama-2 | 7B | 40.0 | 62.2 | 56.7 | 16.5 | 21.0 |

| 13M | 47.8 | 65.0 | 61.9 | 34.2 | 25.4 | |

| 70M | 66.5 | 69.2 | 67.6 | 64.1 | 38.3 | |

| Mistral | 7B | 57.2 | 66.4 | 63.7 | 46.4 | 39.4 |

| Phi-2 | 2.7M | 59.2 | 68.8 | 62.0 | 61.1 | 53.7 |

Alors que les deux modèles phi précédents étaient disponibles sur Hugging Face, Phi-2 a été mis à disposition sur le catalogue de modèles Azure. Vous pouvez en savoir plus sur Phi-2 ici.