Microsoft et NVIDIA annoncent le plus grand et le plus puissant modèle de langage formé à ce jour

1 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

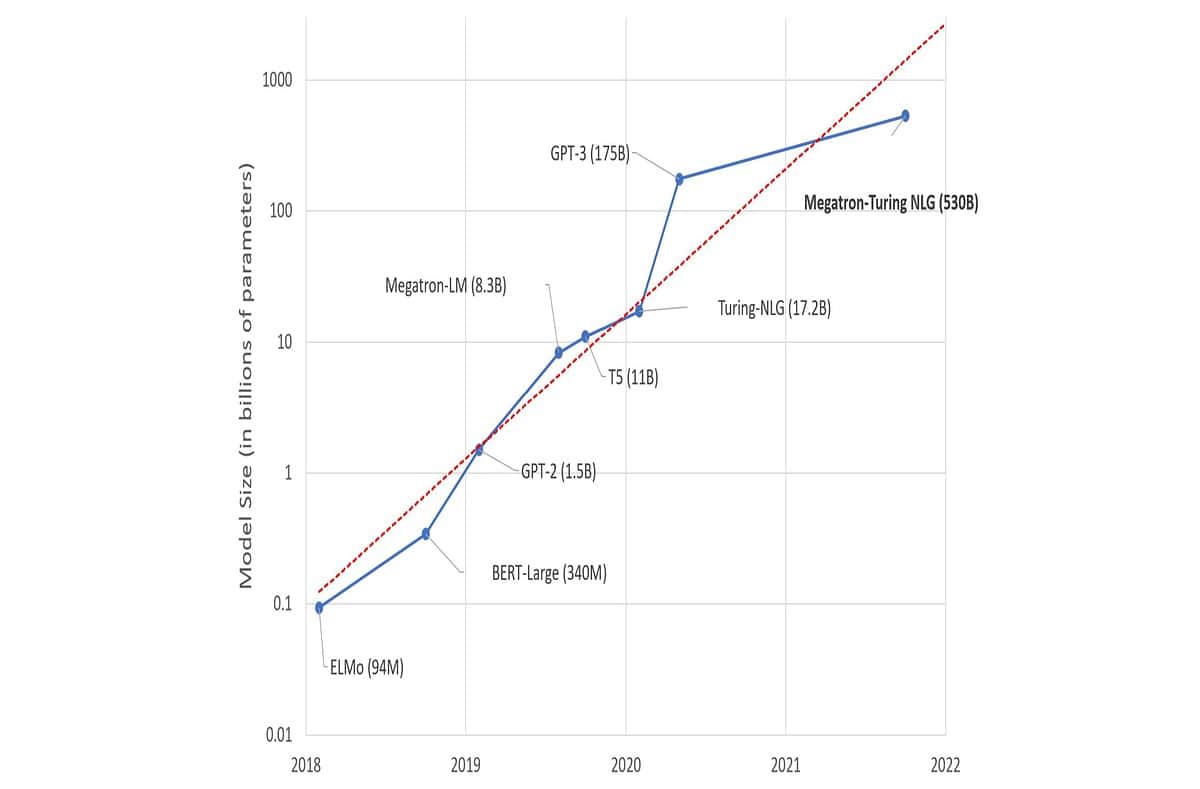

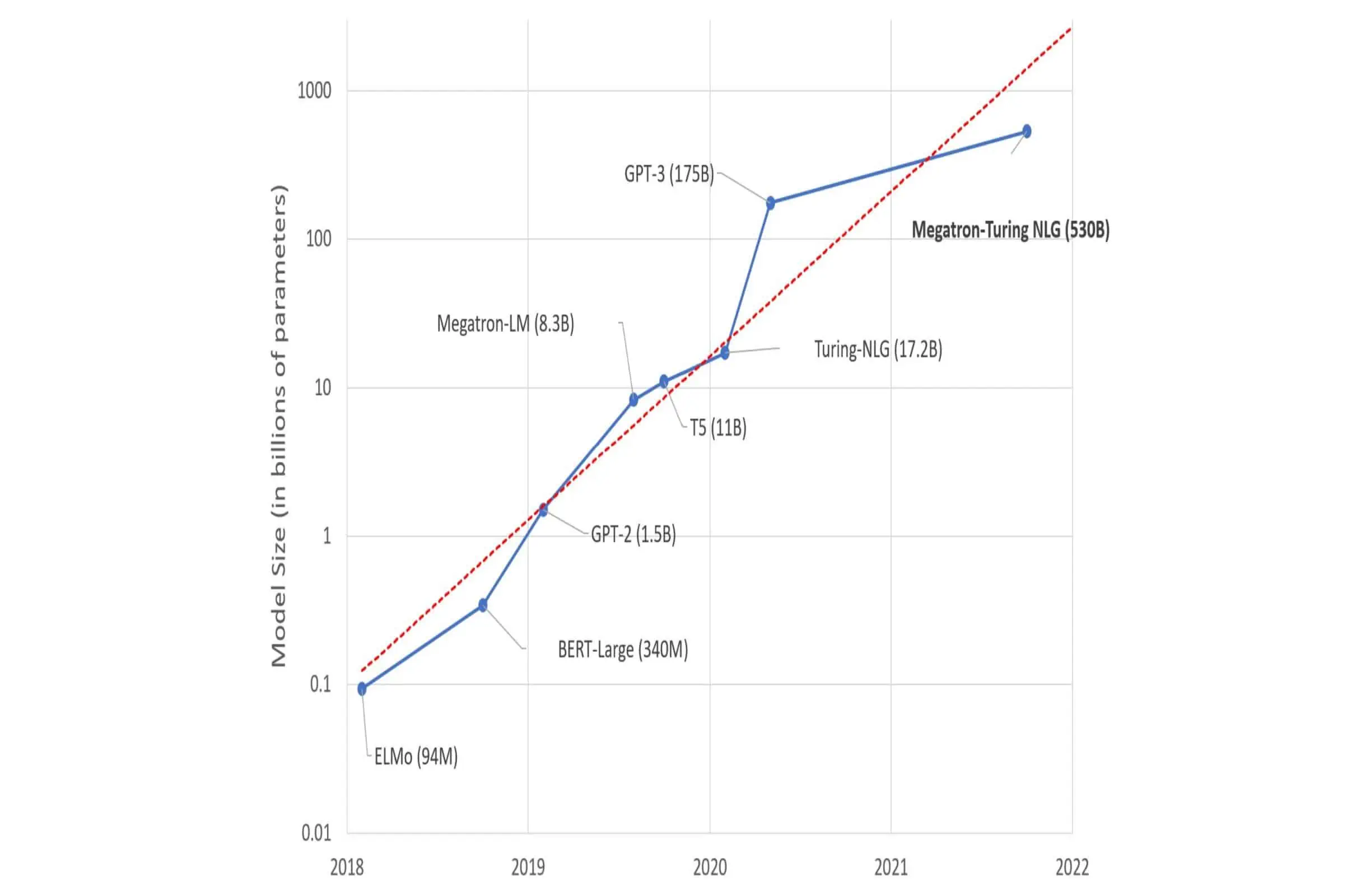

Microsoft et NVIDIA ont annoncé aujourd'hui le modèle de génération de langage naturel Megatron-Turing (MT-NLG) alimenté par DeepSpeed et Megatron, le plus grand et le plus puissant modèle de langage de transformateur monolithique formé à ce jour. Ce modèle comprend 530 milliards de paramètres, soit 3 fois le nombre de paramètres par rapport au plus grand modèle existant, GPT-3. La formation d'un si grand modèle implique divers défis. NVIDIA et Microsoft ont travaillé sur de nombreuses innovations et percées sur tous les axes de l'IA.

Par exemple, en travaillant en étroite collaboration, NVIDIA et Microsoft ont atteint une efficacité de formation sans précédent en faisant converger une infrastructure de formation accélérée par GPU à la pointe de la technologie avec une pile logicielle d'apprentissage distribué de pointe. Nous avons construit des corpus de formation en langage naturel de haute qualité avec des centaines de milliards de jetons, et co-développé des recettes de formation pour améliorer l'efficacité et la stabilité de l'optimisation.

Vous pouvez en savoir plus sur ce projet à partir des liens ci-dessous.