Les deepfakes générés par l'IA ont tellement irrité Microsoft qu'il appelle le Congrès à agir

Microsoft souhaite que le Congrès promulgue une loi sur la fraude deepfake pour établir un cadre juridique spécifique.

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus.

Notes clés

- Microsoft exhorte le Congrès à créer des cadres juridiques pour les deepfakes et la fraude générés par l'IA.

- Ils recommandent des lois sur la fraude deepfake, un étiquetage clair du contenu synthétique et de meilleurs contrôles de sécurité.

- Une législation récente autorise les poursuites pour deepfakes explicites, et des personnalités notables comme Taylor Swift ont été victimes de ce type de contenu.

Alors que l’intelligence artificielle (IA) se développe à une vitesse vertigineuse, les deepfakes générés par l’IA se développent également. Microsoft, l'un des plus grands acteurs dans la course à l'IA, appelle désormais le Congrès à relever ces défis.

Brad Smith, vice-président et président de Microsoft, a déclaré dans un récent Microsoft sur la question blog récents que la société de Redmond recommande plusieurs actions clés. L’une d’elles consiste à promulguer une loi sur la fraude deepfake afin d’établir un cadre juridique spécifique qui poursuivra les fraudes et les escroqueries générées par l’IA.

« Même s'il est impératif que l'industrie technologique ait une place à la table, elle doit le faire avec humilité et en faveur de l'action. Microsoft accueille favorablement les idées supplémentaires des parties prenantes de l'écosystème numérique pour lutter contre les dommages causés par les contenus synthétiques », dit-il.

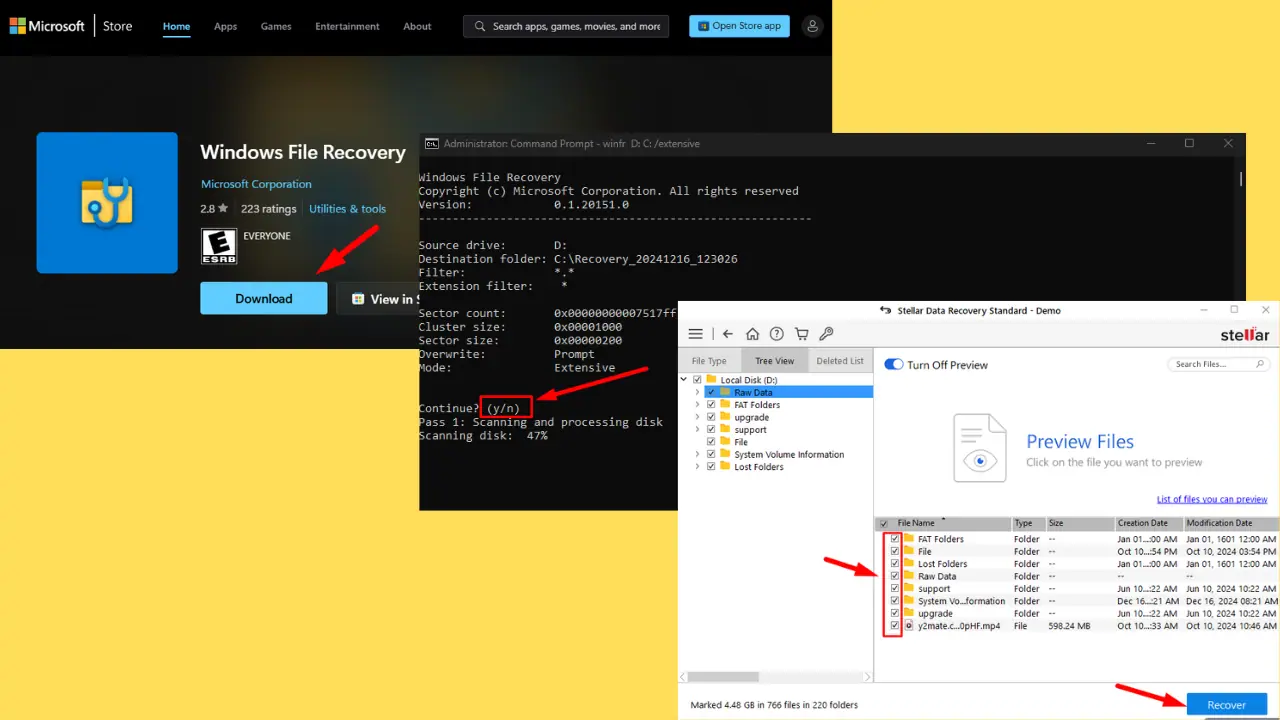

Une législation récente autorise les victimes de deepfakes explicites et non consensuelles à poursuivre leurs créateurs en justice, mais Microsoft estime que d'autres mesures, telles que la transparence étiquetage du contenu synthétique-semblable à « Fabriqué avec l'IA » de Meta– et des contrôles de sécurité améliorés pour les produits d’IA sont essentiels pour protéger le public.

Plus tôt cette année, un nouveau projet de loi présenté par les sénateurs Durbin, Graham et Hawley permettrait aux victimes de deepfakes sexuellement explicites de poursuivre leurs créateurs et distributeurs. Il qualifie ces deepfakes de « contrefaçons numériques » et fixe un délai de prescription de 10 ans.

La montée des deepfakes générés par l’IA est en effet horrible, surtout cette année, alors que presque la majorité des pays le sont. organiser des élections. Les populations vulnérables comme les personnes âgées et les enfants comptent également parmi les victimes les plus susceptibles : Internet Watch Foundation, une organisation britannique de lutte contre la pédopornographie, a rapporté un montée en puissance de l'IA pornographique deepfakes ces derniers mois.

Chanteur célèbre Taylor Swift a également été victime de deepfakes générés par l'IA en début d'année, plus précisément sur X (anciennement Twitter). La plateforme a temporairement interdit les recherches sur Taylor Swift après la diffusion de fausses images explicites d'elle. Ces images ont été créées à l'aide de l'outil Designers de Microsoft et partagées dans un groupe Telegram.

Forum des utilisateurs

Messages 0