Free Software Foundationin mielestä GitHub Copilotin pitäisi olla laitonta

3 min. lukea

Päivitetty

Lue ilmoitussivumme saadaksesi selville, kuinka voit auttaa MSPoweruseria ylläpitämään toimitustiimiä Lue lisää

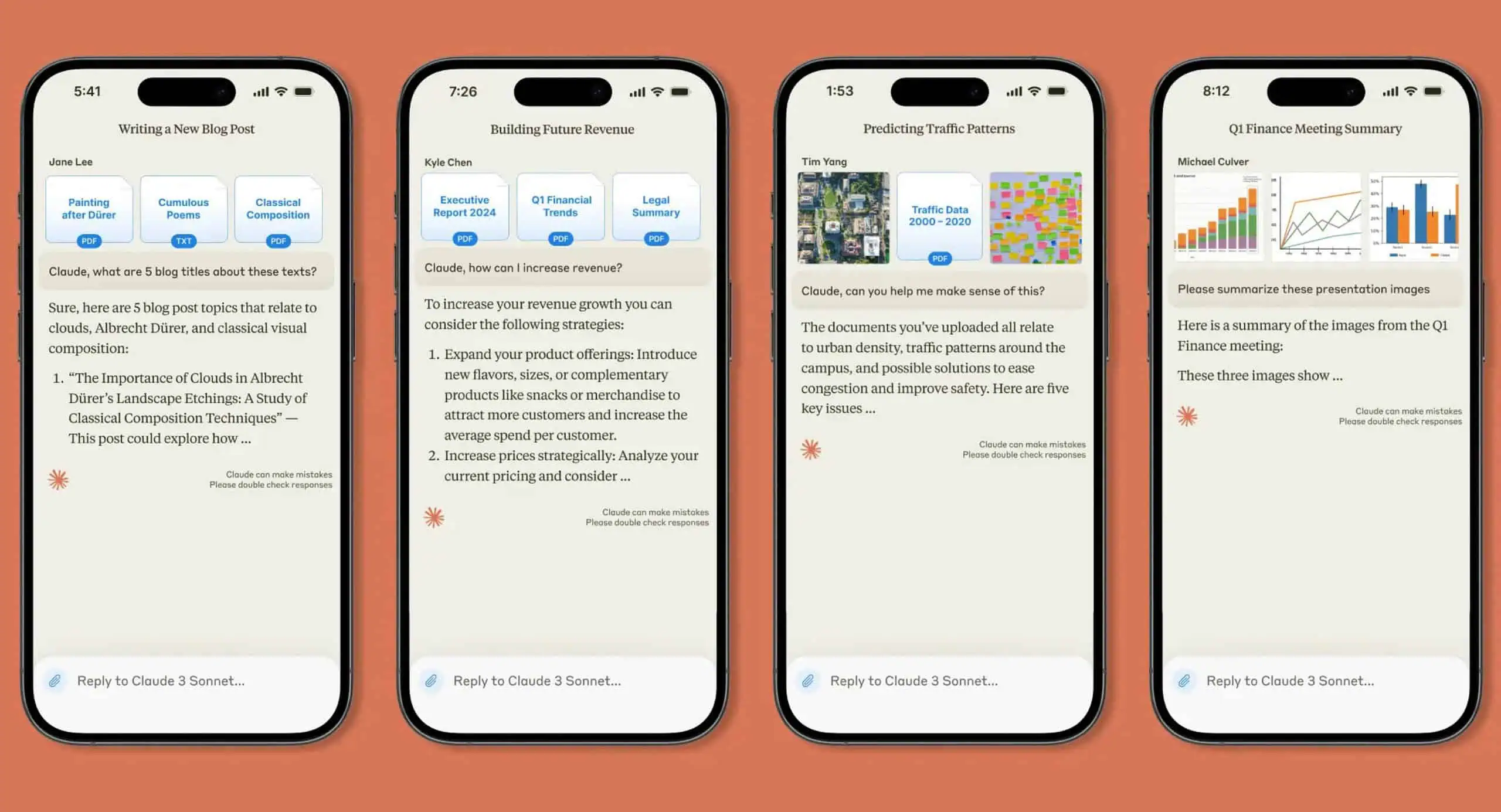

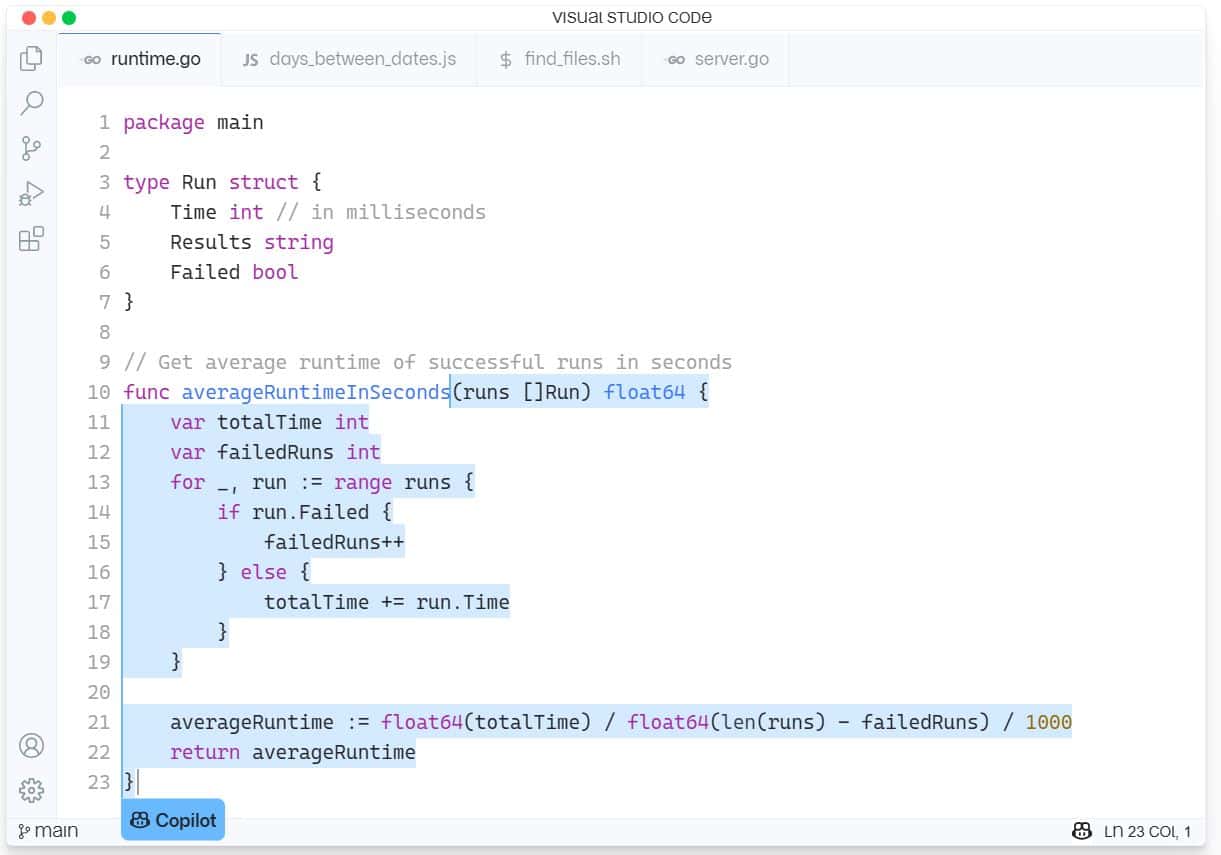

GitHub Copilot on uusi AI-apupalvelu ohjelmistokehitykseen, joka on sisäänrakennettu Microsoftin Visual Studio Code -koodiin. GitHub Copilot tukee useita kieliä ja kehyksiä ja helpottaa kehittäjien elämää tarjoamalla ehdotuksia kokonaisille riveille tai kokonaisille toiminnoille suoraan IDE:n sisällä. GitHub Copilot toimii OpenAI Codexin avulla, ja se on koulutettu miljardeille avoimen lähdekoodin riveille.

Viimeinen ongelma on aiheuttanut Free Software Foundationin (FSF) konepellissä massiivisen mehiläisen, joka kutsuu työkalua "meidän näkökulmastamme mahdottomaksi ja epäoikeudenmukaiseksi".

Avoimen lähdekoodin ohjelmiston kannattaja valittaa, että Copilot vaatii suljetun lähdekoodin ohjelmistoja, kuten Microsoftin Visual Studio IDE:n tai Visual Studio Code -editorin, toimiakseen ja että se on "ohjelmiston korvikepalvelu", mikä tarkoittaa, että se on tapa saada valtaa muiden ihmisten tietokoneista.

FSF katsoi, että Copilotissa oli useita ongelmia, joita oli vielä testattava oikeudessa.

”Kehittäjät haluavat tietää, voidaanko hermoverkon kouluttamista heidän ohjelmistoillaan pitää kohtuullisena käytönä. Muut, jotka saattavat haluta käyttää Copilotia, ihmettelevät, voivatko GitHubin isännöimistä arkistoista kopioidut koodinpätkät ja muut elementit johtaa tekijänoikeusrikkomuksiin. Ja vaikka kaikki olisikin laillisesti sovitonta, aktivistit ihmettelevät, eikö ohjelmistoyrityksen perustamisessa ole jotain pohjimmiltaan epäreilua, joka rakentaa palvelun heidän työstään", FSF kirjoitti.

Näihin kysymyksiin vastaaminen FSF on pyytänyt valkoisia kirjoja, joissa tarkastellaan seuraavia kysymyksiä:

- Onko Copilotin koulutus julkisista tietovarastoista tekijänoikeusrikkomus? Reilu käyttö?

- Kuinka todennäköistä on, että Copilotin tuotos tuottaa kannekelpoisia vaatimuksia GPL-lisensoitujen teosten rikkomuksista?

- Voivatko Copilotia käyttävät kehittäjät noudattaa ilmaisia ohjelmistolisenssejä, kuten GPL?

- Kuinka kehittäjät voivat varmistaa, että koodi, jonka tekijänoikeudet heillä on, on suojattu Copilotin aiheuttamilta rikkomuksilta?

- Jos Copilot luo koodia, joka johtaa vapaan ohjelmiston lisensoidun teoksen rikkomiseen, miten tekijänoikeuksien haltija voi havaita tämän rikkomuksen?

- Onko koulutettu AI/ML-malli tekijänoikeudella suojattu? Kuka omistaa tekijänoikeudet?

- Pitäisikö FSF:n kaltaisten organisaatioiden puolustaa tekijänoikeuslain muutosta näissä kysymyksissä?

FSF maksaa 500 dollaria julkaistuista valkoisista kirjoista ja voi vapauttaa lisää varoja, jos lisätutkimukset ovat perusteltuja.

Ne, jotka haluavat tehdä ehdotuksen, voivat lähettää sen osoitteeseen [sähköposti suojattu] ennen 21. elokuuta. Lue lisää prosessista osoitteessa FSF.org täällä.

Microsoft on vastannut tulevaan haasteeseen sanomalla: "Tämä on uusi tila, ja olemme kiinnostuneita keskustelemaan kehittäjien kanssa näistä aiheista ja johtamaan alaa asianmukaisten standardien asettamisessa tekoälymallien koulutukselle."

Ottaen huomioon, että Copilot varastaa joskus kokonaisia toimintoja muista avoimen lähdekoodin sovelluksista, ovatko lukijamme samaa mieltä FSF:n kanssa vai onko FSF tekopyhää yksinkertaisesti siksi, että se on tekoäly eikä ihmisen uudelleenkäyttöä käyttävä koodi? Kerro meille näkemyksesi alla olevissa kommenteissa.

kautta InfoWorld