Microsoft esittelee Phi-3-malliperheen, joka ylittää muut luokkansa mallit

2 min. lukea

Päivitetty

Lue ilmoitussivumme saadaksesi selville, kuinka voit auttaa MSPoweruseria ylläpitämään toimitustiimiä Lue lisää

Joulukuussa 2023 Microsoft julkaisi Phi-2 2.7 miljardin parametrin malli, joka tarjosi huippuluokan suorituskyvyn peruskielimalleissa, joissa on alle 13 miljardia parametria. Viimeisen neljän kuukauden aikana useat muut julkaistut mallit suorittivat Phi-2:n paremmin. Hiljattain Meta julkaisi Llama-3-malliperheen, joka ylitti kaikki aiemmin julkaistut avoimen lähdekoodin mallit.

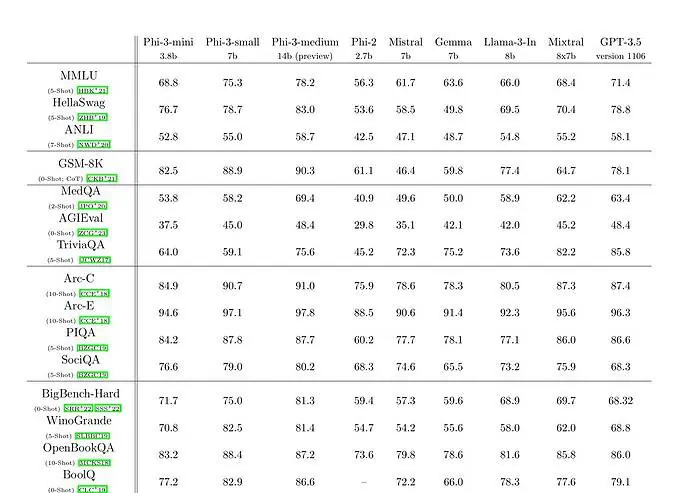

Viime yönä Microsoft Research julkisti Phi-3-malliperheen kautta tekninen raportti. Phi-3-perheessä on kolme mallia:

- phi-3-mini (3.8B)

- phi-3-small (7B)

- phi-3-medium (14B)

phi-3-mini, jossa on 3.8 miljardin parametrin kielimalli, on koulutettu 3.3 biljoonalla tunnuksella. Vertailuarvojen mukaan phi-3-mini voittaa Mixtral 8x7B:n ja GPT-3.5:n. Microsoft väittää, että tämä malli on tarpeeksi pieni käytettäväksi puhelimessa. Microsoft käytti phi-2:ssa käytetyn tietojoukon skaalattua versiota, joka koostui voimakkaasti suodatetuista verkkotiedoista ja synteettisistä tiedoista. Microsoftin Technical Paperin vertailutulosten mukaan phi-3-small ja phi-3-medium saavuttavat vaikuttavat MMLU-pisteet 75.3 ja 78.2.

Mitä tulee LLM-ominaisuuksiin, vaikka Phi-3-mini-malli saavuttaa saman tason kielen ymmärtämisessä ja päättelykyvyssä kuin paljon suuremmissa malleissa, sitä rajoittaa silti sen koko tietyissä tehtävissä. Mallilla ei yksinkertaisesti ole kykyä tallentaa laajaa faktatietoa, mikä näkyy esimerkiksi TriviaQA:n heikon suorituskyvyn yhteydessä. Uskomme kuitenkin, että tämä heikkous voidaan korjata lisäämällä hakukoneeseen.

Käyttäjäfoorumi

0-viestit