Microsoft selittää, miksi LLM:t hallusinoivat ja keksivät vastauksia

2 min. lukea

Päivitetty

Lue ilmoitussivumme saadaksesi selville, kuinka voit auttaa MSPoweruseria ylläpitämään toimitustiimiä Lue lisää

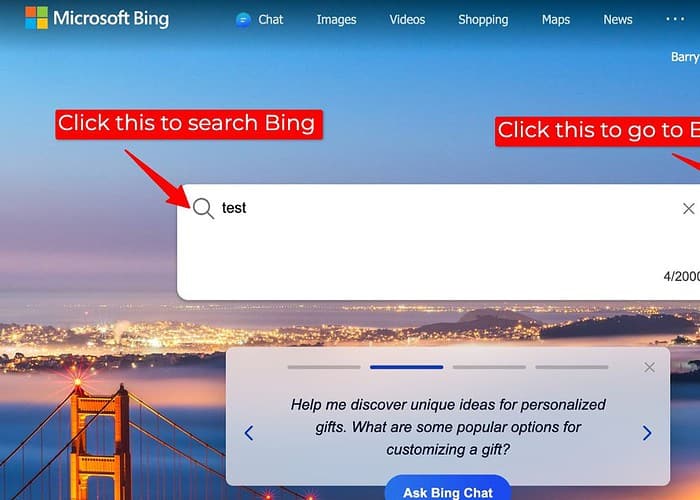

Äskettäinen Twitter-keskustelu käyttäjän ja Microsoftin johtajan välillä on tuonut uutta huomiota suurten kielimallien (LLM), kuten Bingin, rajoituksiin ja mahdollisiin tietopuutteisiin, kun luotetaan pelkästään heidän sisäiseen tietoonsa.

Keskustelu johtui siitä, että käyttäjä ilmoitti epätarkoista hakutuloksista Bingissä, kun sen hakulaajennus, joka käyttää ulkoisia verkkotietoja, poistettiin käytöstä. Vastauksena Microsoftin Advertising & Web Services -yksikön toimitusjohtaja Mikhail Parakhin myönsi, että LLM:t "kehittelevät asioita" tällaisissa tilanteissa.

Hän selitti, että kun LLM:t eivät saa verkon kautta saatavilla olevaa valtavaa tietoa, he voivat joskus turvautua sisäiseen tietopohjaansa, koulutukseen käytettävään teksti- ja koodikokoelmaan, tuottaakseen vastauksia. Tämä sisäinen sukupolvi ei kuitenkaan välttämättä aina ole tarkka tai linjassa todellisen todellisuuden kanssa, mikä johtaa mahdollisiin eroihin hakutuloksissa verrattuna tuloksiin, jotka on saatu hakulaajennuksella.

Minulle tämä herättää tärkeitä kysymyksiä LLM-pohjaisten hakujen läpinäkyvyydestä ja tarkkuudesta, varsinkin kun ulkoisia tietolähteitä ei ole saatavilla. Kun LLM:t luovat vastauksia käyttämättä ulkoisia tietoja, käyttäjille tulee antaa selkeä ilmoitus tiedon lähteestä ja mahdollisista rajoituksista.

Vaikka vastausten antaminen on arvokasta, LLM:ien on asetettava luotettava tieto etusijalle tietopuutteiden täyttämisen sijaan mahdollisesti epätarkoilla sisäisillä sukupolvilla. Vaihtoehtoisten lähestymistapojen tutkiminen, kuten epävarmuuden osoittaminen, lisätutkimuksen ehdottaminen tai yksinkertaisesti toteaminen, että vastausta ei ole saatavilla, voisi lisätä luottamusta ja estää väärän tiedon leviämistä.

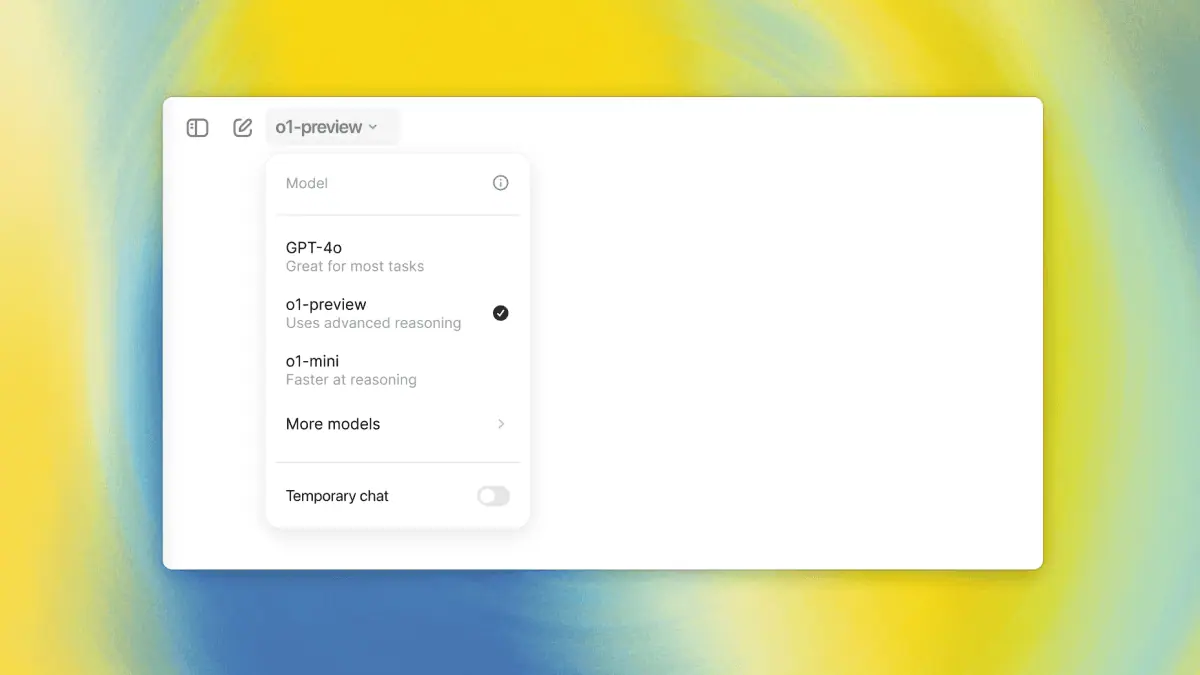

Siksi ei ole ihme, miksi ihmiset suosivat ChatGPT:tä Bing Chatin/Copilotin sijaan.

Ja näistä syistä käytän itse mieluummin Bardia, koska Google on tarjonnut toiminnon, jossa Bard ilmoittaa käyttäjille, onko tietoon viitattu jostain muualta vai ei, mikä helpottaa käyttäjien luottamista tietoihin.

Käyttäjäfoorumi

0-viestit