Microsoft Azure AI paljastaa "Prompt Shields" LLM-manipuloinnin torjumiseksi

2 min. lukea

Julkaistu

Lue ilmoitussivumme saadaksesi selville, kuinka voit auttaa MSPoweruseria ylläpitämään toimitustiimiä Lue lisää

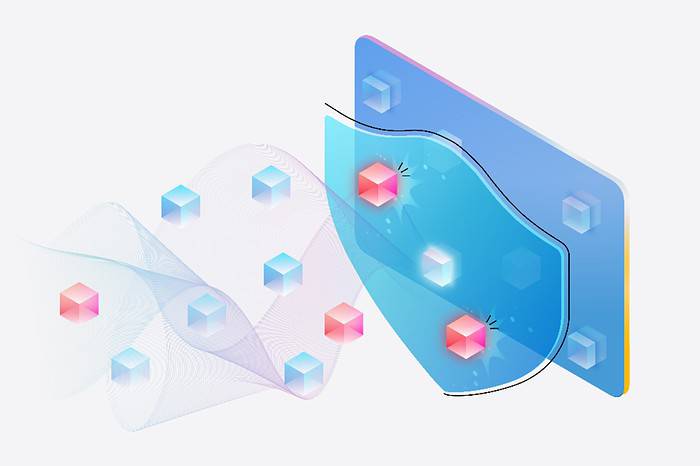

Microsoft tänään ilmoitti merkittävä tietoturvaparannus sen Azure OpenAI Service- ja Azure AI Content Safety -alustoille. "Prompt Shields" -niminen uusi ominaisuus tarjoaa vankan suojan yhä kehittyneempiä hyökkäyksiä vastaan, jotka kohdistuvat suuriin kielimalleihin (LLM).

Prompt Shields suojaa:

- Suorat hyökkäykset: Nämä yritykset, jotka tunnetaan myös nimellä jailbreak-hyökkäykset, ohjaavat LLM:ää nimenomaisesti jättämään huomioimatta turvaprotokollat tai suorittamaan haitallisia toimia.

- Epäsuorat hyökkäykset: Nämä hyökkäykset upottavat hienovaraisesti haitallisia ohjeita näennäisesti normaaliin tekstiin, ja niiden tarkoituksena on huijata LLM ei-toivottuun toimintaan.

Prompt Shields on integroitu Azure OpenAI Service -sisältösuodattimiin, ja ne ovat saatavilla Azure AI Content Safetyssä. Kehittyneiden koneoppimisalgoritmien ja luonnollisen kielen käsittelyn ansiosta Prompt Shields voi tunnistaa ja neutraloida mahdolliset uhat käyttäjäkehotteissa ja kolmannen osapuolen tiedoissa.

Valokeilassa: uusi puolustustekniikka

Microsoft esitteli myös "Spotlightingin", erikoistuneen nopean suunnittelutavan, joka on suunniteltu estämään epäsuorat hyökkäykset. Spotlighting-tekniikat, kuten rajaaminen ja datamerkintä, auttavat LLM:itä erottamaan selkeästi oikeutetut ohjeet ja mahdollisesti haitalliset sulautetut komennot.

Saatavuus

Prompt Shields on tällä hetkellä julkisessa esikatselussa osana Azure AI Content Safety -palvelua, ja se on saatavilla Azure OpenAI -palvelussa 1. huhtikuuta. Integraatio Azure AI Studioon on suunniteltu lähitulevaisuudessa.