مایکروسافت ریسرچ Splitwise را معرفی میکند، تکنیک جدیدی برای افزایش کارایی GPU برای مدلهای زبان بزرگ

2 دقیقه خواندن

منتشر شده در

صفحه افشای ما را بخوانید تا بدانید چگونه می توانید به MSPoweruser کمک کنید تا تیم تحریریه را حفظ کند ادامه مطلب

یادداشت های کلیدی

- Splitwise یک پیشرفت در کارایی و پایداری استنتاج LLM است.

- Splitwise با جداسازی فازهای prompt و token، پتانسیل جدیدی را در استفاده از GPU باز میکند و ارائهدهندگان ابری را قادر میسازد تا درخواستهای بیشتری را با همان بودجه انرژی سریعتر ارائه دهند.

مدلهای زبان بزرگ (LLM) زمینههای پردازش زبان طبیعی و هوش مصنوعی را تغییر میدهند و برنامههایی مانند تولید کد، عوامل مکالمه و خلاصهسازی متن را امکانپذیر میکنند. با این حال، این مدلها همچنین چالشهای مهمی را برای ارائهدهندگان ابری ایجاد میکنند، که نیاز به استقرار بیشتر و بیشتر واحدهای پردازش گرافیکی (GPU) برای پاسخگویی به تقاضای فزاینده برای استنتاج LLM دارند.

مشکل اینجاست که پردازندههای گرافیکی نه تنها گران هستند، بلکه نیاز به انرژی نیز دارند و ظرفیت تامین برق مورد نیاز برای راهاندازی آنها محدود است. در نتیجه، ارائهدهندگان ابر اغلب با معضل رد درخواستهای کاربر یا افزایش هزینههای عملیاتی و اثرات زیستمحیطی خود مواجه میشوند.

برای رفع این مشکل، محققان در Microsoft Azure تکنیک جدیدی به نام توسعه داده اند تقسیم شده، که با تقسیم کردن محاسبات به دو فاز مجزا و تخصیص آنها به ماشین های مختلف، استنتاج LLM را کارآمدتر و پایدارتر می کند. شما می توانید در مورد این تکنیک به طور مفصل در آنها بخوانیدSplitwise: استنتاج LLM مولد کارآمد با استفاده از تقسیم فاز" مقاله تحقیقاتی.

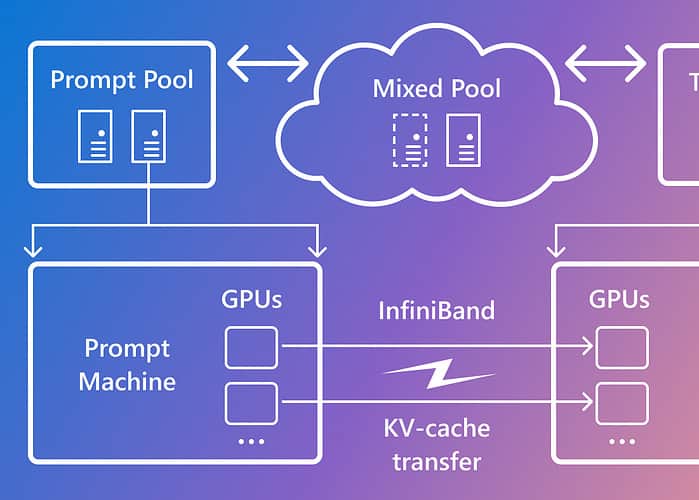

Splitwise بر اساس این مشاهدات است که استنتاج LLM شامل دو فاز با ویژگی های مختلف است: فاز سریع و فاز تولید نشانه. در مرحله سریع ، مدل ورودی کاربر یا سریع را به طور موازی با استفاده از محاسبات GPU زیادی پردازش می کند. در مرحله نسل توکن ، مدل با استفاده از پهنای باند حافظه GPU ، هر توکن خروجی را به صورت متوالی تولید می کند. مایکروسافت علاوه بر جداسازی دو فاز استنتاج LLM به دو استخر ماشین مجزا، از یک مجموعه ماشین سوم برای دستهبندی ترکیبی در فازهای سریع و توکن استفاده کرد که به صورت پویا بر اساس نیازهای محاسباتی زمان واقعی اندازهگیری میشد.

مایکروسافت با استفاده از Splitwise توانست به موارد زیر دست یابد:

- 1.4 برابر توان عملیاتی بالاتر با 20 درصد هزینه کمتر نسبت به طرح های فعلی.

- 2.35 برابر توان عملیاتی بیشتر با همان هزینه و بودجه انرژی.

Splitwise یک پیشرفت در کارایی و پایداری استنتاج LLM است. Splitwise با جداسازی فازهای prompt و token، پتانسیل جدیدی را در استفاده از GPU باز میکند و ارائهدهندگان ابری را قادر میسازد تا درخواستهای بیشتری را با همان بودجه انرژی سریعتر ارائه دهند. Splitwise اکنون بخشی از VLLM است و همچنین می تواند با سایر چارچوب ها پیاده سازی شود. محققان مایکروسافت آزور قصد دارند به کار خود بر روی کارآمدتر و پایدارتر کردن استنتاج LLM ادامه دهند و استخرهای ماشینی متناسب با حداکثر توان، کاهش هزینه و بهره وری انرژی را متصور شوند.