Microsoft Azure AI از "Prompt Shields" برای مبارزه با دستکاری LLM رونمایی کرد

2 دقیقه خواندن

منتشر شده در

صفحه افشای ما را بخوانید تا بدانید چگونه می توانید به MSPoweruser کمک کنید تا تیم تحریریه را حفظ کند ادامه مطلب

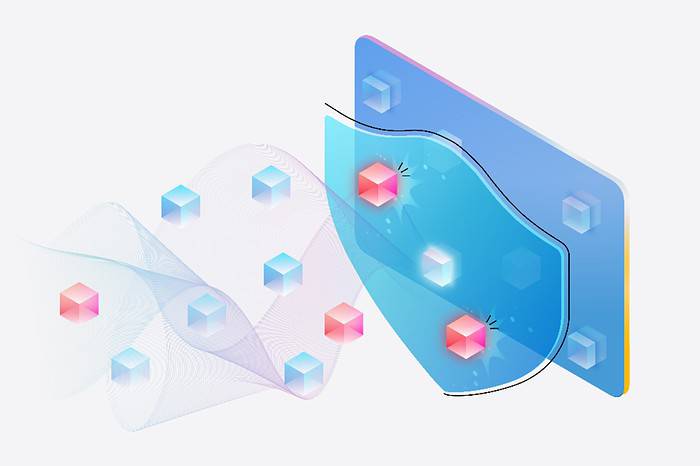

امروز مایکروسافت اعلام کرد یک پیشرفت امنیتی عمده برای سرویس Azure OpenAI و پلتفرمهای Azure AI Content Safety. این ویژگی جدید که «Prompt Shields» نام دارد، دفاعی قوی در برابر حملات پیچیدهتر که مدلهای زبان بزرگ (LLM) را هدف قرار میدهند، ارائه میکند.

Prompt Shields از موارد زیر محافظت می کند:

- حملات مستقیم: همچنین به عنوان حملات فرار از زندان شناخته می شود، این تلاش ها به صراحت به LLM دستور می دهد که پروتکل های ایمنی را نادیده بگیرد یا اقدامات مخرب انجام دهد.

- حملات غیر مستقیم: این حملات به طور نامحسوس دستورالعمل های مضر را در متن به ظاهر عادی جاسازی می کنند و هدف آن فریب دادن LLM به رفتار نامطلوب است.

Prompt Shields با فیلترهای محتوای سرویس OpenAI Azure یکپارچه شده است و در امنیت محتوای هوش مصنوعی Azure موجود است. به لطف الگوریتمهای پیشرفته یادگیری ماشین و پردازش زبان طبیعی، Prompt Shields میتواند تهدیدات احتمالی را در پیامهای کاربر و دادههای شخص ثالث شناسایی و خنثی کند.

Spotlighting: یک تکنیک دفاعی جدید

مایکروسافت همچنین "Spotlighting" را معرفی کرد، یک رویکرد مهندسی سریع تخصصی که برای خنثی کردن حملات غیرمستقیم طراحی شده است. تکنیکهای Spotlighting، مانند مرزبندی و علامتگذاری داده، به LLM کمک میکند تا به وضوح بین دستورالعملهای قانونی و دستورات جاسازی شده مضر بالقوه تمایز قائل شود.

دسترسی

Prompt Shields در حال حاضر به عنوان بخشی از ایمنی محتوای هوش مصنوعی Azure در پیش نمایش عمومی است و در سرویس OpenAI Azure در تاریخ 1 آوریل در دسترس خواهد بود. ادغام با Azure AI Studio در آینده نزدیک برنامه ریزی شده است.