Microsoft presenta el kit de herramientas 'PyRIT' para ayudar a proteger los sistemas de IA generativa

2 minuto. leer

Publicado el

Lea nuestra página de divulgación para descubrir cómo puede ayudar a MSPoweruser a sostener el equipo editorial. Leer más

Notas clave

-

El gigante del software presenta un marco de código abierto para permitir a los profesionales de la seguridad localizar de forma proactiva vulnerabilidades en modelos de IA.

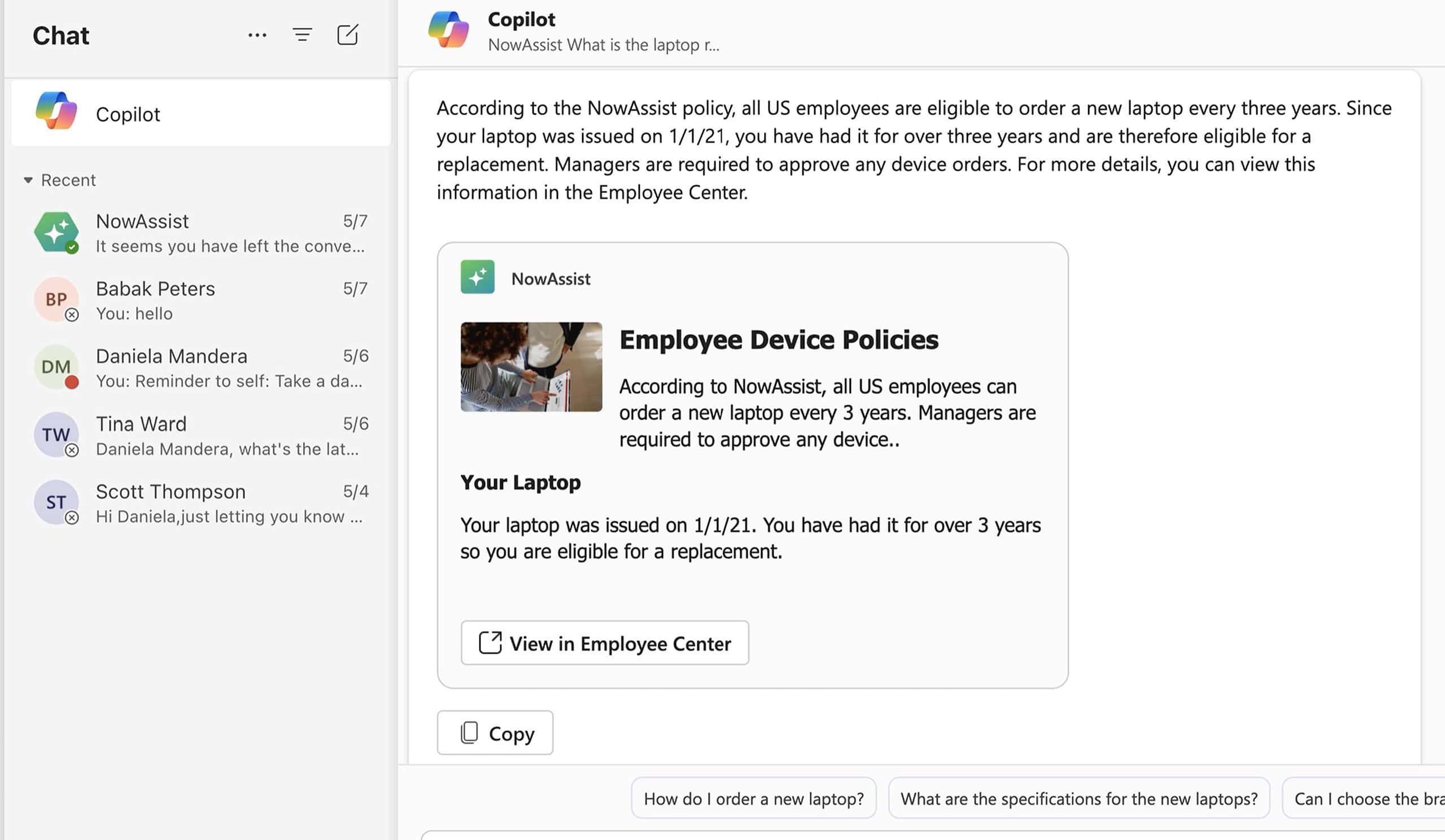

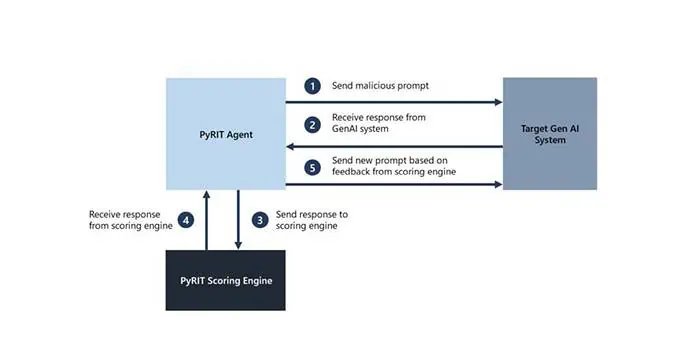

Microsoft hoy anunció el lanzamiento de PyRIT (Python Risk Identification Toolkit), un marco de automatización de código abierto que permite a los equipos de seguridad identificar riesgos dentro de los sistemas generativos de IA. La medida subraya el profundo compromiso de Microsoft con el desarrollo responsable de la IA y la creación de herramientas seguras para el panorama de la IA generativa en rápida expansión.

Automatización de AI Red Teaming: una necesidad

El equipo rojo, el proceso de simular ataques para probar las defensas, es crucial para la IA generativa. Sin embargo, estos sistemas son complejos y con múltiples puntos de falla, a diferencia del software tradicional. La amplia experiencia de Microsoft en equipos rojos de IA llevó a la creación de PyRIT, que aborda los desafíos únicos que plantea la IA generativa.

"Si bien la automatización no puede reemplazar completamente a los equipos humanos, es esencial para escalar los esfuerzos y resaltar áreas que requieren una investigación más profunda", afirmó Microsoft.

PyRIT: características y beneficios clave

- Adaptabilidad: Funciona con varios modelos de IA generativa y se puede ampliar para admitir nuevos tipos de entrada (por ejemplo, imágenes, videos).

- Conjuntos de datos centrados en el riesgo: Permite realizar pruebas tanto para problemas de seguridad como para posibles sesgos o imprecisiones.

- Motor de puntuación flexible: Permite calificar los resultados de la IA mediante aprendizaje automático o LLM directos para autoevaluación.

- Estrategias de ataque de varios turnos: Simula ataques más realistas y persistentes para realizar pruebas en profundidad.

- Capacidad de memoria: Facilita el análisis y permite interacciones más largas y complejas.

Impacto en toda la industria

El lanzamiento de PyRIT causará sensación en la industria de la seguridad de la IA. Microsoft alienta a las organizaciones de todos los sectores a utilizar PyRIT en sus esfuerzos de seguridad de IA generativa. La compañía también invita a la colaboración, enfatizando que un esfuerzo concertado es crucial para construir defensas sólidas contra los riesgos emergentes de la IA.

Es importante tener en cuenta que PyRIT no reemplaza la formación de equipos rojos manuales de sistemas de IA generativa. En cambio, aumenta la experiencia en el dominio existente de un miembro del equipo rojo de IA y automatiza las tareas tediosas para ellos.

Puedes empezar con el proyecto PyRIT esta página.