Das Modell Phi-2 2.7B von Microsoft übertrifft das kürzlich angekündigte Modell Google Gemini Nano-2 3.2B

2 Minute. lesen

Veröffentlicht am

Lesen Sie unsere Offenlegungsseite, um herauszufinden, wie Sie MSPoweruser dabei helfen können, das Redaktionsteam zu unterstützen Lesen Sie weiter

In den letzten Monaten hat Microsoft Research eine Reihe kleiner Sprachmodelle (SLMs) namens „Phi“ veröffentlicht. Der Phi-1 wurde zuerst mit 1.3 Milliarden Parametern veröffentlicht und war auf die grundlegende Python-Codierung spezialisiert. Im September, Microsoft Research freigegeben Phi-1.5-Modell mit 1.3 Milliarden Parametern, aber es wurde mit einer neuen Datenquelle trainiert, die verschiedene synthetische NLP-Texte enthielt. Trotz seiner geringen Größe lieferte der phi-1.5 im Vergleich zu anderen Modellen ähnlicher Größe eine nahezu hochmoderne Leistung.

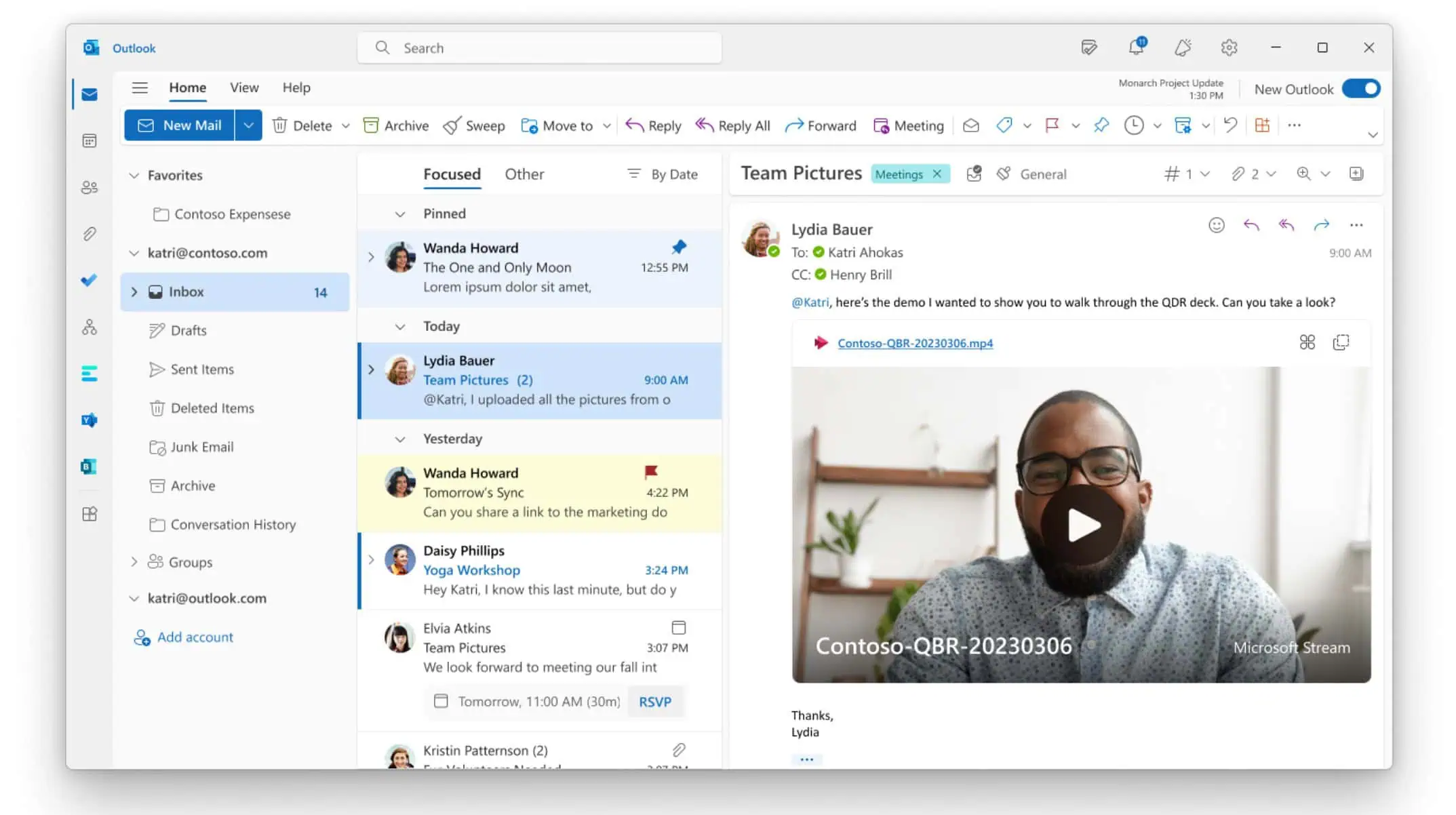

Heute gab Microsoft die Veröffentlichung des Phi-2-Modells mit 2.7 Milliarden Parametern bekannt. Microsoft Research behauptet, dass dieser neue SLM mit weniger als 13 Milliarden Parametern eine hochmoderne Leistung unter Basissprachenmodellen bietet. Bei einigen komplexen Benchmarks erreicht oder übertrifft Phi-2 bis zu 25-mal größere Modelle.

Letzte Woche Google angekündigt Gemini-Suite von Sprachmodellen. Der Gemini Nano ist Googles effizientestes Modell für Aufgaben auf dem Gerät und kann direkt auf mobilen Siliziumgeräten ausgeführt werden. Das Nano-ähnliche kleine Sprachmodell von Gemini ermöglicht Funktionen wie Textzusammenfassung, kontextbezogene intelligente Antworten sowie erweitertes Korrekturlesen und Grammatikkorrektur.

Laut Microsoft entspricht oder übertrifft das neue Phi-2-Modell das neue Google Gemini Nano-2, obwohl es kleiner ist. Unten finden Sie den Benchmark-Vergleich zwischen den Modellen Google Gemini Nano-2 und Phi-2.

| Modell | Größe | BBH | BoolQ | MBPP | MMLU |

|---|---|---|---|---|---|

| Gemini Nano 2 | 3.2 Mrd | 42.4 | 79.3 | 27.2 | 55.8 |

| Phi-2 | 2.7 Mrd | 59.3 | 83.3 | 59.1 | 56.7 |

Phi-2 übertrifft nicht nur Gemini Nano-2, sondern übertrifft auch die Leistung der Mistral- und Llama-2-Modelle bei den Parametern 7B und 13B in verschiedenen Benchmarks. Die Details finden Sie weiter unten.

| Modell | Größe | BBH | Gesunder Menschenverstand Argumentation | Sprache UNSERE | Mathe | Programmierung |

|---|---|---|---|---|---|---|

| Lama-2 | 7B | 40.0 | 62.2 | 56.7 | 16.5 | 21.0 |

| 13 Mrd | 47.8 | 65.0 | 61.9 | 34.2 | 25.4 | |

| 70 Mrd | 66.5 | 69.2 | 67.6 | 64.1 | 38.3 | |

| Mistral | 7B | 57.2 | 66.4 | 63.7 | 46.4 | 39.4 |

| Phi-2 | 2.7 Mrd | 59.2 | 68.8 | 62.0 | 61.1 | 53.7 |

Während die beiden vorherigen Phi-Modelle auf Hugging Face verfügbar gemacht wurden, Phi-2 wurde im Azure-Modellkatalog verfügbar gemacht. Erfahren Sie mehr über Phi-2 hier.