Microsoft stellt die Phi-3-Modellfamilie vor, die andere Modelle seiner Klasse übertrifft

2 Minute. lesen

Veröffentlicht am

Lesen Sie unsere Offenlegungsseite, um herauszufinden, wie Sie MSPoweruser dabei helfen können, das Redaktionsteam zu unterstützen Lesen Sie weiter

Bereits im Dezember 2023 veröffentlichte Microsoft Phi-2 Modell mit 2.7 Milliarden Parametern, das unter Basissprachenmodellen mit weniger als 13 Milliarden Parametern eine Spitzenleistung lieferte. In den letzten vier Monaten übertrafen mehrere andere Modelle, die auf den Markt kamen, den Phi-2. Kürzlich veröffentlichte Meta die Modellfamilie Llama-3, die alle zuvor veröffentlichten Open-Source-Modelle übertraf.

Gestern Abend hat Microsoft Research die Phi-3-Modellfamilie angekündigt ein technischer Bericht. Es gibt drei Modelle in der Phi-3-Familie:

- phi-3-mini (3.8B)

- phi-3-klein (7B)

- Phi-3-Medium (14B)

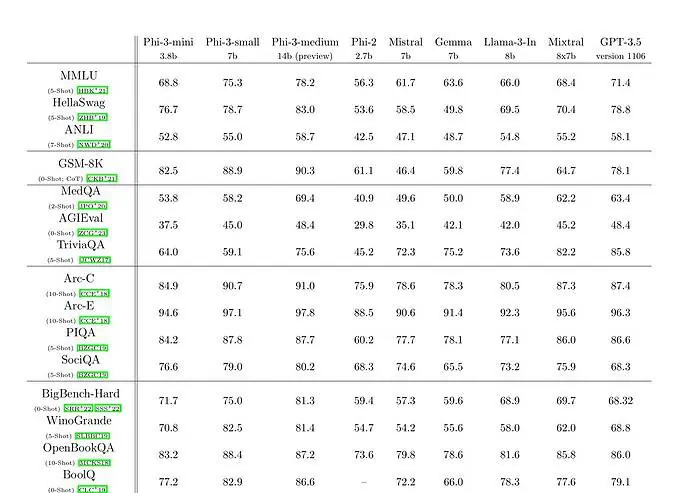

Der Phi-3-Mini mit einem Sprachmodell mit 3.8 Milliarden Parametern wird auf 3.3 Billionen Token trainiert. Laut Benchmarks schlägt phi-3-mini Mixtral 8x7B und GPT-3.5. Microsoft behauptet, dass dieses Modell klein genug ist, um auf einem Telefon eingesetzt zu werden. Microsoft verwendete eine vergrößerte Version des Datensatzes, der für Phi-2 verwendet wurde und aus stark gefilterten Webdaten und synthetischen Daten bestand. Laut den Benchmark-Ergebnissen von Microsoft im Technical Paper erreichen phi-3-small und phi-3-medium einen beeindruckenden MMLU-Wert von 75.3 bzw. 78.2.

Was die LLM-Fähigkeiten betrifft, so erreicht das Phi-3-mini-Modell zwar ein ähnliches Niveau an Sprachverständnis und Argumentationsfähigkeit wie viel größere Modelle, ist jedoch für bestimmte Aufgaben immer noch grundsätzlich durch seine Größe eingeschränkt. Das Modell verfügt einfach nicht über die Kapazität, umfangreiches Faktenwissen zu speichern, was sich beispielsweise an der geringen Leistung von TriviaQA zeigt. Wir glauben jedoch, dass diese Schwachstelle durch die Erweiterung mit einer Suchmaschine behoben werden kann.