Microsoft og NVIDIA annoncerer den største og mest kraftfulde sprogmodel, der er trænet til dato

1 min. Læs

Udgivet den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

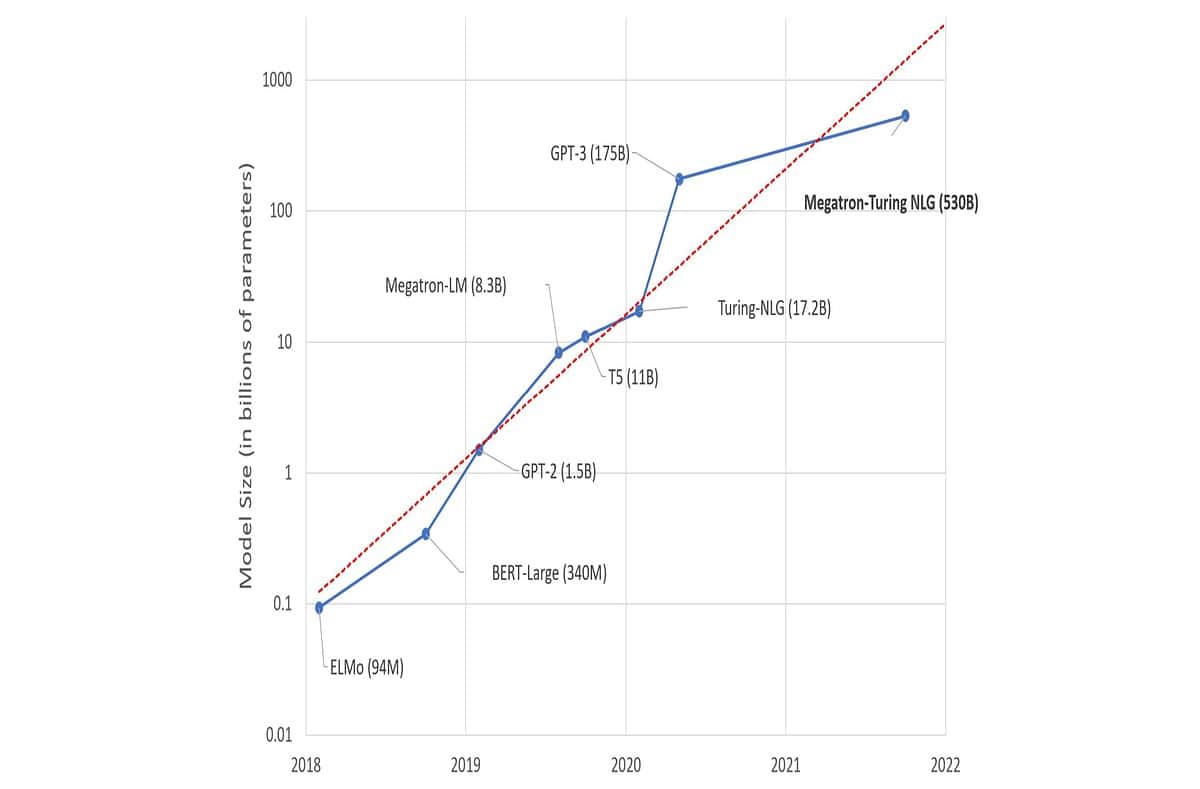

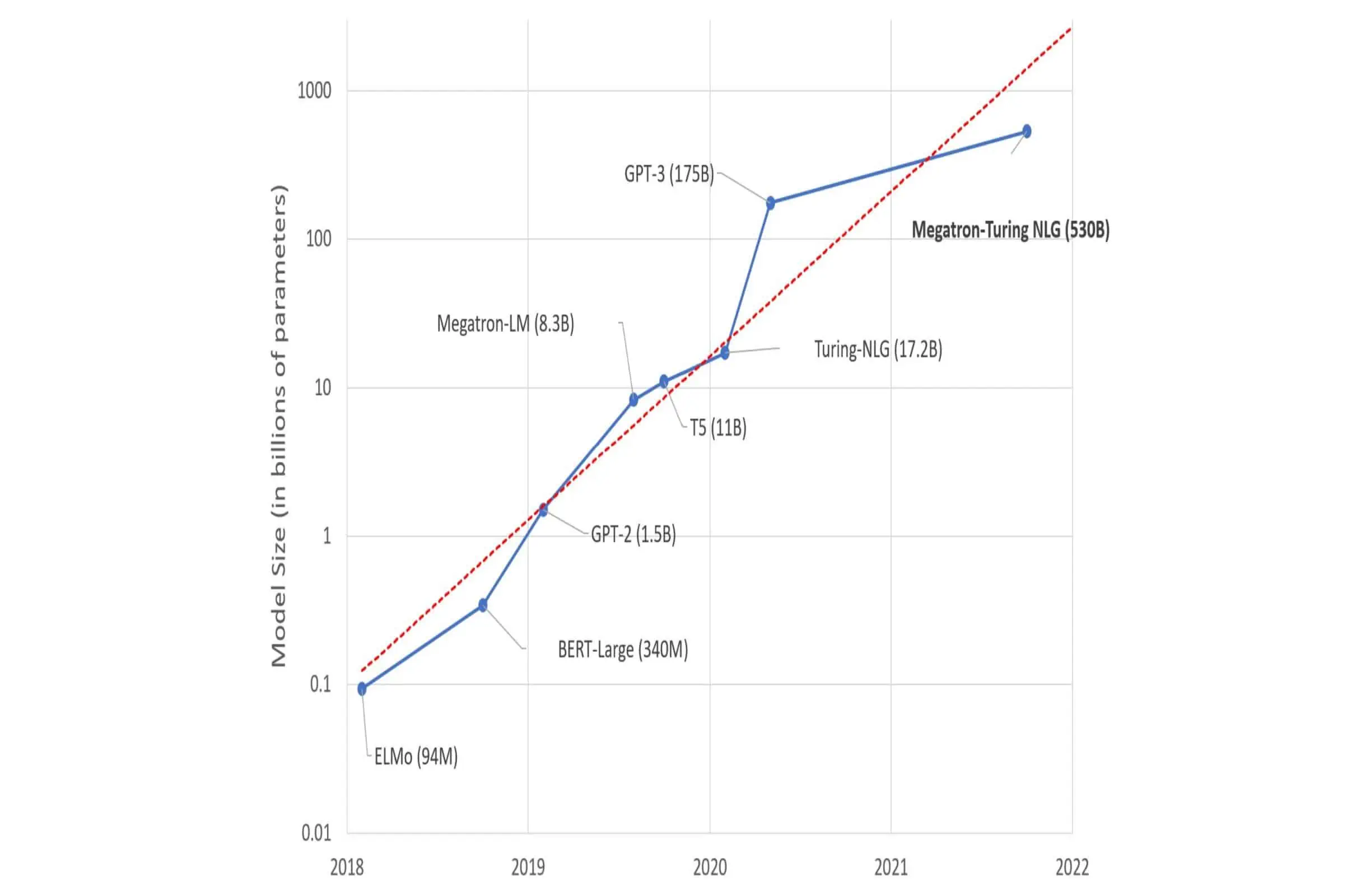

Microsoft og NVIDIA annoncerede i dag den DeepSpeed- og Megatron-drevne Megatron-Turing Natural Language Generation-model (MT-NLG), den største og mest kraftfulde monolitiske transformersprogmodel, der er trænet til dato. Denne model inkluderer 530 milliarder parametre, 3x antallet af parametre sammenlignet med den eksisterende største model, GPT-3. Træning af en så stor model indebærer forskellige udfordringer. NVIDIA og Microsoft arbejdede på mange innovationer og gennembrud langs alle AI-akser.

For eksempel, i tæt samarbejde, opnåede NVIDIA og Microsoft en hidtil uset træningseffektivitet ved at konvergere en avanceret GPU-accelereret træningsinfrastruktur med en banebrydende distribueret læringssoftwarestak. Vi byggede højkvalitets, naturligt sprogtræningskorpus med hundredvis af milliarder af tokens og co-udviklede træningsopskrifter for at forbedre optimeringseffektiviteten og stabiliteten.

Du kan lære mere om dette projekt fra nedenstående links.