Google introducerer "nær mig" og "sceneudforskning" til multisearch-teknologi

3 min. Læs

Udgivet den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

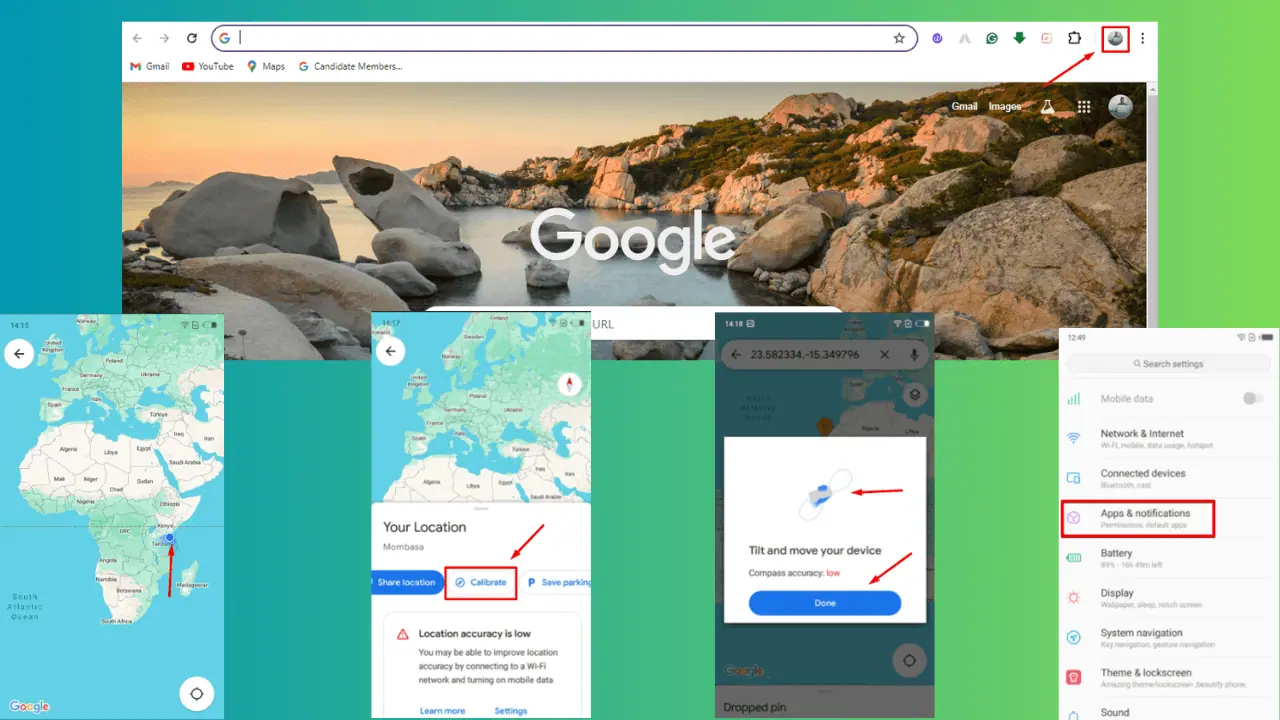

I sidste måned så vi Google lancere multisøgningsfunktion i Lens, som primært er beregnet til at hjælpe brugerne i deres indkøbsaktiviteter og finde bestemte varer på markedet gennem samtidig brug af billed- og ordinput. Nu har Google større ambitioner for teknologien ved at præsentere mere avancerede funktioner, som alle kan bruge. På onsdag, Google Senior Vice President Prabhakar Raghavan afslørede de kommende funktioner i Googles multisearch-teknologi – "nær mig" og "sceneudforskning".

Funktionen "nær mig", som er planlagt til at blive frigivet globalt senere i år på først engelsk og derefter på andre sprog over tid, vil fungere ligesom den grundlæggende multisøgning, hvor brugere har brug for en blanding af billeder og ord i deres søgeinput. Men i stedet for at fokusere ordene på billedets fysiske udseende, vil denne nye funktion fremhæve placeringen af søgningen ved at bruge sætningen "nær mig." Hvis du gør det, vil du vise dig de nærmeste virksomheder, der tilbyder det produkt, du leder efter.

"Sig for eksempel, at du ser en farverig ret online, som du gerne vil prøve - men du ved ikke, hvad der er i den, eller hvad den hedder," forklarer Raghavan. "Når du bruger multisøgning til at finde det i nærheden af dig, Google scanner millioner af billeder og anmeldelser, der er postet på websider og fra vores fællesskab af Maps-bidragydere, for at finde resultater om nærliggende steder, der tilbyder retten, så du kan nyde den selv."

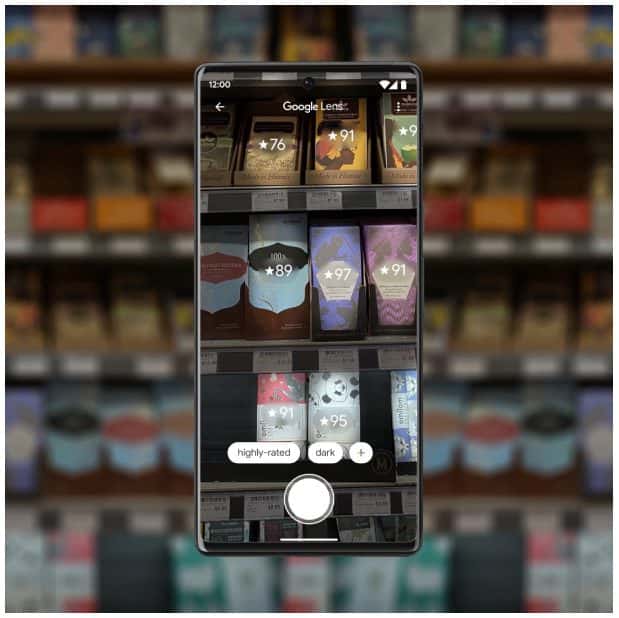

Funktionen "sceneudforskning" har på den anden side en mere lovende funktion ved at tillade brugere at modtage information om flere objekter inden for kamerarammen. Ifølge Raghavan vil dette gøre dig i stand til at panorere multisearch-kameraet og straks modtage information om de genstande, der er fanget på scenen.

"Forestil dig, at du prøver at udvælge den perfekte slikbar til din ven, der er lidt af en chokoladekender," uddyber Raghavan. "Du ved, de elsker mørk chokolade, men kan ikke lide nødder, og du vil gerne have dem noget af kvalitet. Med sceneudforskning vil du være i stand til at scanne hele hylden med din telefons kamera og se nyttige indsigter overlejret foran dig. Sceneudforskning er et kraftfuldt gennembrud i vores enheders evne til at forstå verden, som vi gør – så du nemt kan finde det, du leder efter – og vi ser frem til at bringe det til multisøgning i fremtiden.”

Med disse nye funktioner, der kan forbedre multisøgningskapaciteten i Google Lens, kan Google yderligere booste formålet med billedgenkendelsesteknologien og gøre den mere praktisk til hverdagsbrug. I øjeblikket bemærker Raghavan, at Google Lens-brugere udfører søgninger mere end 8 milliarder gange om måneden. Men med de nye forbedringer, der kommer, kan tallene stige dramatisk, idet teknologien får mere anerkendelse fra offentligheden.