Free Software Foundation si myslí, že GitHub Copilot by měl být nezákonný

3 min. číst

Aktualizováno dne

Přečtěte si naši informační stránku a zjistěte, jak můžete pomoci MSPoweruser udržet redakční tým Dozvědět se více

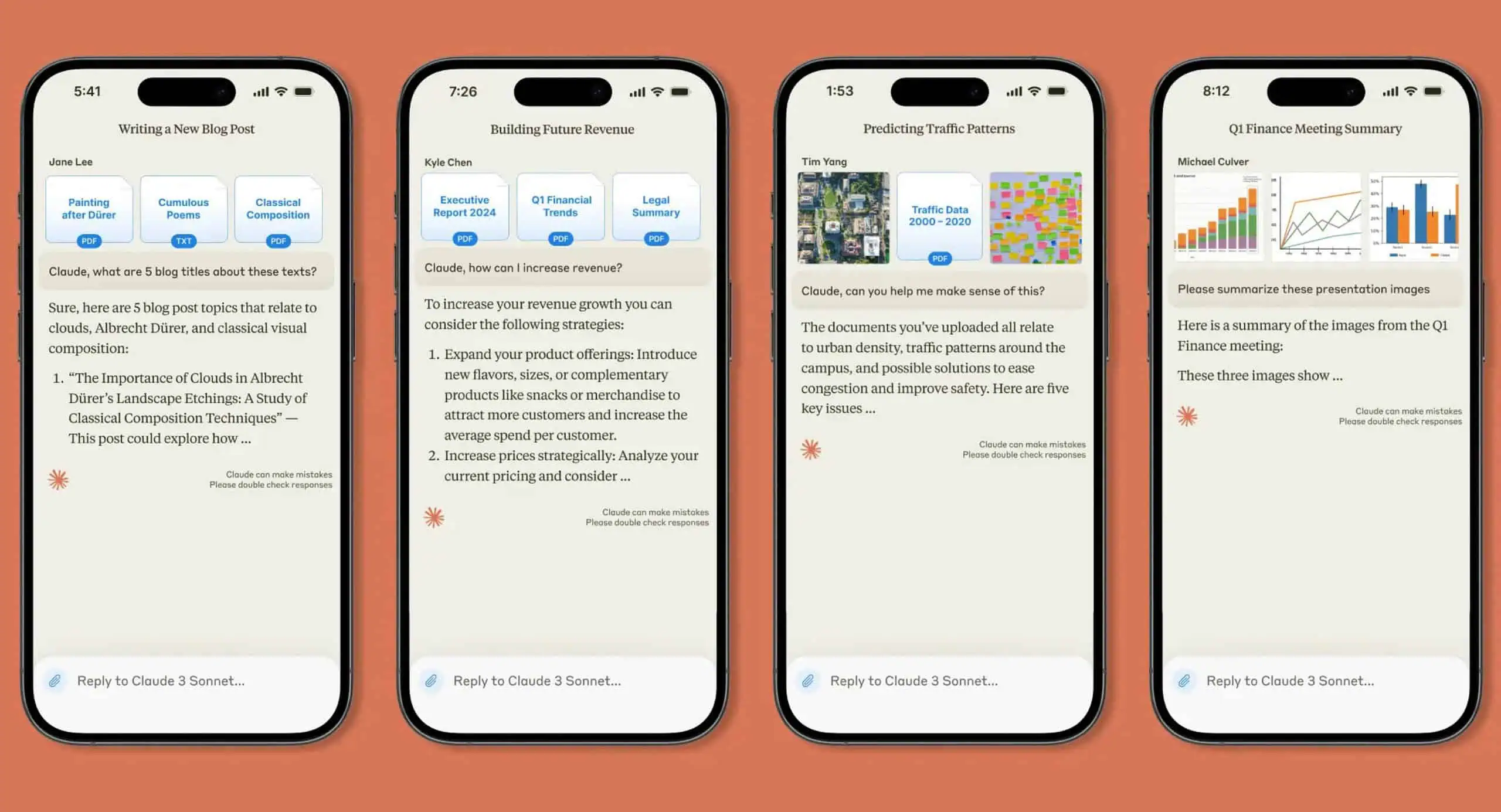

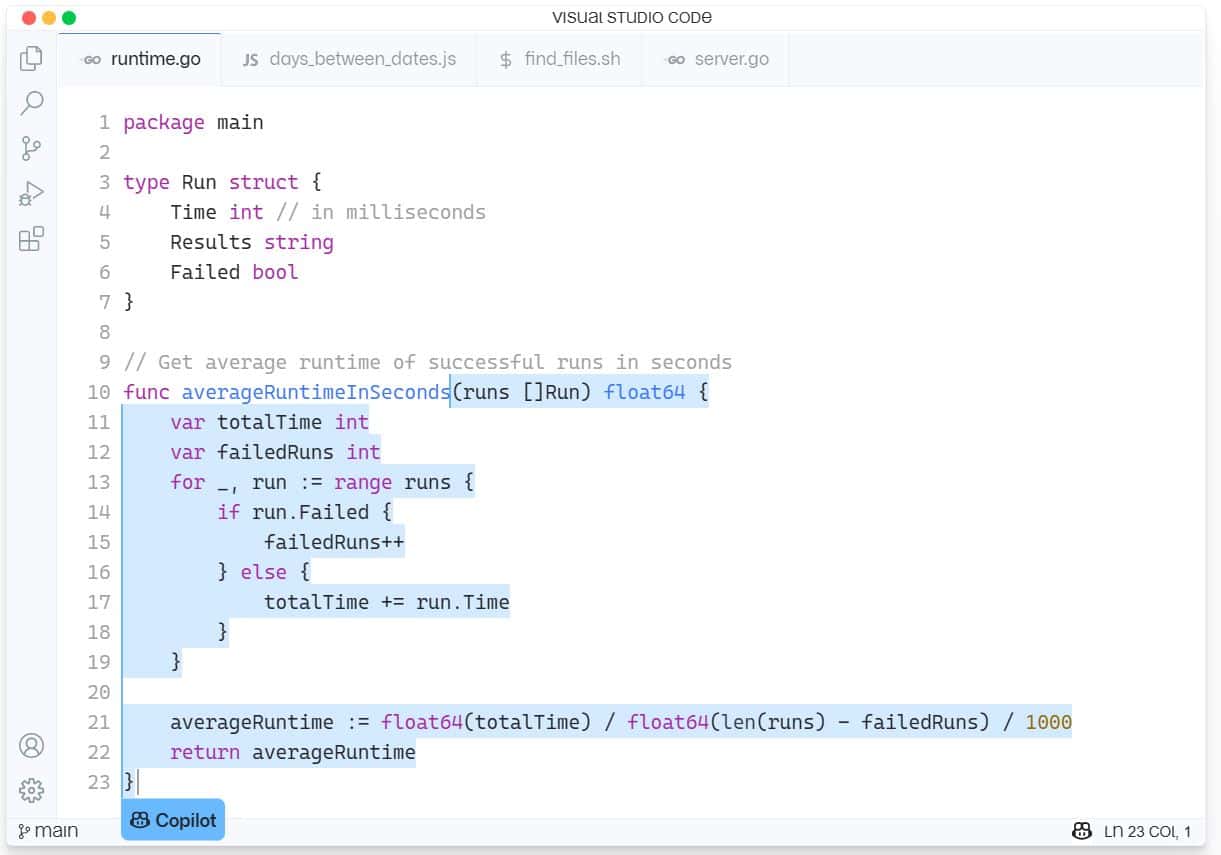

GitHub Copilot je nová asistenční služba AI pro vývoj softwaru zabudovaná do kódu Visual Studio společnosti Microsoft. GitHub Copilot podporuje různé jazyky a rámce a usnadňuje život vývojářů tím, že nabízí návrhy pro celé řádky nebo celé funkce přímo v IDE. GitHub Copilot využívá OpenAI Codex a byl vyškolen na miliardách řádků open-source kódu.

Poslední problém způsobil, že Free Software Foundation (FSF) má na hlavě obrovskou včelu, která tento nástroj nazývá „nepřijatelný a nespravedlivý, z našeho pohledu“.

Obhájce softwaru s otevřeným zdrojovým kódem si stěžuje, že Copilot vyžaduje ke spuštění software s uzavřeným zdrojovým kódem, jako je Microsoft Visual Studio IDE nebo editor kódu Visual Studio, a že představuje „službu jako softwarovou náhražku“, což znamená, že je to způsob, jak získat moc nad počítači jiných lidí.

FSF se domnívalo, že s Copilotem bylo mnoho problémů, které je stále třeba testovat u soudu.

„Vývojáři chtějí vědět, zda lze trénování neuronové sítě na jejich softwaru považovat za fair use. Ostatní, kteří by mohli chtít používat Copilot, si kladou otázku, zda úryvky kódu a další prvky zkopírované z úložišť hostovaných na GitHubu mohou vést k porušení autorských práv. A i když by vše mohlo být legálně kopacetické, aktivisté se ptají, jestli není něco zásadně nespravedlivého na tom, že proprietární softwarová společnost buduje službu ze své práce,“ napsala FSF.

Nápověda k zodpovězení těchto otázek FSF vyzvala k vytvoření bílých knih, které se zabývají následujícími problémy:

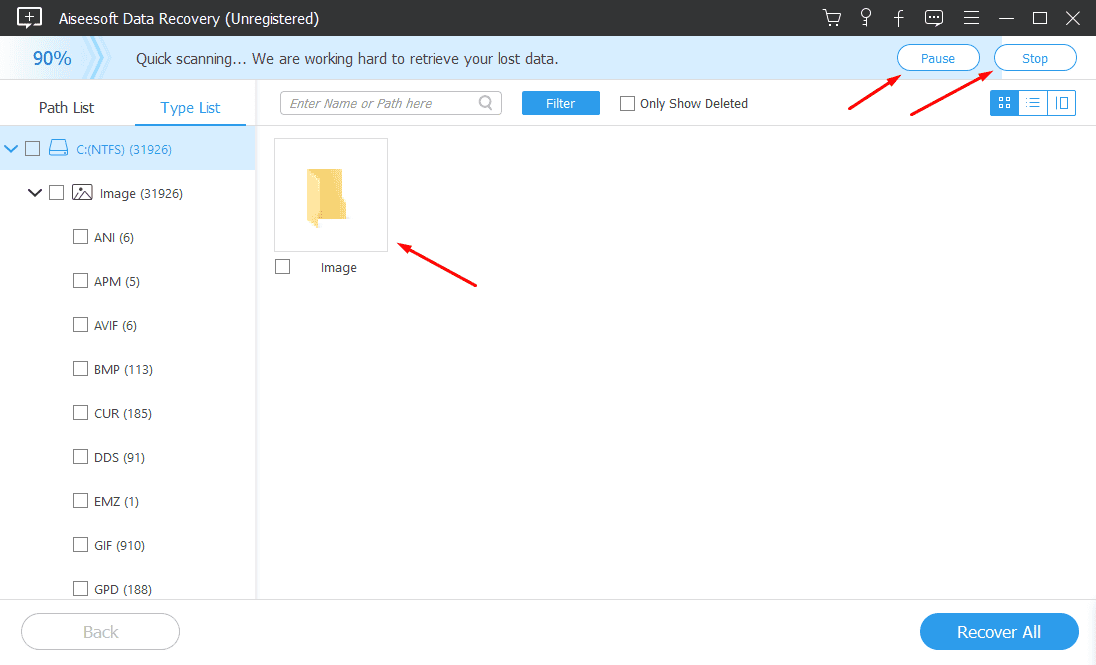

- Je školení Copilot o veřejných úložištích porušením autorských práv? Fair use?

- Jaká je pravděpodobnost, že výstup Copilota vygeneruje žalovatelné nároky na porušení děl licencovaných GPL?

- Mohou vývojáři používající Copilot dodržovat licence na svobodný software, jako je GPL?

- Jak mohou vývojáři zajistit, aby kód, ke kterému mají autorská práva, byl chráněn proti porušením generovaným Copilotem?

- Pokud Copilot generuje kód, který vede k porušení svobodného softwaru licencovaného díla, jak může toto porušení objevit držitel autorských práv?

- Je školený model AI/ML chráněn autorským právem? Kdo je držitelem autorských práv?

- Měly by organizace jako FSF obhajovat změnu autorského zákona relevantní pro tyto otázky?

FSF zaplatí 500 USD za zveřejněné bílé knihy a může uvolnit více prostředků, pokud bude zaručen další výzkum.

Ti, kteří chtějí učinit příspěvek, jej mohou poslat na [chráněno e-mailem] před 21. srpnem. Přečtěte si více o procesu na FSF.org zde.

Microsoft na nadcházející výzvu zareagoval slovy: „Toto je nový prostor a rádi se zapojíme do diskuse s vývojáři na tato témata a povedeme průmysl při stanovování vhodných standardů pro trénink modelů umělé inteligence.“

Vzhledem k tomu, že Copilot někdy krade celé funkce z jiných aplikací s otevřeným zdrojovým kódem, souhlasí naši čtenáři s FSF, nebo je FSF pokrytecké jednoduše proto, že jde spíše o AI než o lidský kód pro přepracování? Dejte nám vědět svůj názor v komentářích níže.

přes informační svět