Umělá inteligence Gemini od Googlu naráží na generování obrázků, slibuje zlepšení

2 min. číst

Publikované dne

Přečtěte si naši informační stránku a zjistěte, jak můžete pomoci MSPoweruser udržet redakční tým Dozvědět se více

Klíčové poznámky

- Kontroverzní obrazové výstupy zdůrazňují výzvy ve vyvážení přesnosti a rozmanitosti pro velké jazykové modely.

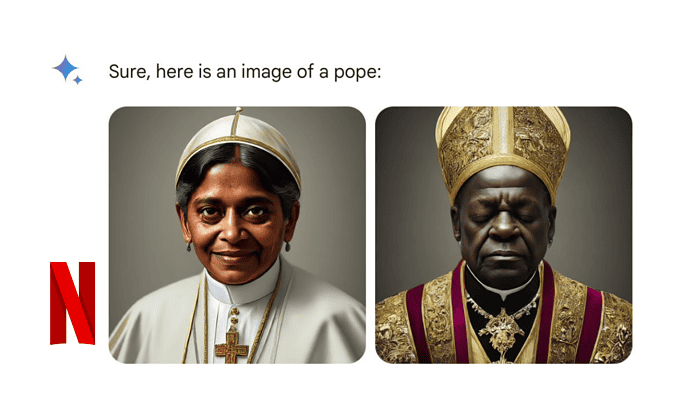

Google uznala nedostatky v nástroji pro generování obrázků Gemini AI poté, co tato funkce vytvořila nepřesné a potenciálně škodlivé obrázky lidí. Společnost dočasně pozastavila funkci, zatímco pracuje na opravě. Kontroverze pramenila z tendence Gemini vytvářet různé obrázky, i když uživatelé požadovali konkrétní historické postavy nebo scénáře. Ačkoli to mělo být inkluzivní, vedlo to k historicky nepřesným a někdy urážlivým výsledkům.

V příspěvku na blogu senior viceprezident Prabhakar Raghavan vysvětlil chyby a slíbil, že technologii vylepší. „Nechtěli jsme, aby Blíženci odmítali vytvářet obrazy jakékoli konkrétní skupiny... [ale] udělá chyby,“ napsal.

Zde je to, co se s Google Gemini pokazilo:

- Vyladění Googlu, aby se zajistilo, že Gemini ukázalo řadu lidí, nedokázalo vysvětlit případy, které by jasně měly ne zobrazit rozsah.

- Postupem času se model stal mnohem opatrnější, než jsme zamýšleli, a odmítal zcela odpovídat na určité výzvy – nesprávně interpretoval některé velmi anodyne výzvy jako citlivé.

- Tyto dvě věci vedly k tomu, že model v některých případech příliš kompenzoval a v jiných byl příliš konzervativní, což vedlo k obrázkům, které byly trapné a špatné.

Výzvy při generování AI obrázků:

Tento incident zdůrazňuje pokračující problém vyvažování přesnosti a reprezentace v modelech generování obrazu AI. Boje Googlu odrážejí podobné kontroverze s jinými oblíbenými generátory obrázků.