什麼是 GPT-3 以及它將如何影響您當前的工作

3分鐘讀

更新了

GPT 是 Generative Pre-training Transformer (GPT) 的縮寫,這是一種語言模型,由 Alec Radford 編寫,由 Elon Musks 的人工智能研究實驗室 OpenAI 於 2018 年發布。 它使用語言的生成模型(其中兩個神經網絡通過競爭相互完善),並且能夠通過對具有長連續文本的不同書面材料集進行預訓練來獲取世界知識並處理長期依賴關係。

GPT-2(Generative Pretrained Transformer 2)於 2019 年 8 月宣布,它是一種無監督的 Transformer 語言模型,對 40 萬個文檔進行了訓練,總共 XNUMX GB 的文本來自通過 Reddit 提交的文章共享。 眾所周知,埃隆馬斯克不願發布它,因為他擔心它可能被用來向社交網絡發送虛假新聞。

2020 年 3 月,OpenAI 宣布了 GPT-3(生成式預訓練變壓器 2),該模型包含的參數比 GPT-175 多兩個數量級(1.5 億對 2 億參數),並且比 GPT-XNUMX 有了顯著改進。

給定任何文本提示,GPT-3 將返回一個文本完成,嘗試匹配您給它的模式。 您可以通過僅向其展示您希望它做什麼的幾個示例來“編程”它,它將提供完整的文章或故事,例如下面的文本,完全由 GPT-3 編寫。

GPT-3 在許多 NLP 數據集上實現了強大的性能,包括翻譯、問答和完形填空任務,以及一些需要即時推理或領域適應的任務,例如解讀單詞,在句子,或執行 3 位算術。 GPT-3 可以生成人類評估者難以將其與人類撰寫的文章區分開來的新聞文章樣本。

最後一個應用一直讓 OpenAI 擔心。 GPT-3 目前以公開測試版的形式提供,預計最終將提供付費的私人測試版。 OpenAI 表示,他們將終止對明顯有害用例的 API 訪問,例如騷擾、垃圾郵件、激進化或 astroturfing。

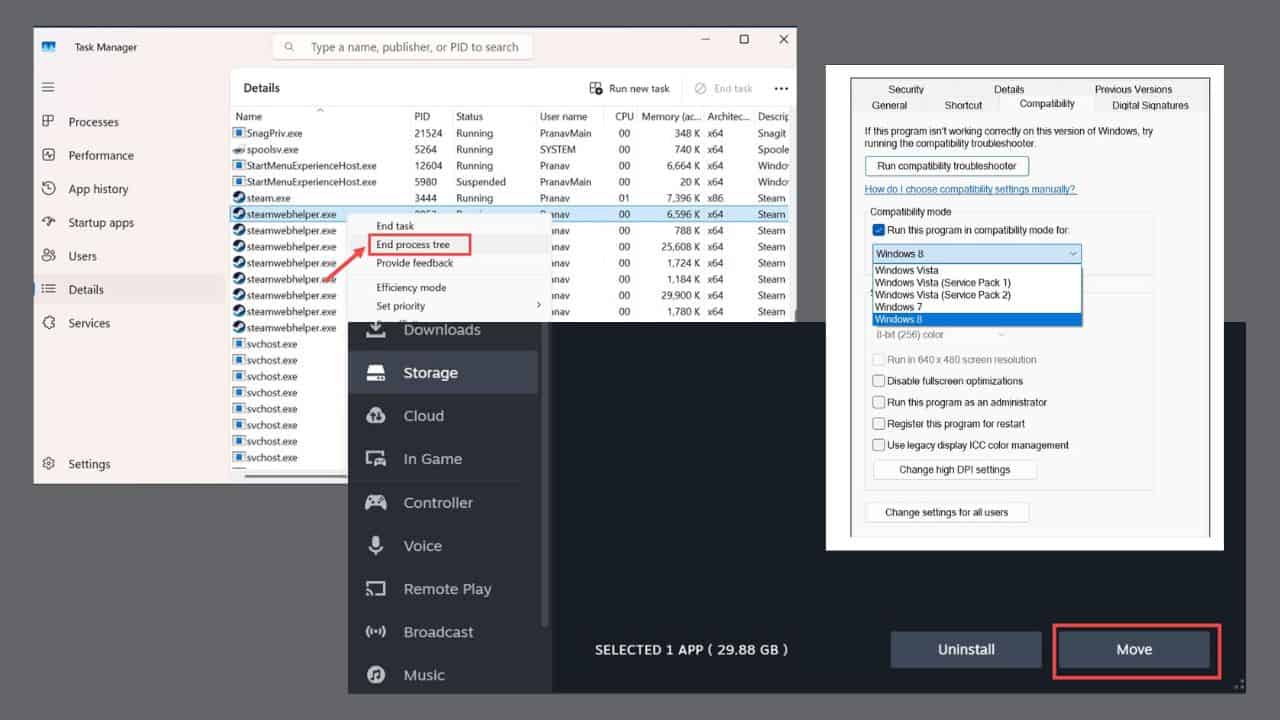

雖然最明顯受到威脅的人群是編寫書面作品的人,例如編劇,但 AI 開發人員已經發現了令人驚訝的應用,例如使用 GPT-3 編寫代碼。

例如,Sharif Shameem 編寫了一個佈局生成器,您可以在其中用純文本描述您想要的內容,然後模型生成相應的代碼。

這真是令人震驚。

使用GPT-3,我構建了一個佈局生成器,您可以在其中描述所需的任何佈局,並為您生成JSX代碼。

-Sharif Shameem(@sharifshameem) 2020 年 7 月 13 日

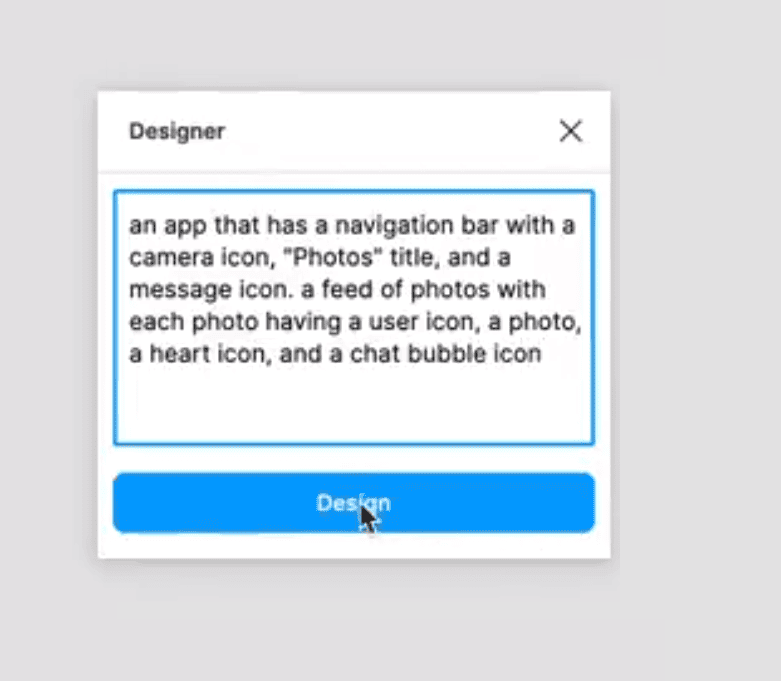

Jordan Singer 類似地創建了一個 Figma 插件,它允許人們使用純文本描述創建應用程序。

這改變了一切。 ?

使用 GPT-3,我構建了一個 Figma 插件來為你設計。

我稱它為“設計師” pic.twitter.com/OzW1sKNLEC

——喬丹歌手(@jsngr) 2020 年 7 月 18 日

它甚至可以用來診斷哮喘和開藥。

So @OpenAI 讓我早日接觸到一個工具,它允許開發人員使用本質上是最強大的文本生成器。 我想我會通過問一個醫學問題來測試它。 粗體文本是 AI 生成的文本。 難以置信… (1/2) pic.twitter.com/4bGfpI09CL

— 卡西姆·穆耶 (@qasimmunye) 2020 年 7 月 2 日

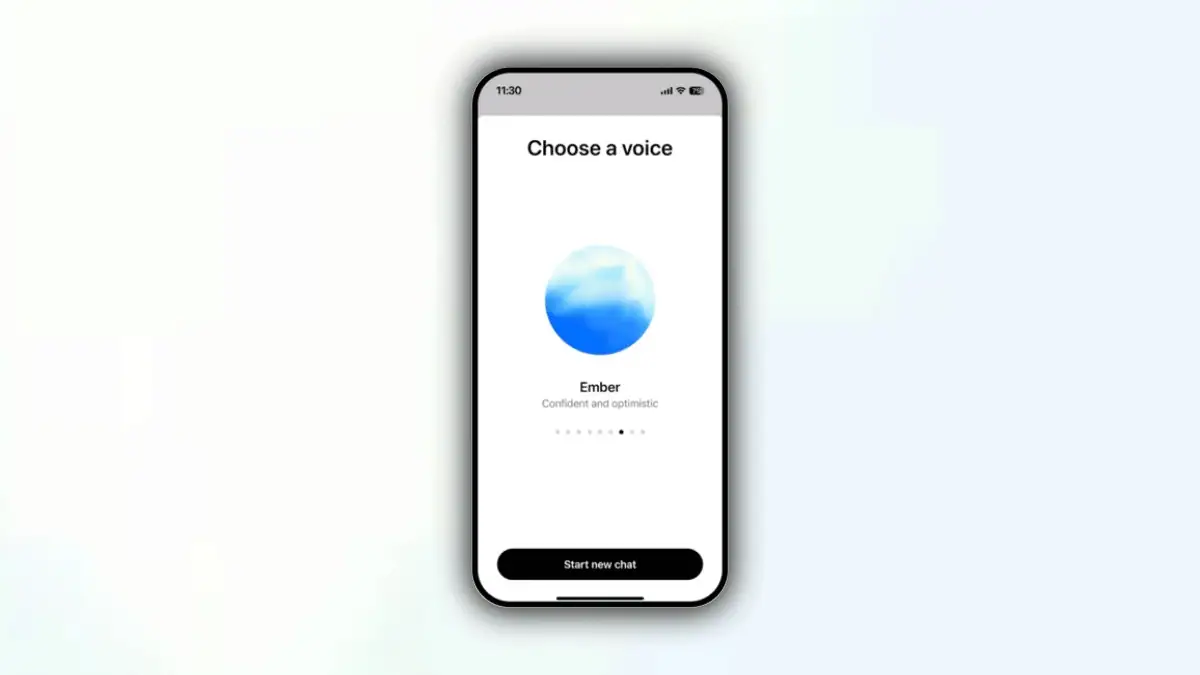

其他應用程序是搜索引擎或各種預言機,甚至可以用來解釋和擴展困難的概念。

我在 GPT3 之上製作了一個功能齊全的搜索引擎。

對於任何任意查詢,它都會返回準確的答案和相應的 URL。

看整個視頻。 這真是太好了。

抄送: @gdb @npew @格溫 pic.twitter.com/9ismj62w6l

— 帕拉斯喬普拉 (@paraschopra) 2020 年 7 月 19 日

雖然這種方法似乎可以直接導致通用 AI 能夠像人類一樣理解、推理和交談,但 OpenAI 警告說他們可能遇到了基本的擴展問題,GPT-3 需要數千 petaflop/s-day 的計算,而完整的 GPT-2 則需要數十 petaflop/s-days。 似乎距離我們更近了,但讓我們所有工作都過時的突破還有一段距離。

閱讀有關 GPT-3 的更多信息 在 GitHub 上。

使用者論壇

0消息