什么是 GPT-3 以及它将如何影响您当前的工作

3分钟读

更新

GPT 是 Generative Pre-training Transformer (GPT) 的缩写,这是一种语言模型,由 Alec Radford 编写,由 Elon Musks 的人工智能研究实验室 OpenAI 于 2018 年发布。 它使用语言的生成模型(其中两个神经网络通过竞争相互完善),并且能够通过对具有长连续文本的不同书面材料集进行预训练来获取世界知识并处理长期依赖关系。

GPT-2(Generative Pretrained Transformer 2)于 2019 年 8 月宣布,它是一种无监督的 Transformer 语言模型,对 40 万个文档进行了训练,总共 XNUMX GB 的文本来自通过 Reddit 提交的文章共享。 众所周知,埃隆马斯克不愿发布它,因为他担心它可能被用来向社交网络发送虚假新闻。

2020 年 3 月,OpenAI 宣布了 GPT-3(生成式预训练变压器 2),该模型包含的参数比 GPT-175 多两个数量级(1.5 亿对 2 亿参数),并且比 GPT-XNUMX 有了显着改进。

给定任何文本提示,GPT-3 将返回一个文本完成,尝试匹配你给它的模式。 您可以通过仅向其展示您希望它做什么的几个示例来“编程”它,它将提供完整的文章或故事,例如下面的文本,完全由 GPT-3 编写。

GPT-3 在许多 NLP 数据集上实现了强大的性能,包括翻译、问答和完形填空任务,以及一些需要即时推理或领域适应的任务,例如解读单词,在句子,或执行 3 位算术。 GPT-3 可以生成人类评估者难以将其与人类撰写的文章区分开来的新闻文章样本。

最后一个应用一直让 OpenAI 担心。 GPT-3 目前以公开测试版的形式提供,预计最终将提供付费的私人测试版。 OpenAI 表示,他们将终止对明显有害用例的 API 访问,例如骚扰、垃圾邮件、激进化或 astroturfing。

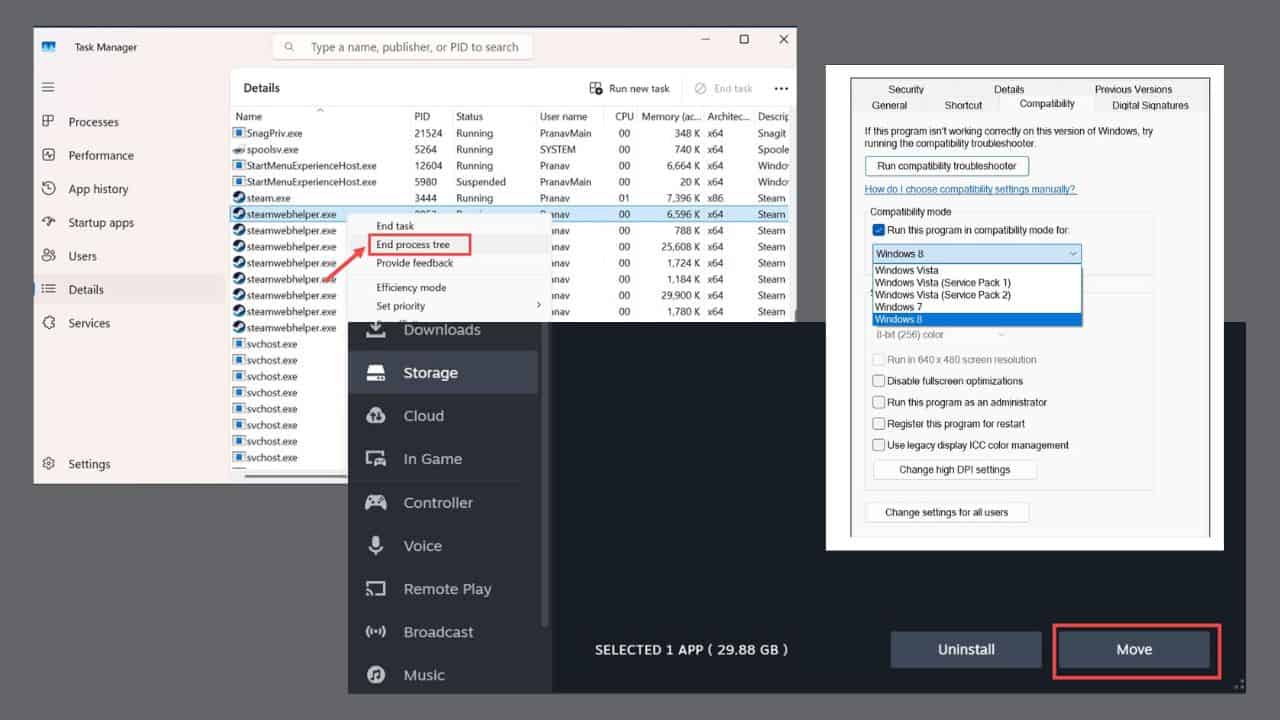

虽然最明显受到威胁的人群是编写书面作品的人,例如编剧,但 AI 开发人员已经发现了令人惊讶的应用,例如使用 GPT-3 编写代码。

例如,Sharif Shameem 编写了一个布局生成器,您可以在其中用纯文本描述您想要的内容,然后模型生成相应的代码。

这真是令人震惊。

使用GPT-3,我构建了一个布局生成器,您可以在其中描述所需的任何布局,并为您生成JSX代码。

-Sharif Shameem(@sharifshameem) 2020 年 7 月 13 日

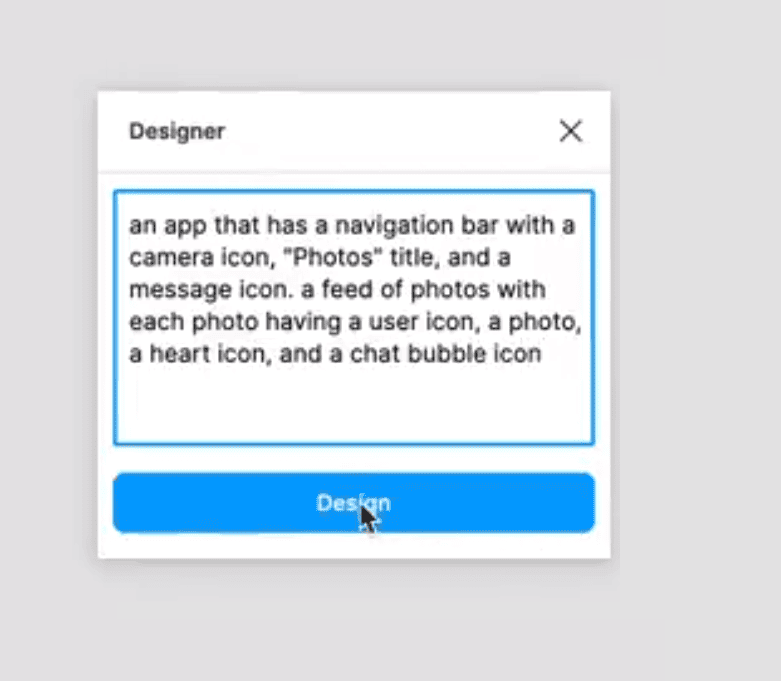

Jordan Singer 类似地创建了一个 Figma 插件,它允许人们使用纯文本描述创建应用程序。

这改变了一切。 ?

使用 GPT-3,我构建了一个 Figma 插件来为你设计。

我称它为“设计师” pic.twitter.com/OzW1sKNLEC

——乔丹歌手(@jsngr) 2020 年 7 月 18 日

它甚至可以用来诊断哮喘和开药。

So @OpenAI 让我早日接触到一个工具,它允许开发人员使用本质上是最强大的文本生成器。 我想我会通过问一个医学问题来测试它。 粗体文本是 AI 生成的文本。 难以置信… (1/2) pic.twitter.com/4bGfpI09CL

— 卡西姆·穆耶 (@qasimmunye) 2020 年 7 月 2 日

其他应用程序是搜索引擎或各种预言机,甚至可以用来解释和扩展困难的概念。

我在 GPT3 之上制作了一个功能齐全的搜索引擎。

对于任意查询,它会返回准确的答案和相应的 URL。

看整个视频。 这真是太好了。

抄送: @gdb @npew @格温 pic.twitter.com/9ismj62w6l

— 帕拉斯乔普拉 (@paraschopra) 2020 年 7 月 19 日

虽然这种方法似乎可以直接导致通用 AI 能够像人类一样理解、推理和交谈,但 OpenAI 警告说他们可能遇到了基本的扩展问题,GPT-3 需要数千 petaflop/s-day 的计算,相比之下,完整的 GPT-2 需要数十 petaflop/s-days。 似乎距离我们更近了,但让我们所有工作都过时的突破还有一段距离。

阅读有关 GPT-3 的更多信息 在 GitHub 上。

用户论坛

0消息