Snowflake Arctic tự hào là "LLM tốt nhất cho AI doanh nghiệp". Đó là một tuyên bố khá lớn

Bạn có thể dùng thử Snowflake trên HuggingFace ngay bây giờ

2 phút đọc

Được đăng trên

Đọc trang tiết lộ của chúng tôi để tìm hiểu cách bạn có thể giúp MSPoweruser duy trì nhóm biên tập Tìm hiểu thêm

Ghi chú chính

- Snowflake giới thiệu Arctic, tuyên bố nó cạnh tranh với Llama 3 70B với chi phí thấp hơn.

- Arctic vượt trội trong các nhiệm vụ của doanh nghiệp như mã hóa và tạo SQL.

- Sử dụng Dense-MoE Hybrid, Arctic tối ưu hóa hiệu quả cho các quy mô lô khác nhau.

Snowflake, một gã khổng lồ về điện toán đám mây được thành lập ban đầu bởi các nhà khoa học cũ của Oracle, hiện đang thách thức những người chơi lớn trong cuộc chiến AI. Công ty đã đưa ra Bông tuyết Bắc Cực, “LLM tốt nhất dành cho AI doanh nghiệp” mới nhất của họ và tuyên bố rằng nó tốt hơn ngang bằng với Llama 3 70B và tốt hơn biến thể 8B của phiên bản sau.

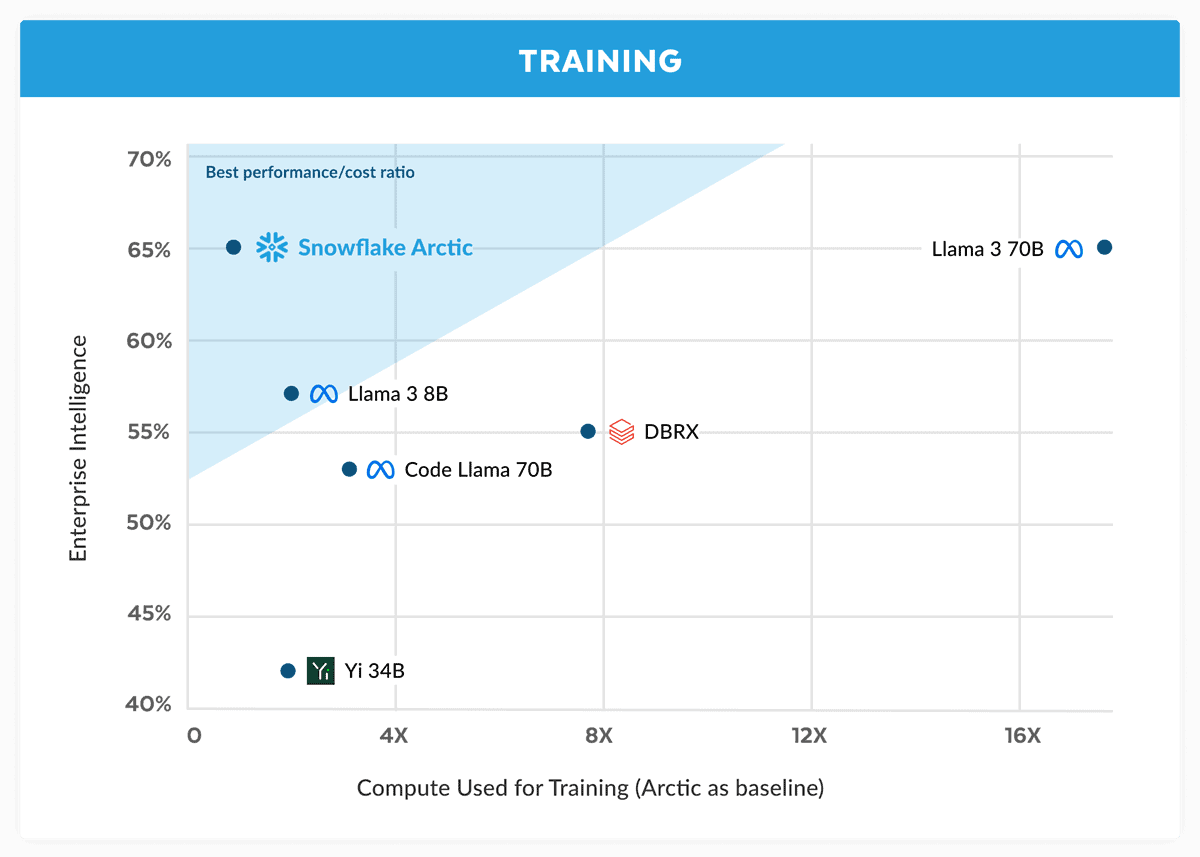

Trong thông báo của mình, Snowflake tuyên bố rằng mô hình Bắc Cực phù hợp với hiệu suất của Llama 3 70B nhưng với yêu cầu và chi phí tính toán thấp hơn. Nó được quảng cáo là lý tưởng cho các nhiệm vụ thông minh của doanh nghiệp trong các lĩnh vực và điểm chuẩn như mã hóa (HumanEval+ và MBPP+ ), tạo SQL (Spider) và tuân theo hướng dẫn (IFEval).

Đó là một tuyên bố lớn, đặc biệt khi xem xét rằng Lạc đà 3 70B đã thể hiện tốt so với các mẫu xe lớn khác như GPT-4 Turbo và Claude 3 Opus trong các bài kiểm tra quan trọng. Mô hình sắp ra mắt của Meta được cho là đạt điểm cao trong các tiêu chuẩn như MMLU (để hiểu các môn học), GPQA (sinh học, vật lý và hóa học cũng như HumanEval (mã hóa).

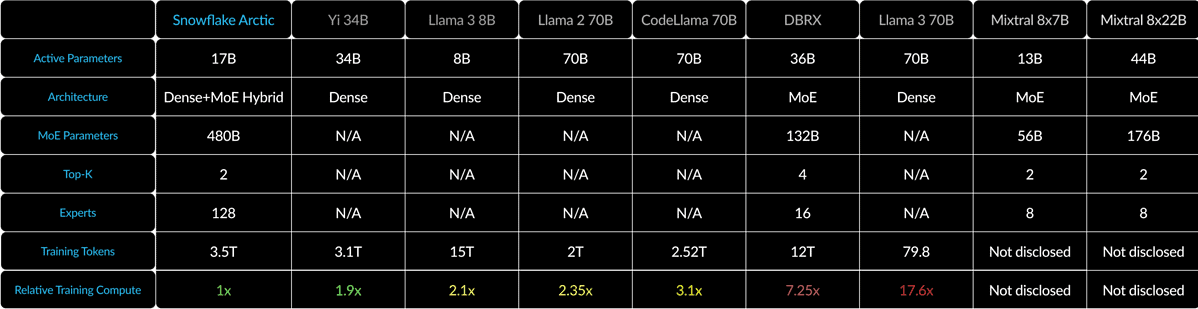

Snowflake Arctic kết hợp máy biến áp dày đặc 10B với MLP MoE 128×3.66B bằng cách sử dụng Dense-MoE Hybrid. Tổng cộng có 480B tham số, nhưng chỉ có 17B được sử dụng tích cực, được chọn với cổng top 2.

Đối với các kích thước lô nhỏ như 1, Arctic giảm số lần đọc bộ nhớ lên tới 4 lần so với Code-Llama 70B và ít hơn tới 2.5 lần so với Mixtral 8x22B. Tuy nhiên, khi kích thước lô tăng lên đáng kể, Bắc Cực sẽ bị ràng buộc bởi tính toán. Nó đòi hỏi khả năng tính toán ít hơn gấp 4 lần so với CodeLlama 70B và Llama 3 70B.

Bạn có thể dùng thử Snowflake Arctic trên ÔmKhuôn Mặt. Công ty cũng hứa rằng mô hình này sẽ sớm xuất hiện trên các vườn mô hình khác như AWS, Microsoft Azure, Perplexity, v.v.

Diễn đàn người dùng

Tin nhắn 0