Orca 2 là gì? Sự sụt giảm mới nhất của Microsoft có thể vượt trội so với các mẫu nhỏ hơn và cạnh tranh với các mẫu lớn hơn

2 phút đọc

Được đăng trên

Đọc trang tiết lộ của chúng tôi để tìm hiểu cách bạn có thể giúp MSPoweruser duy trì nhóm biên tập Tìm hiểu thêm

Cuộc đua AI đang ngày càng nóng lên. Bên cạnh việc thay đổi vai trò lãnh đạo tại OpenAI liên quan đến CEO (hiện là cựu) Sam Altman, hội đồng quản trị của công ty và Microsoft, gã khổng lồ công nghệ có trụ sở tại Redmond, đã “lặng lẽ” tung ra các mô hình ngôn ngữ nhỏ mới nhất của mình. Nó được gọi là Orca 2, và nhìn qua thì đây có thể là câu trả lời của Microsoft cho thách thức AI ngày càng tăng.

Orca 2 không chỉ nói chuyện mà còn đi bộ. Vượt trội hơn các mô hình có kích thước tương tự và đối đầu với các mô hình lớn hơn gần mười lần, đặc biệt là trong các nhiệm vụ phức tạp kiểm tra khả năng suy luận nâng cao, Orca 2 đang chứng tỏ giá trị của mình.

Có sẵn ở hai kích cỡ, 7 tỷ và 13 tỷ tham số, cả hai đều được tinh chỉnh trên dữ liệu tổng hợp đặc biệt, Microsoft cho biết họ đang tạo sức ép để công chúng "khuyến khích nghiên cứu" các mô hình ngôn ngữ nhỏ hơn.

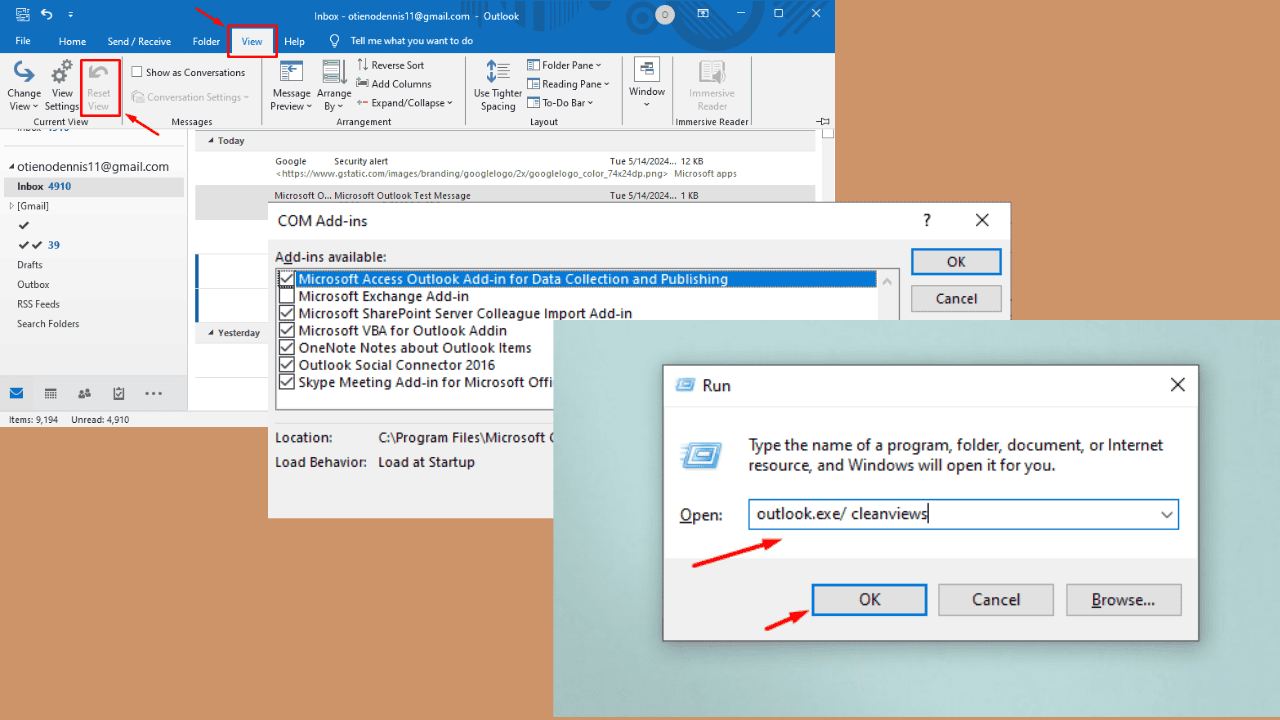

Hãy xem biểu đồ bên dưới để biết Orca 2 hoạt động như thế nào trên nhiều điểm chuẩn so với các mẫu khác có kích thước tương tự và thậm chí cả các mẫu lớn hơn 5-10 lần.

“Dữ liệu huấn luyện được tạo ra để dạy cho Orca 2 các kỹ thuật lý luận khác nhau, chẳng hạn như xử lý từng bước, thu hồi rồi tạo, thu hồi-lý do-tạo, trích xuất-tạo và các phương pháp trả lời trực tiếp, đồng thời dạy nó chọn chiến lược giải pháp khác nhau cho các nhiệm vụ khác nhau,” Microsoft cho biết trong thông báo chính thức.

Vài tháng trước, các nhà nghiên cứu của Redmond đã cho ra mắt phiên bản tiền nhiệm Orca 1 với 13 tỷ thông số. Bạn có thể đọc của Microsoft Giấy Orca 2 ở đây.