Snowflake Arctic, "kurumsal yapay zeka için en iyi Yüksek Lisans Diploması" olmakla gurur duyuyor. Bu oldukça büyük bir iddia

Snowflake'i şimdi HuggingFace'te deneyebilirsiniz

2 dk. okuman

Yayınlandı

MSPoweruser'ın editör ekibini ayakta tutmasına nasıl yardımcı olabileceğinizi öğrenmek için açıklama sayfamızı okuyun. Daha fazla

Önemli notlar

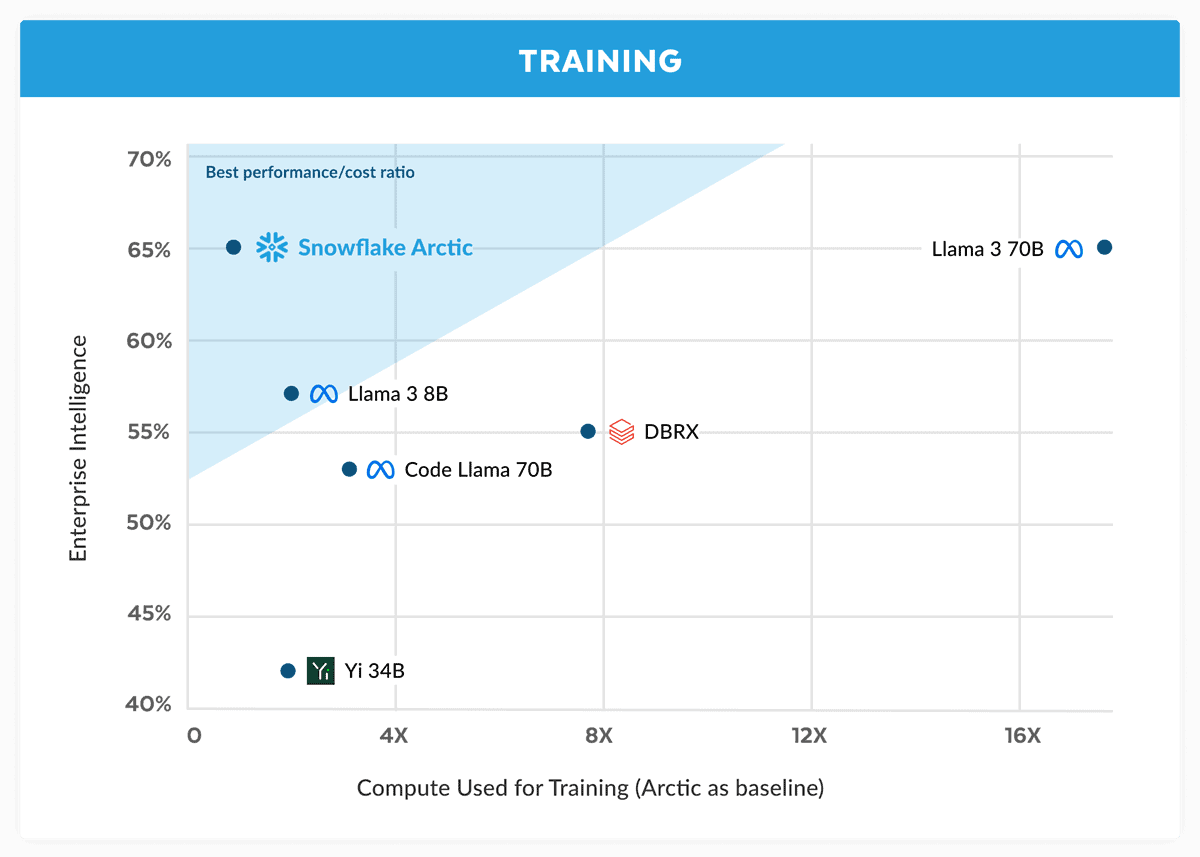

- Snowflake, daha düşük maliyetlerle Llama 3 70B'ye rakip olduğunu iddia ederek Arctic'i tanıttı.

- Arctic, kodlama ve SQL oluşturma gibi kurumsal görevlerde öne çıkıyor.

- Arctic, Yoğun MoE Hibritini kullanarak çeşitli parti boyutları için verimliliği optimize eder.

Başlangıçta eski Oracle bilim insanları tarafından kurulan bulut bilişim devi Snowflake, artık yapay zeka savaşında büyük oyunculara meydan okuyor. Şirket başlattı Kar Tanesi Arktik, en son "kurumsal yapay zeka için en iyi LLM" ve Llama 3 70B'den daha iyi olduğunu ve Llama 8 XNUMXB'nin XNUMXB varyantından daha iyi olduğunu iddia etti.

Snowflake, duyurusunda Arctic modelinin Llama 3 70B'nin performansına eşleştiğini ancak daha düşük bilgi işlem gereksinimleri ve maliyetlere sahip olduğunu iddia ediyor. Kodlama (HumanEval+ ve MBPP+), SQL oluşturma (Spider) ve talimat izleme (IFEval) gibi alanlarda ve kıyaslamalarda kurumsal zeka görevleri için ideal olduğu öne sürülüyor.

Bu büyük bir iddia, özellikle de şunu düşünürsek Lama 3 70B önemli testlerde GPT-4 Turbo ve Claude 3 Opus gibi diğer büyük modellere karşı iyi performans gösteriyor. Meta'nın yeni modelinin MMLU (konuları anlamak için), GPQA (biyoloji, fizik ve kimya) ve HumanEval (kodlama) gibi kriterlerde iyi puan aldığı bildiriliyor.

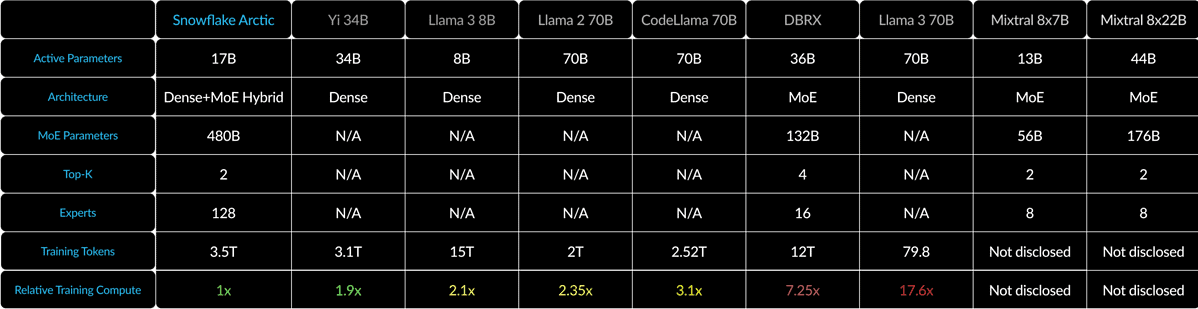

Snowflake Arctic, Yoğun MoE Hibrit kullanarak 10B yoğun transformatörü 128×3.66B MoE MLP ile karıştırıyor. Bunun toplamı 480B parametresidir, ancak ilk 17 geçitlemeyle seçilen yalnızca 2B aktif olarak kullanılır.

1 gibi küçük parti boyutları için Arctic, bellek okumalarını Code-Llama 4B'ye kıyasla 70 kata kadar ve Mixtral 2.5x8B'ye kıyasla 22 kata kadar azaltır. Ancak parti boyutları önemli ölçüde arttıkça Arctic hesaplamaya bağımlı hale geliyor. CodeLlama 4B ve Llama 70 3B'ye göre 70 kat daha az bilgi işlem gerektirir.

Snowflake Arctic'i deneyebilirsiniz SarılmaYüz. Şirket ayrıca modelin yakında AWS, Microsoft Azure, Perplexity ve daha fazlası gibi diğer model bahçelerine de ulaşacağının sözünü veriyor.

Kullanıcı forumu

0 mesajları