OpenAI:s GPT-4o-modell nu tillgänglig i Azure OpenAI Service

1 min. läsa

Uppdaterad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

Viktiga anteckningar

- Den här innovativa modellen kombinerar text, bilder och ljud för att revolutionera hur vi interagerar med AI och skapar ett nytt riktmärke för kreativa och konverserande AI-upplevelser.

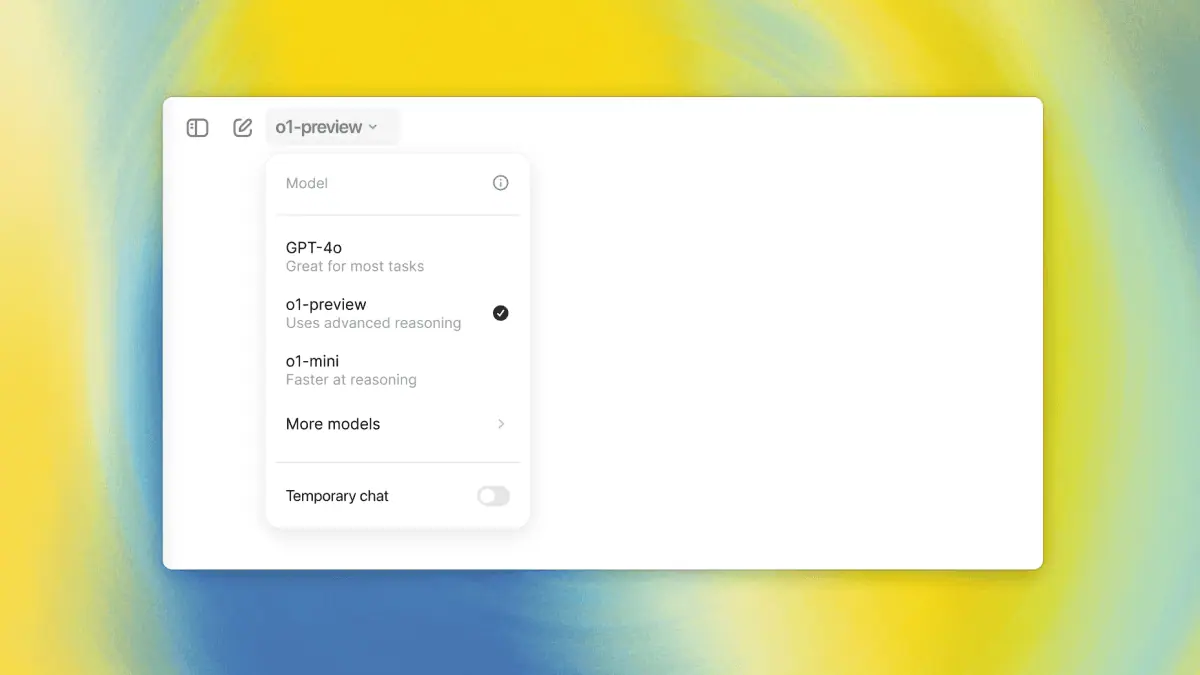

Igår, OpenAI lanserades dess flaggskeppsmodell, GPT-4o. Den nya GPT-4o-modellen är 2 gånger snabbare, 50 % billigare (7 USD för miljoner tokens) och kommer med stöd för upp till 10 miljoner tokens per minut. Modellen har 128K-kontext och en kunskapsgräns för oktober 2023. Microsoft har meddelade den GPT-4o-modellen är nu tillgänglig i förhandsvisning via Azure OpenAI Service.

Den här nya modellen kombinerar sömlöst text, bilder och ljud för att erbjuda en rikare, mer engagerande användarupplevelse. Den första versionen av modellen stöder endast text och bilder. I framtiden kommer det att lägga till stöd för ljud och video.

Azure OpenAI Service-användare kan prova GPT-4os funktioner genom en förhandsvisningslekplats i Azure OpenAI Studio börjar nu i två regioner i USA.

Microsoft kommer att dela mer om GPT-4o och andra Azure AI-uppdateringar på Microsoft Build 2024 konferens som äger rum senare denna månad.

Du kan lära dig mer om GPT-4os prestanda här..

Användarforum

0 meddelanden