Microsoft avslöjar "PyRIT"-verktygssatsen för att skydda generativa AI-system

2 min. läsa

Publicerad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

Viktiga anteckningar

-

Mjukvarujätten introducerar ramverk med öppen källkod för att göra det möjligt för säkerhetspersonal att proaktivt lokalisera sårbarheter i AI-modeller.

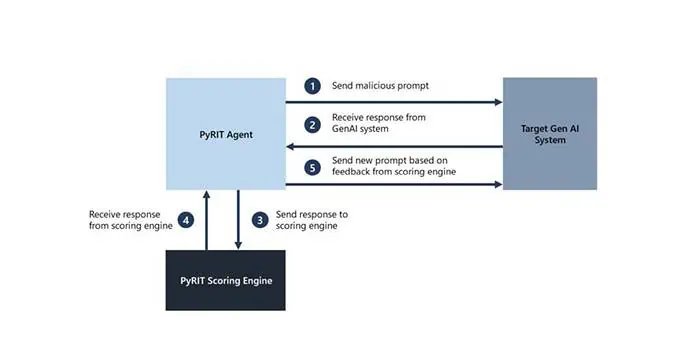

Microsoft idag meddelade lanseringen av PyRIT (Python Risk Identification Toolkit), ett automationsramverk med öppen källkod som ger säkerhetsteam möjlighet att identifiera risker inom generativa AI-system. Flytten understryker Microsofts djupa engagemang för ansvarsfull AI-utveckling och att bygga säkra verktyg för det snabbt växande generativa AI-landskapet.

AI Red Teaming Automation: En nödvändighet

Red teaming, processen att simulera attacker för att testa försvar, är avgörande för generativ AI. Dessa system är dock komplexa, med flera felpunkter, till skillnad från traditionell programvara. Microsofts omfattande erfarenhet av AI red teaming ledde till skapandet av PyRIT, som tar itu med de unika utmaningar som generativ AI utgör.

"Även om automatisering inte helt kan ersätta mänskliga röda teamers, är det viktigt för att skala ansträngningar och lyfta fram områden som kräver djupare undersökningar," sa Microsoft.

PyRIT: Nyckelfunktioner och fördelar

- anpassnings~~POS=TRUNC: Fungerar med olika generativa AI-modeller och kan utökas för att stödja nya indatatyper (t.ex. bilder, video).

- Riskfokuserade datamängder: Möjliggör testning för både säkerhetsproblem och potentiella fördomar eller felaktigheter.

- Flexibel poängmotor: Tillåter poängsättning av AI-utgångar med hjälp av maskininlärning eller direkta LLM:er för självtestning.

- Attackstrategier för flera svängar: Simulerar mer realistiska, ihållande attacker för djupgående testning.

- Minneskapacitet: Underlättar analys och möjliggör längre, mer komplexa interaktioner.

Branschövergripande påverkan

PyRIT:s release kommer att skapa vågor inom AI-säkerhetsbranschen. Microsoft uppmuntrar organisationer över olika sektorer att använda PyRIT i sina generativa AI-säkerhetsansträngningar. Företaget inbjuder också till samarbete och betonar att en samlad insats är avgörande för att bygga robusta försvar mot nya AI-risker.

Det är viktigt att notera att PyRIT inte är en ersättning för manuell red teaming av generativa AI-system. Istället utökar det en AI red teamers befintliga domänexpertis och automatiserar de tråkiga uppgifterna för dem.

Du kan komma igång med PyRIT-projektet här..