Stability AI выпускает Stable LM 2 1.6B, который превосходит модель Microsoft Phi-2 2.7B

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

Модели малых языков (SLM) в наши дни становятся довольно популярными. С прошлого года Microsoft Research выпуска набор малых языковых моделей (SLM) под названием «Phi». В декабре Microsoft Research опубликовала Модель Фи-2 с 2.7 миллиардами параметров. Эта новая модель обеспечила высочайшую производительность среди моделей базового языка с менее чем 13 миллиардами параметров.

Сегодня Стабильность ИИ объявил выпуск Stable LM 2 1.6B, современной модели небольшого языка с 1.6 миллиарда параметров, обученной на многоязычных данных на английском, испанском, немецком, итальянском, французском, португальском и голландском языках.

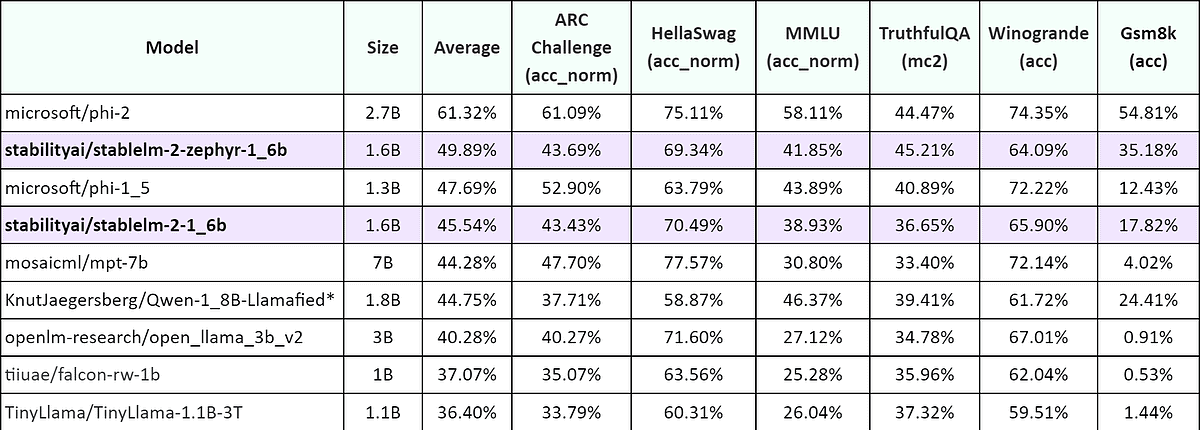

По сравнению с другими популярными моделями малых языков, такими как Microsoft Phi-1.5 (1.3B) и Phi-2 (2.7B), TinyLlama 1.1B или Falcon 1B, Stable LM 2 1.6B лучше справляется с большинством задач. Вы можете проверить данные тестов ниже.

Поскольку эта модель также обучается на многоязычном тексте, она значительно превосходит другие сопоставимые модели в переведенные версии ARC Challenge, HellaSwag, TruthfulQA, MMLU и LAMBADA.

«Выпуская одну из самых мощных на сегодняшний день моделей малого языка и обеспечивая полную прозрачность деталей ее обучения, мы стремимся дать разработчикам и создателям моделей возможность экспериментировать и быстро выполнять итерации», — пишет команда Stability AI.

Стабильная модель LM 2 1.6B теперь доступна как коммерчески, так и некоммерчески с Стабильность AI Членство. Вы можете изучить модель на Обнимая лицо сейчас.