OpenAI присоединяется к руководящему комитету C2PA

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

Ключевые заметки

- OpenAI присоединяется к Коалиции за происхождение и подлинность контента (C2PA) и разрабатывает новые методы нанесения водяных знаков.

Коалиция за происхождение и подлинность контента (C2PA) разрабатывает технические стандарты для сертификации источника и истории (или происхождения) медиаконтента. Проект C2PA изначально был запущен Adobe, Arm, Intel, Microsoft и Truepic.

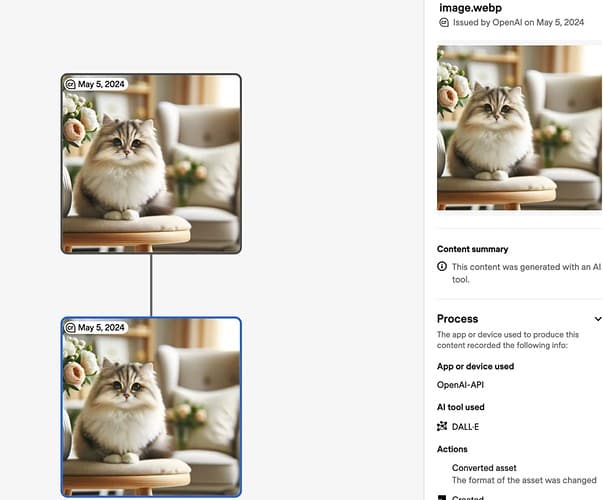

Сегодня ОпенАИ объявил что он присоединяется к Руководящему комитету C2PA. OpenAI будет способствовать разработке стандарта. Важно отметить, что OpenAI начала добавлять метаданные C2PA ко всем изображениям, созданным и отредактированным DALL·E 3, в начале этого года. В будущем OpenAI будет интегрировать метаданные C2PA для Sora. Как и другие метаданные, люди по-прежнему могут удалять метаданные из контента, созданного ИИ, но они не могут легко подделать или изменить эту информацию.

Помимо присоединения к комитету C2PA, OpenAI также разрабатывает новые методы происхождения для улучшения целостности цифрового контента. Например, они разрабатывают защищенные от несанкционированного доступа водяные знаки — инструменты, которые используют ИИ для точного определения вероятности контента, созданного на основе генеративных моделей. С сегодняшнего дня OpenAI открывает приложения для доступа к классификатору обнаружения изображений OpenAI для группы тестировщиков. Заявки на доступ к этому новому инструменту можно подать здесь.

Наконец, OpenAI включила звуковые водяные знаки в Voice Engine, свою собственную модель голоса, которая в настоящее время находится на стадии ограниченного предварительного исследования.

«Хотя технические решения, подобные описанным выше, дают нам активные инструменты для нашей защиты, эффективное обеспечение подлинности контента на практике потребует коллективных действий. Например, платформы, создатели контента и промежуточные обработчики должны облегчить сохранение метаданных, чтобы обеспечить прозрачность для конечного потребителя контента в отношении источника контента», — написала команда OpenAI, делая вышеупомянутые объявления.