Microsoft Orca-Math — небольшая языковая модель, которая превосходит GPT-3.5 и Gemini Pro при решении математических задач.

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

Ключевые заметки

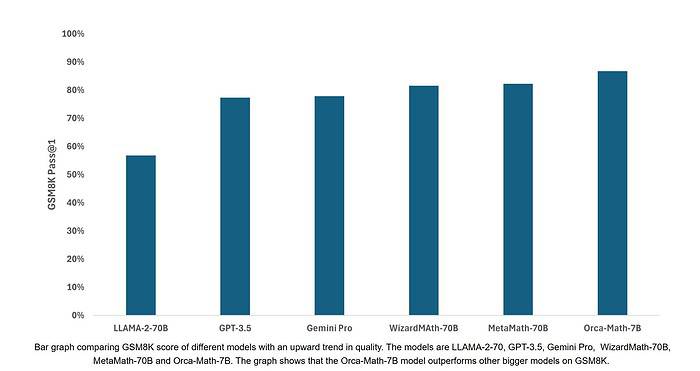

- Согласно тестам, Orca-Math достигла 86.81% при проходе GSM8k@1.

- Это число превосходит LLAMA-2-70 от Meta, Gemini Pro от Google, GPT-3.5 от OpenAI и даже математические модели, такие как MetaMath-70B и WizardMa8th-70B.

Исследования Microsoft сегодня объявило Orca-Math, небольшая языковая модель (SLM), которая может превзойти гораздо более крупные модели, такие как Gemini Pro и GPT-3.5, при решении математических задач. Orca-Math демонстрирует, как специализированные SLM могут преуспеть в конкретных областях, превосходя даже более крупные модели. Важно отметить, что данная модель не была создана компанией Microsoft с нуля, а была создана путем доработки модели Mistral 7B.

Согласно тестам, Orca-Math достигла 86.81% при проходе GSM8k@1. Это число превосходит LLAMA-2-70 от Meta, Gemini Pro от Google, GPT-3.5 от OpenAI и даже математические модели, такие как MetaMath-70B и WizardMa8th-70B. Важно отметить, что базовая модель Мистраль-7Б, на базе которой была построена Orca-Math, набрала лишь 37.83% на GSM8K.

Microsoft Research удалось добиться такой впечатляющей производительности, используя следующие методы:

- Высококачественные синтетические данные: Orca-Math обучалась на наборе данных 200,000 XNUMX математических задач, тщательно созданный с использованием мультиагентов (AutoGen). Хотя этот набор данных меньше, чем некоторые другие наборы математических данных, он обеспечивает более быстрое и экономически эффективное обучение.

- Итеративный процесс обучения: В дополнение к традиционной контролируемой тонкой настройке, Orca-Math подверглась итеративному процессу обучения. Он практиковался в решении проблем и постоянно совершенствовался на основе обратной связи от «учителя».

«Наши результаты показывают, что модели меньшего размера ценны в специализированных условиях, где они могут соответствовать производительности гораздо более крупных моделей, но с ограниченными возможностями. Обучая Orca-Math на небольшом наборе данных из 200,000 XNUMX математических задач, мы достигли уровня производительности, который конкурирует или превосходит показатели гораздо более крупных моделей», — написала исследовательская группа Microsoft.