Microsoft Azure AI представляет «Prompt Shields» для борьбы с манипуляциями с LLM

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

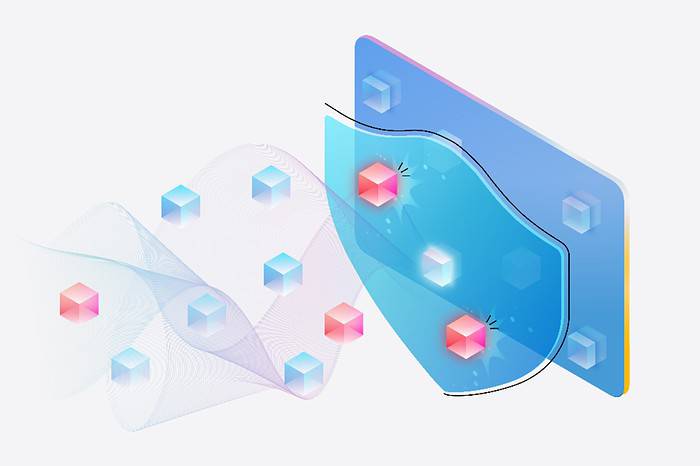

Microsoft сегодня объявило значительное улучшение безопасности для платформ Azure OpenAI Service и Azure AI Content Safety. Новая функция, получившая название «Быстрые щиты», обеспечивает надежную защиту от все более изощренных атак, нацеленных на большие языковые модели (LLM).

Prompt Shields защищает от:

- Прямые атаки: Эти попытки, также известные как атаки с побегом из тюрьмы, явно инструктируют LLM игнорировать протоколы безопасности или выполнять вредоносные действия.

- Косвенные атаки: Эти атаки незаметно встраивают вредоносные инструкции в, казалось бы, обычный текст, стремясь обмануть LLM и заставить его вести себя нежелательно.

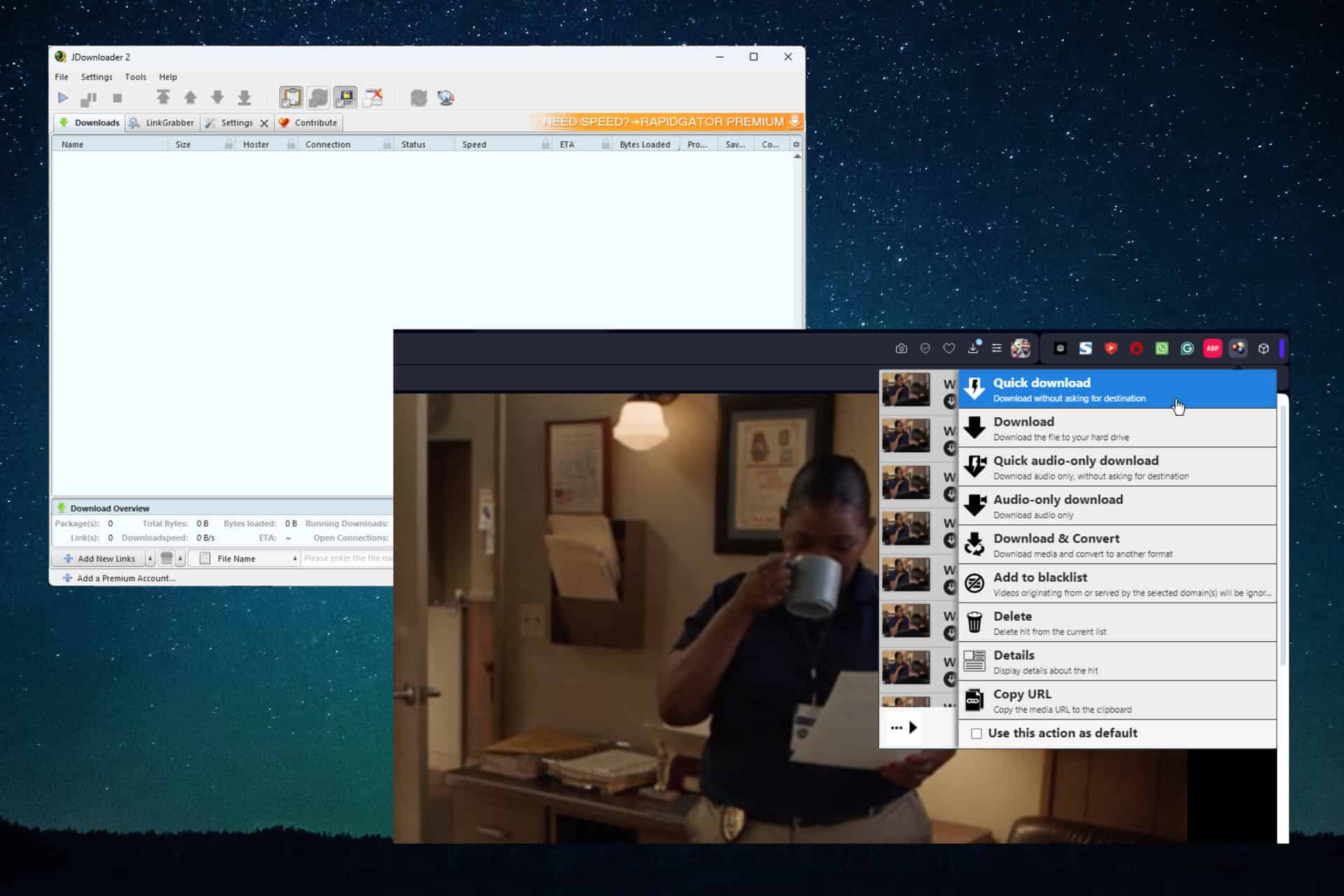

Prompt Shields интегрирован с фильтрами содержимого службы Azure OpenAI и доступен в Azure AI Content Safety. Благодаря передовым алгоритмам машинного обучения и обработке естественного языка Prompt Shields может выявлять и нейтрализовать потенциальные угрозы в пользовательских подсказках и сторонних данных.

В центре внимания: новая техника защиты

Microsoft также представила «Spotlighting» — специализированный метод оперативного проектирования, предназначенный для предотвращения непрямых атак. Методы выделения, такие как разграничение и маркировка данных, помогают специалистам LLM четко различать законные инструкции и потенциально опасные встроенные команды.

Доступность

Prompt Shields в настоящее время находится в общедоступной предварительной версии в рамках безопасности содержимого Azure AI и будет доступен в службе Azure OpenAI 1 апреля. Интеграция с Azure AI Studio планируется в ближайшем будущем.