Возможно, вам придется немного подождать, чтобы получить возможность загрузки изображения для мультимодальной функции Bing.

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

OpenAI официально выпустила GPT-4, и Microsoft сообщила, что модель «настроена для поиска». Частью этого захватывающего открытия является мультимодальная способность модели, позволяющая ей обрабатывать изображения. Однако эта функция по-прежнему ограничена даже в Bing. Более того, загрузка изображений для использования этой функции может быть еще далекой, как намекнул один из сотрудников Microsoft.

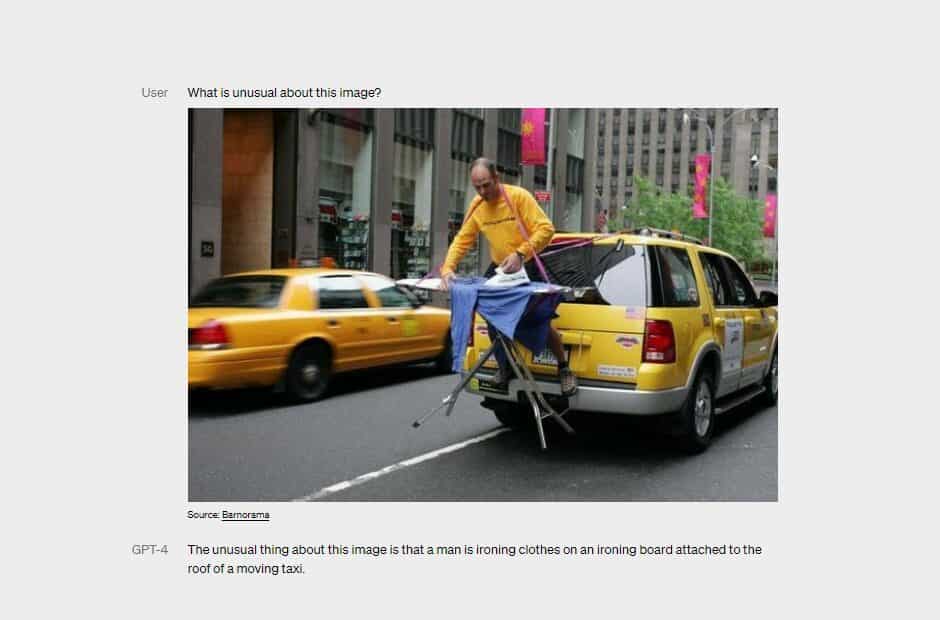

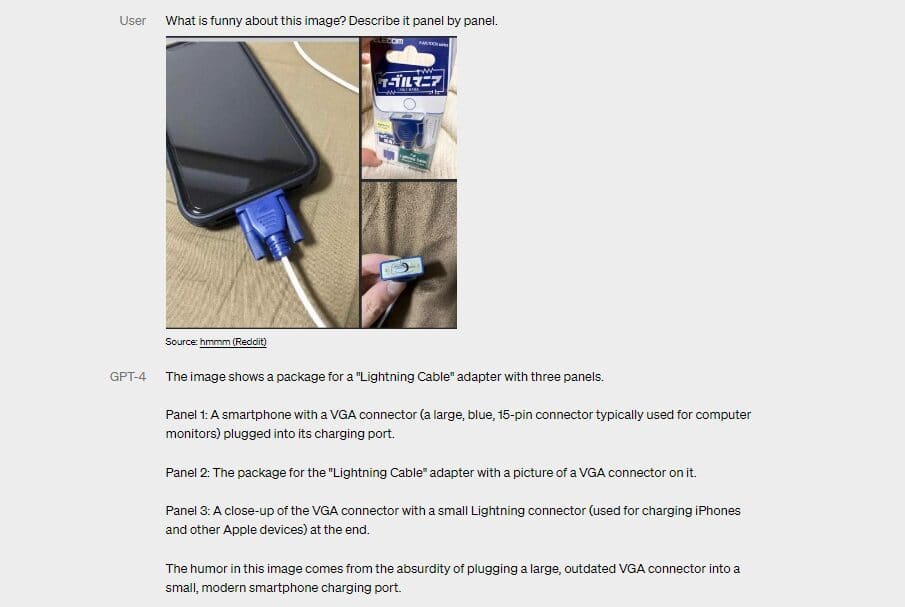

Мультимодальность — самая большая изюминка последней модели OpenAI. И хотя GPT-4 уже доступен подписчики ChatGPT Plus, эта функция все еще находится на стадии тестирования, что делает ее недоступной для всех. Тем не менее, OpenAI продемонстрировала в своем недавнем сообщении в блоге, как мультимодальность будет работать в GPT-4, который в основном может описывать и интерпретировать загруженные изображения.

Wow Bing теперь может описывать изображения, теперь, когда он знает, что использует GPT-4!

byu/BroskiPlaysYT inБинг

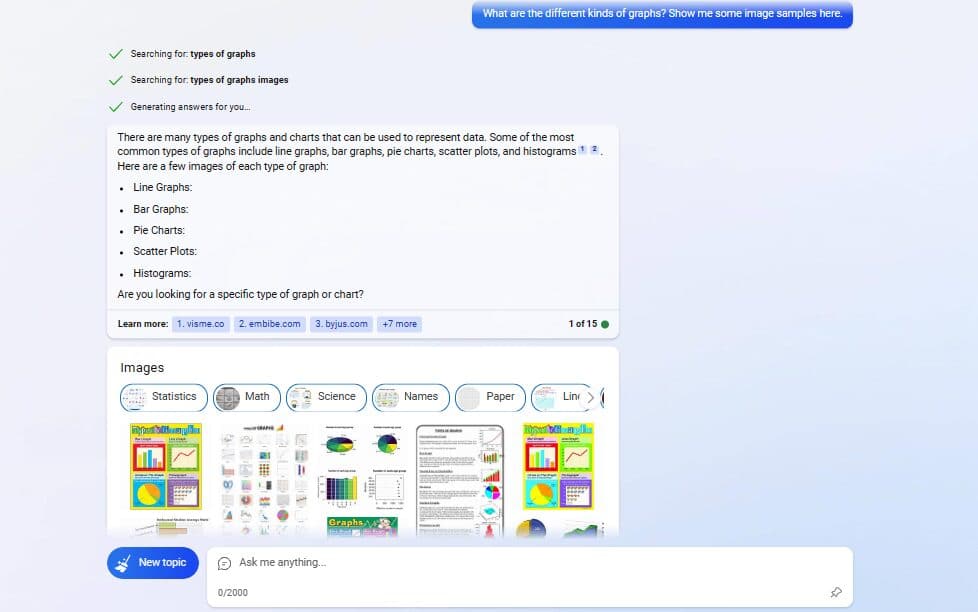

Эта мультимодальная возможность, по-видимому, доступна сейчас на новый Бинг, хотя и не полностью. Для начала пользователи могут попросить Bing Chat описать изображения, используя ссылки на изображения, взятые из Интернета, и он сгенерирует ответ. Кроме того, чат-бот теперь будет включать изображения в свой процесс, особенно если вы попросите его.

С другой стороны, возможность напрямую загрузить изображение в Bing для описания или анализа по-прежнему недоступна. Появление этой опции было недавно поднято пользователем на Twitter Михаилу Парахину, главе Microsoft по рекламе и веб-сервисам, который предположил, что пока это не является приоритетом для компании.

Это намного дороже, нам нужно сначала широко развернуть текущий функционал. Все дело в привлечении большего количества графических процессоров.

— Михаил Парахин (@MParakhin) 14 марта 2023

Чтобы сделать это возможным, Парахин отметил необходимость «большего количества графических процессоров» и сказал, что делать это «гораздо дороже». В недавнем отчетMicrosoft сообщила, что уже потратила сотни миллионов долларов на создание суперкомпьютера ChatGPT, связав тысячи графических процессоров Nvidia на своей платформе облачных вычислений Azure. При этом, если слова Парахина воспринимать всерьез, Microsoft, возможно, захочет потратить больше, чтобы полностью внедрить мультимодальную функцию в Bing. И судя по тому, что сказал Парахин, это возможно, только не сегодня.