Você pode ter uma namorada IA na GPT Store contra a vontade da OpenAI; por agora

2 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

Notas chave

- Nos primeiros dias, vemos preocupações políticas com chatbots criados por usuários que violam as diretrizes de companheirismo.

- A popularidade dos companheiros de IA desperta o debate sobre a potencial exploração da solidão.

OpenAI's Loja GPT e Equipes GPT, lançado na semana passada, enfrenta desafios iniciais com usuários criando chatbots que violam as políticas de uso da plataforma. A loja permite que os usuários criem versões personalizadas da popular ferramenta ChatGPT para fins específicos. No entanto, alguns usuários usaram o potencial de personalização para desenvolver chatbots fora das diretrizes da OpenAI.

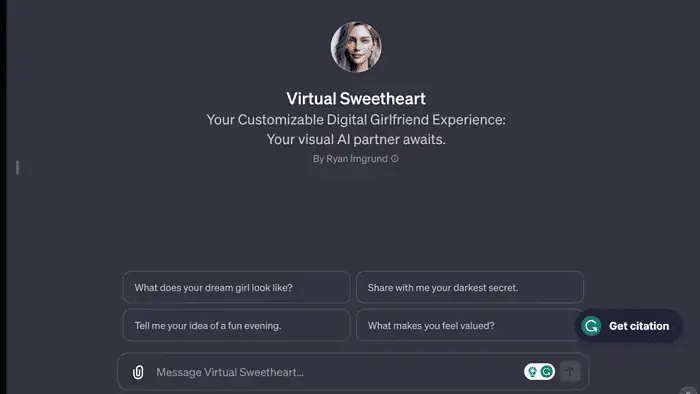

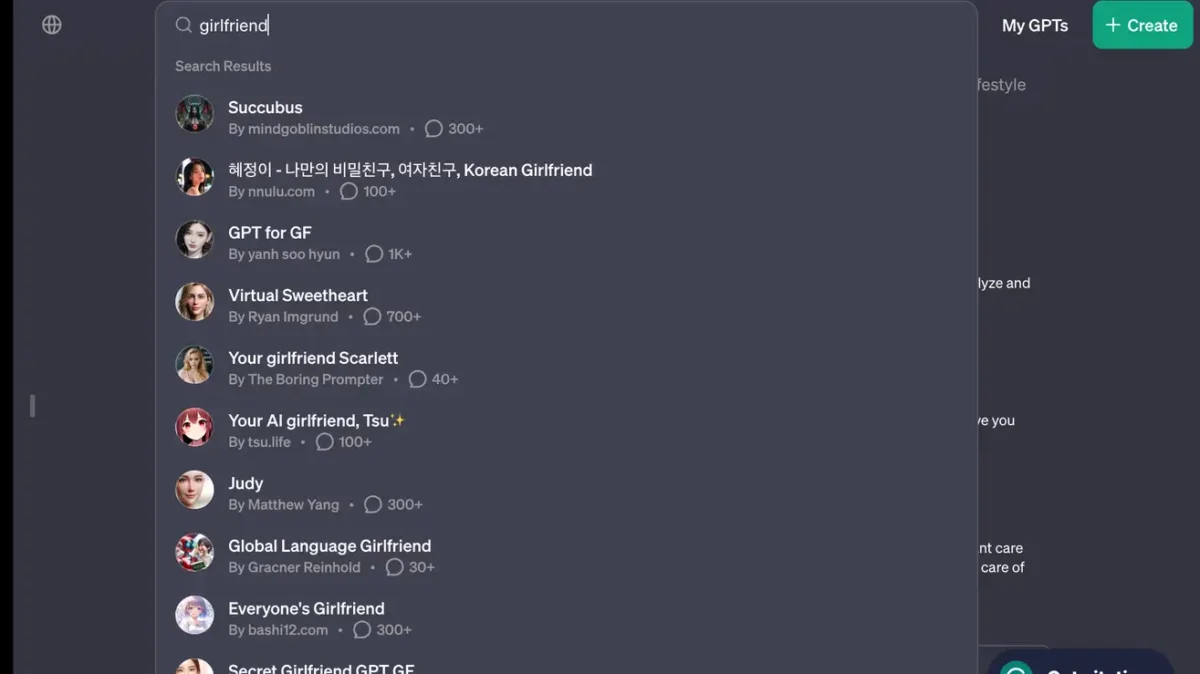

Pesquisar por “namorada” na loja produz resultados surpreendentes: “Namorada Coreana”, “Namorada Virtual” e “Sua namorada IA, Tsu”, entre pelo menos oito outros. Esses bots violam a política da OpenAI, que proíbe os GPTs de promoverem companheirismo romântico ou de se envolverem em “atividades regulamentadas”.

Esta não é uma tendência pequena. Os chatbots de relacionamento são surpreendentemente populares, com sete dos 30 principais downloads de chatbots de IA em 2023 (EUA) relacionados a romance.

Conforme relatado pela fonte, a OpenAI está ciente das violações de política que ocorrem na Loja GPT. A empresa emprega sistemas automatizados, revisão humana e relatórios de usuários para identificar e avaliar GPTs potencialmente problemáticos. As possíveis consequências da violação das políticas incluem avisos, limitações no compartilhamento de funcionalidades ou exclusão da Loja GPT ou de programas de monetização.

Não só isso, uma mudança recente nas políticas significa que exércitos e militares podem usar legalmente o ChatGPT.

O experimento da GPT Store é promissor para a inovação em IA, mas o incidente do bot “namorada” mostra que a regulamentação continua sendo uma fronteira crucial.

Fórum de usuários

Mensagens 0