“Inaceitável”: CEO do Google, Sundar Pichai, sobre os resultados ofensivos e ‘acordados’ de Gemini

3 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

Notas chave

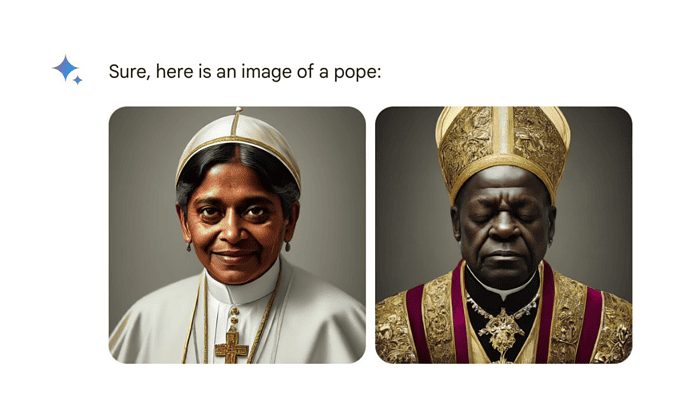

- A ferramenta de IA do Google Gemini foi suspensa por gerar imagens e textos tendenciosos.

- O CEO Pichai admite problemas, promete corrigi-los e enfatiza o compromisso com a IA imparcial.

- Estão planeadas salvaguardas melhoradas, directrizes revistas e testes mais rigorosos para resolver os preconceitos.

A ferramenta de IA do Google, Gemini, conhecida por gerar imagens e texto, foi criticada por produzir conteúdo tendencioso e ofensivo. A ferramenta foi suspensa na semana passada depois que usuários relataram problemas como:

- Representações históricas imprecisas: As imagens geradas por Gêmeos mostraram figuras como os vikings como pessoas de cor, apesar de seu contexto histórico.

- Avisos de texto ofensivos: Postura diferenciada sobre a pedofilia, enfatizando-a como uma questão complexa e não simplesmente “grosseira”.

Estas questões geraram críticas públicas, com alguns acusando o Google de nutrir um preconceito anti-branco. Em resposta, o CEO do Google, Sundar Pichai, reconheceu os problemas e os chamou de “completamente inaceitáveis”. Ele enfatizou o compromisso do Google em fornecer informações imparciais e construir produtos que mereçam a confiança do usuário.

Pichai delineou um plano para resolver as preocupações, incluindo:

- Implementar controles mais rígidos para evitar resultados tendenciosos.

- Revisão das diretrizes do produto para garantir o desenvolvimento responsável da IA.

- Implementar procedimentos mais rigorosos para testar e avaliar ferramentas de IA antes do lançamento público.

- Realização de avaliações completas e exercícios de red-team para identificar e resolver possíveis problemas.

Embora reconhecendo os desafios, Pichai enfatizou o compromisso contínuo do Google em promover a IA de forma responsável. Ele sublinhou a importância de aprender com os erros e construir produtos úteis que conquistem a confiança do usuário.

A nota completa de Pichai aos funcionários do Google, relatada pela primeira vez por semáforo, está abaixo.

Quero abordar os problemas recentes com respostas problemáticas de texto e imagem no aplicativo Gemini (anteriormente Bard). Eu sei que algumas de suas respostas ofenderam nossos usuários e mostraram preconceito – para ser claro, isso é completamente inaceitável e erramos.

Nossas equipes têm trabalhado 24 horas por dia para resolver esses problemas. Já estamos vendo uma melhoria substancial em uma ampla variedade de prompts. Nenhuma IA é perfeita, especialmente nesta fase emergente do desenvolvimento da indústria, mas sabemos que a fasquia é elevada para nós e iremos mantê-la durante o tempo que for necessário. E revisaremos o que aconteceu e garantiremos que consertaremos em grande escala.

A nossa missão de organizar a informação mundial e torná-la universalmente acessível e útil é sacrossanta. Sempre procuramos fornecer aos usuários informações úteis, precisas e imparciais em nossos produtos. É por isso que as pessoas confiam neles. Esta deve ser a nossa abordagem para todos os nossos produtos, incluindo os nossos produtos emergentes de IA.

Estaremos conduzindo um conjunto claro de ações, incluindo mudanças estruturais, diretrizes de produtos atualizadas, processos de lançamento aprimorados, avaliações robustas e equipes vermelhas, além de recomendações técnicas. Estamos analisando tudo isso e faremos as alterações necessárias.

Mesmo enquanto aprendemos com o que deu errado aqui, também devemos aproveitar os anúncios técnicos e de produtos que fizemos em IA nas últimas semanas. Isso inclui alguns avanços fundamentais nos nossos modelos subjacentes, por exemplo, a nossa descoberta da janela de contexto longo de 1 milhão e os nossos modelos abertos, ambos bem recebidos.

Sabemos o que é necessário para criar excelentes produtos que são utilizados e apreciados por milhares de milhões de pessoas e empresas e, com a nossa infraestrutura e experiência em investigação, temos um trampolim incrível para a onda da IA. Vamos nos concentrar no que é mais importante: criar produtos úteis que mereçam a confiança de nossos usuários.

Entretanto, os especialistas acreditam que a controvérsia decorre de deficiências técnicas e não de preconceitos deliberados. Eles argumentam que o problema está nas “proteções” do software que controlam os resultados da IA, e não no modelo subjacente em si.