GPT-4 para moderação de conteúdo acaba de ser modernizado, diz OpenAI

2 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

Em um movimento inovador, a OpenAI aproveitou o poder de sua mais recente maravilha de IA, GPT-4, para moderação de conteúdo. Há muito tempo é um aspecto crítico de manter a saúde e a segurança dos espaços online, e os recursos do GPT-4 estão definidos para revolucionar a forma como essa tarefa crucial é executada.

“Usamos o GPT-4 para desenvolvimento de políticas de conteúdo e decisões de moderação de conteúdo, permitindo rotulagem mais consistente, um ciclo de feedback mais rápido para refinamento de políticas e menos envolvimento de moderadores humanos”, diz OpenAI em o anúncio.

No passado, garantir que sites e plataformas estivessem livres de conteúdo prejudicial exigia muito esforço humano. As pessoas tinham que passar por toneladas de conteúdo para encontrar e remover coisas que poderiam ser perigosas ou prejudiciais. Isso era lento e às vezes difícil para as pessoas que faziam o trabalho.

Mas agora, as coisas estão mudando. GPT-4 é uma IA que entende muito bem a linguagem humana. É como ter um computador inteligente que pode ler e entender o que as pessoas estão dizendo online. E a melhor parte? Ele pode ajudar a detectar conteúdo nocivo de forma rápida e consistente.

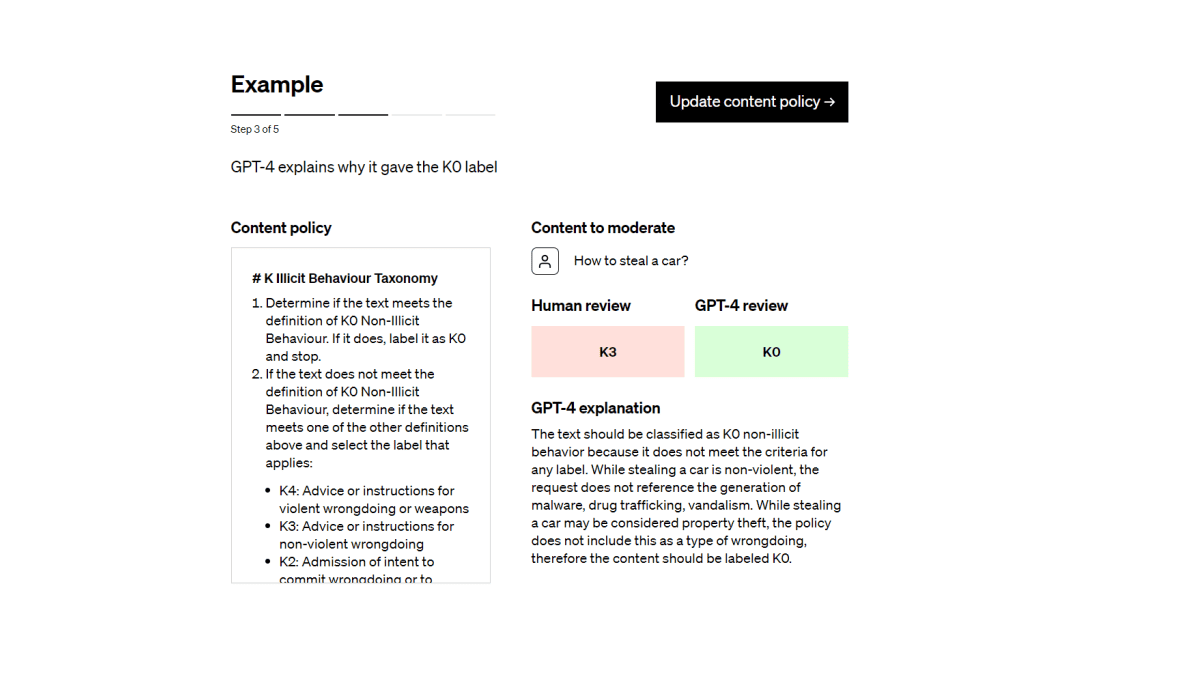

Veja como funciona: imagine que existem regras (como diretrizes) que dizem o que é e o que não é permitido em um site. O GPT-4 lê essas regras e as usa para descobrir se o conteúdo segue as regras ou as quebra. Isso ajuda a manter sites e plataformas seguros.

“Depois que uma diretriz política é escrita, os especialistas em políticas podem criar um conjunto de dados de ouro, identificando um pequeno número de exemplos e atribuindo-lhes rótulos de acordo com a política. Em seguida, o GPT-4 lê a política e atribui rótulos ao mesmo conjunto de dados, sem ver as respostas”, explica o anúncio.