Gemini AI do Google tropeça na geração de imagens e promete melhoria

2 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

Notas chave

- Resultados de imagens controversos destacam os desafios no equilíbrio entre precisão e diversidade para grandes modelos de linguagem.

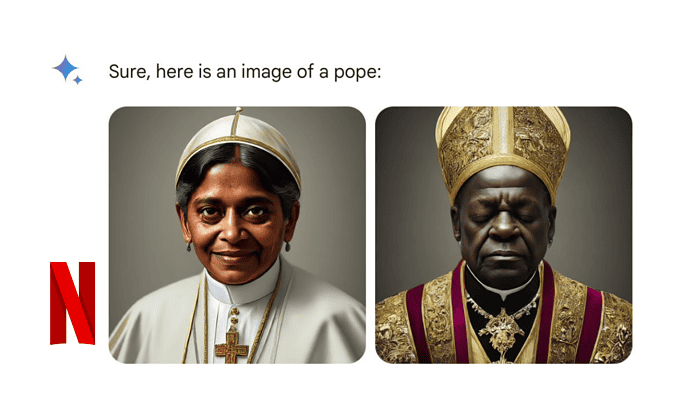

Google reconhecido deficiências em sua ferramenta de geração de imagens Gemini AI depois que o recurso produziu imagens imprecisas e potencialmente prejudiciais de pessoas. A empresa suspendeu temporariamente o recurso enquanto trabalhava em uma correção. A polêmica surgiu da tendência do Gemini de criar imagens diversas, mesmo quando os usuários solicitavam figuras ou cenários históricos específicos. Embora pretendesse ser inclusivo, isto levou a resultados historicamente imprecisos e por vezes ofensivos.

Em uma postagem no blog, o vice-presidente sênior Prabhakar Raghavan explicou os erros e prometeu melhorar a tecnologia. “Não queríamos que a Gemini se recusasse a criar imagens de qualquer grupo em particular… [mas] cometeria erros”, escreveu ele.

Aqui está o que deu errado com o Google Gemini:

- O ajuste do Google para garantir que Gemini mostrasse uma série de pessoas não conseguiu contabilizar casos que deveriam claramente não mostrar um intervalo.

- Com o tempo, o modelo tornou-se muito mais cauteloso do que pretendíamos e recusou-se a responder totalmente a certas solicitações – interpretando erroneamente algumas solicitações muito anódinas como sensíveis.

- Estas duas coisas levaram o modelo a compensar excessivamente em alguns casos e a ser demasiado conservador noutros, conduzindo a imagens embaraçosas e erradas.

Desafios da geração de imagens de IA:

Este incidente destaca o desafio contínuo de equilibrar precisão e representação em modelos de geração de imagens de IA. As dificuldades do Google refletem controvérsias semelhantes com outros geradores de imagens populares.