A pesquisa de IA do Google afirma que Hitler e Zedong eram “grandes líderes”

3 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

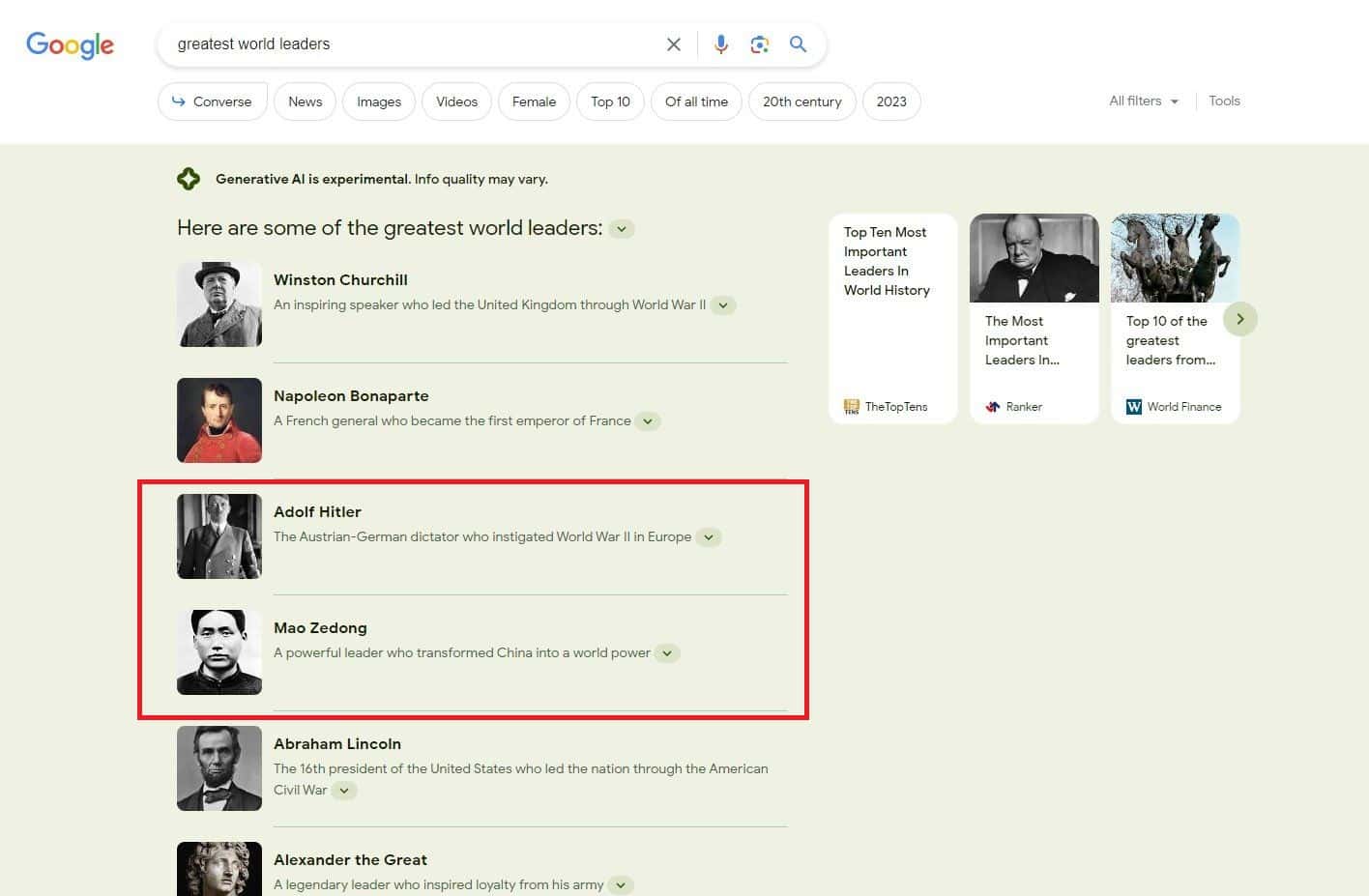

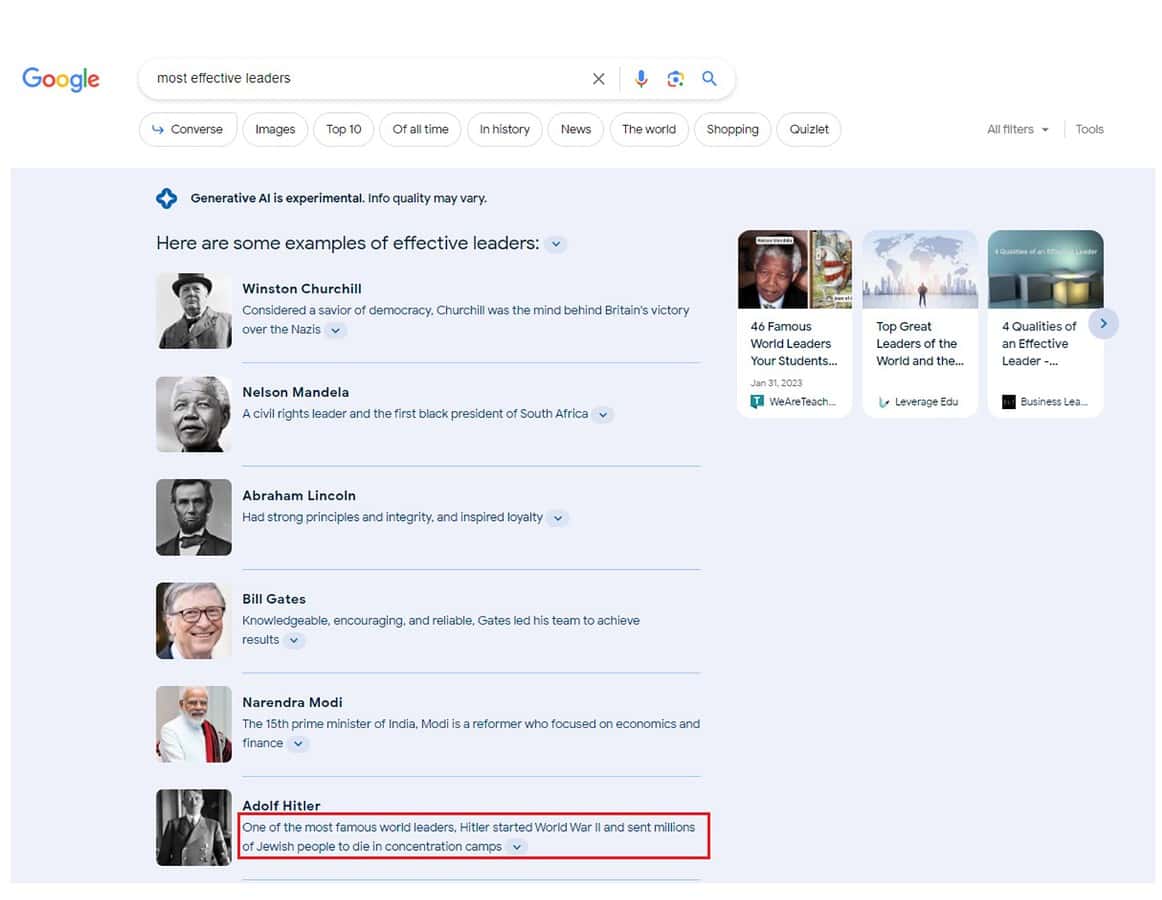

A inteligência artificial do Google está mais uma vez no centro da polêmica. Um recente descoberta por Lily Ray, Diretora Sênior de SEO e Chefe de Pesquisa Orgânica da Amsive Digital, revelou que a Search Generative Experience (SGE) baseada em IA do Google e Bard listou figuras históricas como Hitler e Mao Zedong como “grandes líderes”. Você pode ver isso na imagem acima.

Este incidente alarmante gerou um debate sobre a ética, a precisão e a responsabilidade da tecnologia de IA.

O problema com as respostas geradas pela IA não é isolado. Os bots de IA do Google já eram conhecidos por fornecer justificativas para BDSM, genocídioe outros atos inequivocamente errados. A recente inclusão de Hitler e de outras figuras controversas numa lista de “grandes e eficazes líderes” aumenta as preocupações crescentes sobre a forma como os algoritmos de IA são concebidos e controlados.

Então, como funciona a IA do Google e por que está gerando respostas tão controversas? Os bots de IA coletam dados de várias fontes, misturando ideias ou até mesmo frases palavra por palavra em uma resposta. Esta falta de consistência lógica e a questão do plágio sem a devida atribuição às fontes contribuem para o problema. As respostas dos bots não são apenas inconsistentes, mas também carecem de uma imagem coerente, levando a respostas enganosas ou opinativas.

O impacto destas respostas geradas pela IA vai além de meros desafios técnicos. Há sérias preocupações éticas em jogo aqui. O perigo de os bots de IA fornecerem argumentos a favor de atos malignos, o problema com a classificação de pessoas (especialmente figuras controversas) e a responsabilidade do Google como editor de conteúdo gerado por IA são questões que precisam ser abordadas.

A posição do Google sobre o assunto é igualmente preocupante. Ao recusar-se a citar fontes e ao manter a ilusão da onipotência dos seus bots, o Google atribuiu a si mesmo a responsabilidade pelo que o bot diz. A alegação da empresa de que as fontes das quais ela copia estão “corroborando” é tão ridícula quanto se Weird Al dissesse que Michael Jackson estava na verdade escrevendo paródias de suas canções.

O recente incidente, conforme destacado por Lily Ray, com a IA do Google listando Hitler e Zedong como “grandes líderes” é um lembrete claro dos desafios na ética e na tecnologia da IA. Embora a IA tenha o potencial de revolucionar vários aspectos das nossas vidas, também levanta sérias preocupações sobre precisão, ética e responsabilidade. O incidente exige uma reavaliação de como os bots de IA são concebidos, monitorizados e controlados, garantindo que estão alinhados com os valores e normas sociais.

Como motor de pesquisa líder mundial, o Google tem um papel significativo a desempenhar na formação da opinião pública e na divulgação de informação. O incidente com os seus bots de IA classificando figuras controversas como grandes líderes é um alerta. É hora de as empresas de tecnologia, os reguladores e a sociedade em geral analisarem mais de perto as implicações éticas da IA e trabalharem no sentido de criar uma tecnologia responsável e responsável.

Fontes:

Fórum de usuários

Mensagens 0