O Bing poderá em breve ter a capacidade de usar imagens, vídeos e outros tipos de dados em respostas

3 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

A novo Bing com tecnologia ChatGPT está melhorando continuamente e a Microsoft pode iniciar seu maior desenvolvimento na próxima semana. Andreas Braun, CTO da Microsoft Alemanha, anunciou recentemente que o GPT-4 chegará na próxima semana. A par disso, o executivo insinuou “modelos multimodais que vão oferecer possibilidades completamente diferentes”.

A Microsoft já investiu bilhões de dólares em suas iniciativas de IA, especialmente na melhoria incansável do Bing para competir melhor com o Google. Agora, a gigante do software confirmou a chegada do GPT-4 na próxima semana, que deverá ser injetado em seu mecanismo de busca e chatbot.

Antes do lançamento do ChatGPT Bing, havia rumores sobre o Bing usando GPT-4. No entanto, a Microsoft usou o modelo GPT-3.5 juntamente com sua tecnologia proprietária Prometeu, que permite ao Bing gerar dados atualizados. Surpreendentemente, embora o novo Bing ainda não esteja disponível para todos, a empresa já tem planos de dar um impulso significativo ao mecanismo de busca por meio do próximo GPT-4.

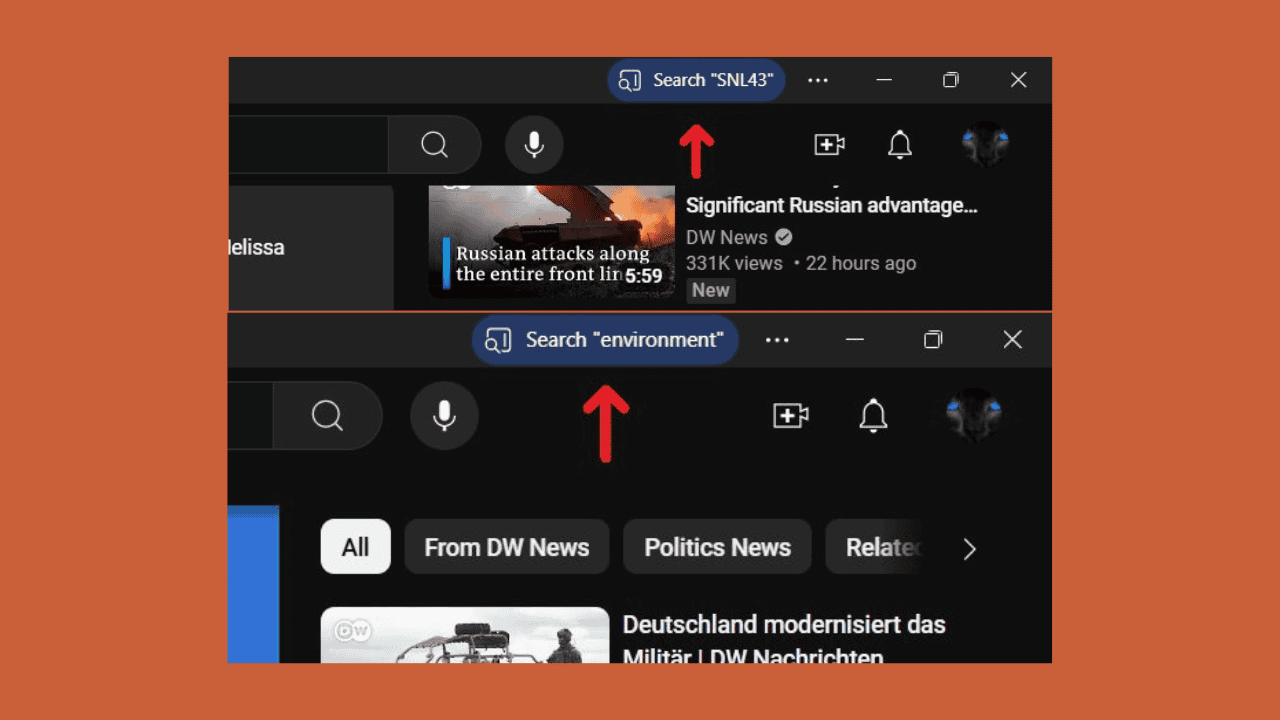

Espera-se que o novo e futuro Large Language Model do OpenAI permita que o chatbot do Bing gere resultados mais rápidos, o que pode ser uma grande ajuda, já que a versão atual geralmente leva alguns segundos para começar a gerar respostas. No entanto, além da velocidade, uma capacidade multimodal pode ser a maior coisa que a introdução do novo LLM pode trazer.

No evento AI in Focus – Digital Kickoff da Microsoft, Braun compartilhou alguns detalhes sobre o que esperar da entrada de um novo LLM. (através da Heise)

“Apresentaremos o GPT-4 na próxima semana, lá teremos modelos multimodais que oferecerão possibilidades completamente diferentes – por exemplo, vídeos”, disse Braun, que descreveu o LLM como um “divisor de águas”.

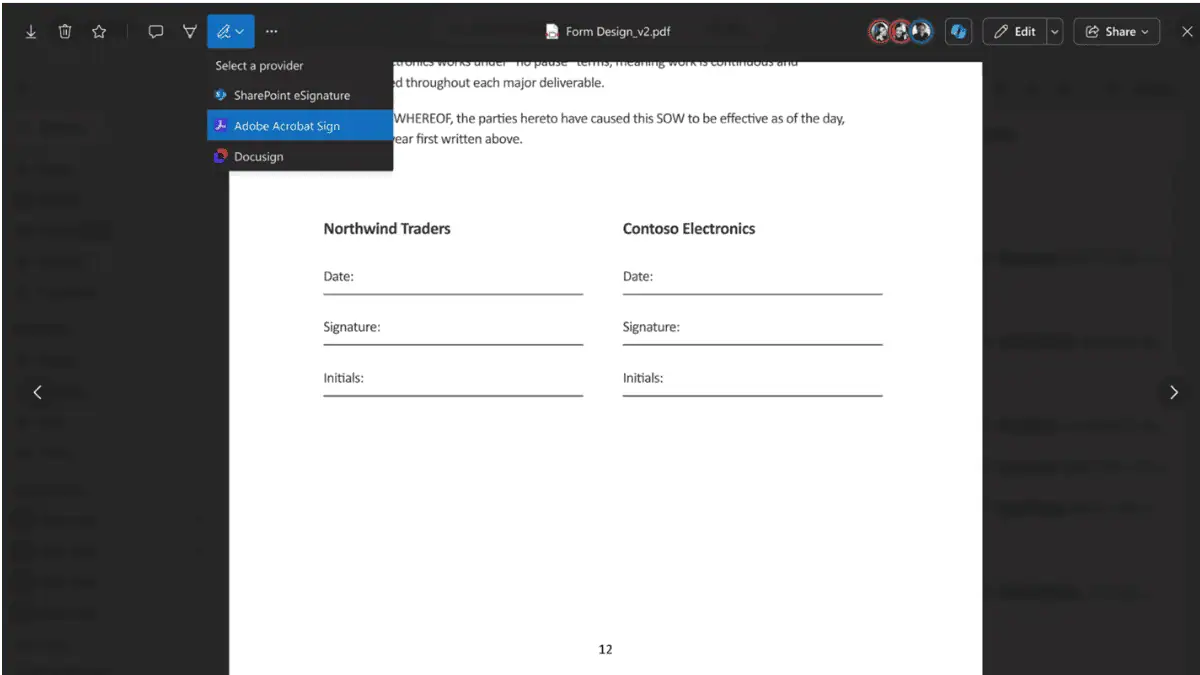

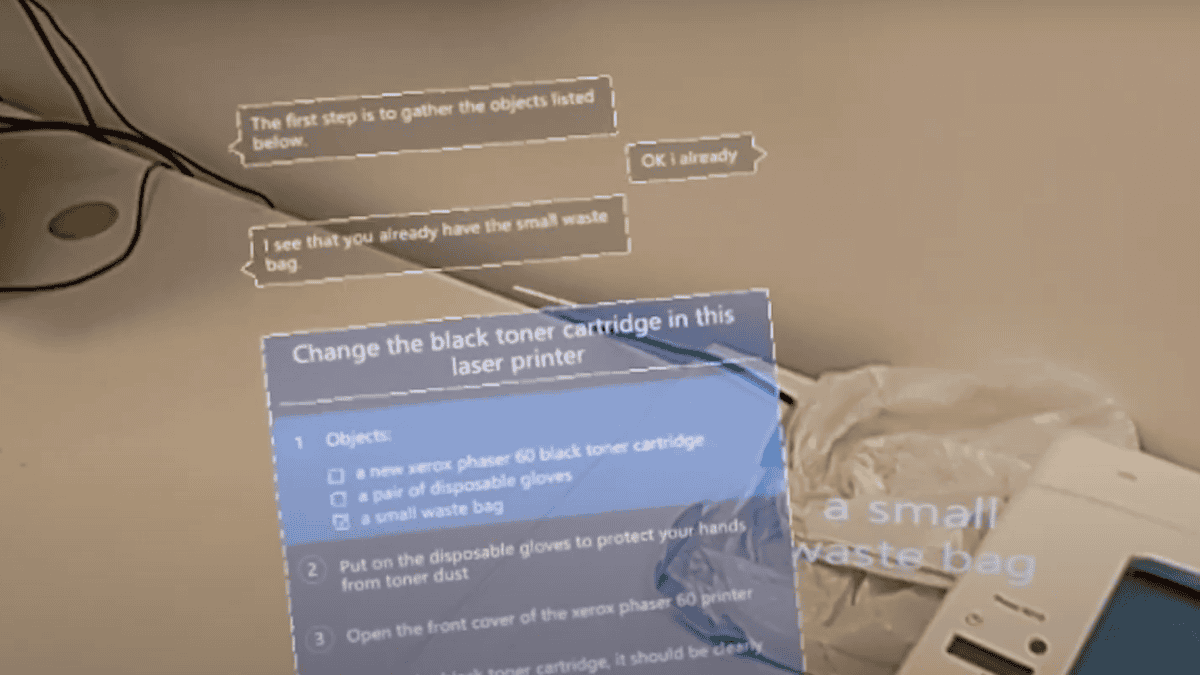

Além disso, Braun confirmou que a Microsoft tem planos de “tornar os modelos abrangentes” usando a capacidade de multimodalidade. Uma vez injetado, isso deve permitir que o Bing forneça uma variedade de dados ao responder às perguntas, o que significa que também pode processar vídeos, imagens e outros tipos de dados. Isso deve resultar em melhores respostas, tornando o Bing um assistente de pesquisa mais eficaz para todos.

Por outro lado, é importante notar que o Bing não é o primeiro na multimodalidade. Recentemente, Com você lançou seu recurso de pesquisa de bate-papo multimodal, permitindo que os usuários forneçam entradas de texto e voz e recebam respostas além dos textos de conversação. O buscador, no entanto, ainda luta para chamar a atenção do público. Enquanto isso, apesar de ainda não estar totalmente acessível a todos, o Bing já tem uma lista de espera em constante expansão. A injeção de uma capacidade multimodal nele certamente afetará seus rivais, como You.com. No entanto, ainda é cedo para dizer o quão vasto será esse efeito, já que o anúncio de Braun confirma apenas alguns detalhes.