Os carros sem motorista são realmente precisos? Pesquisadores da Duke University dizem que podem ser enganados

3 minutos. ler

Publicado em

Leia nossa página de divulgação para descobrir como você pode ajudar o MSPoweruser a sustentar a equipe editorial Saiba mais

Carros sem motorista promete conforto e segurança para motoristas e passageiros, mas pode mudar com a revelação de pesquisadores da Duke University. Segundo a equipe, existe uma estratégia de ataque que os criminosos podem fazer para enganar os sensores do veículo autônomo (combinação de dados 2D de câmeras e dados 3D do LiDAR) para perceber objetos próximos mais próximos ou mais distantes do que parecem. Isso pode significar problemas e danos significativos, especialmente quando usado em situações militares onde um único veículo se traduz em um alvo valioso. Ainda mais, os pesquisadores destacaram que é possível que os hackers encontrem uma maneira de atacar diferentes veículos de uma só vez.

“Nosso objetivo é entender as limitações dos sistemas existentes para que possamos nos proteger contra ataques”, disse Miroslav Pajic, professor associado de engenharia elétrica e de computação da família Dickinson na Duke. “Esta pesquisa mostra como adicionar apenas alguns pontos de dados na nuvem de pontos 3D, à frente ou atrás de onde um objeto realmente está, pode confundir esses sistemas e tomar decisões perigosas”.

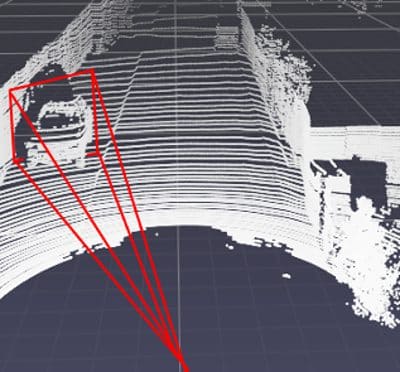

Segundo os pesquisadores, a falha do sistema começará quando uma arma a laser for usada para disparar um sensor LIDAR. Isso distorcerá a percepção do automóvel causada pela adição de pontos de dados falsos. De acordo com Pajic, o sistema pode detectar isso ataque se os pontos de dados forem muito diferentes do que a câmera do carro vê. No entanto, de acordo com a pesquisa da Duke, o sistema pode ser enganado quando os pontos de dados 3D LIDAR são colocados com precisão dentro de uma determinada área do campo de visão 2D de uma câmera.

Isso cria uma área vulnerável a ataques. Tem a forma de um tronco esticado na frente de uma lente de câmera ou na forma de uma pirâmide 3D com uma ponta cortada.

“Esse chamado ataque frustum pode enganar o controle de cruzeiro adaptativo para pensar que um veículo está desacelerando ou acelerando”, disse Pajic. “E quando o sistema descobrir que há um problema, não haverá como evitar bater no carro sem manobras agressivas que possam criar ainda mais problemas.”

Pajic e sua equipe, felizmente, têm uma solução viável para o risco por meio de redundância adicional, como câmeras estéreo com campos de visão sobrepostos. Esses técnicos, segundo eles, trabalharão juntos para calcular adequadamente as distâncias e determinar o erro entre os dados do LIDAR e a percepção da câmera.

“As câmeras estéreo são mais propensas a serem uma verificação de consistência confiável, embora nenhum software tenha sido suficientemente validado para determinar se os dados da câmera LIDAR/estéreo são consistentes ou o que fazer se for descoberto que são inconsistentes”, disse Spencer Hallyburton, principal autor do estudo e um Ph.D. candidato no Laboratório de Sistemas Ciber-Físicos de Pajic. “Além disso, proteger perfeitamente todo o veículo exigiria vários conjuntos de câmeras estéreo ao redor de todo o corpo para fornecer 100% de cobertura.”

A Pajic também introduziu a criação de um sistema que permitirá que carros próximos uns dos outros compartilhem dados. A pesquisa e as sugestões da equipe serão apresentadas de 10 a 12 de agosto no Simpósio de Segurança USENIX 2022.