Microsoft i NVIDIA ogłaszają największy i najpotężniejszy model językowy wyszkolony do tej pory

1 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

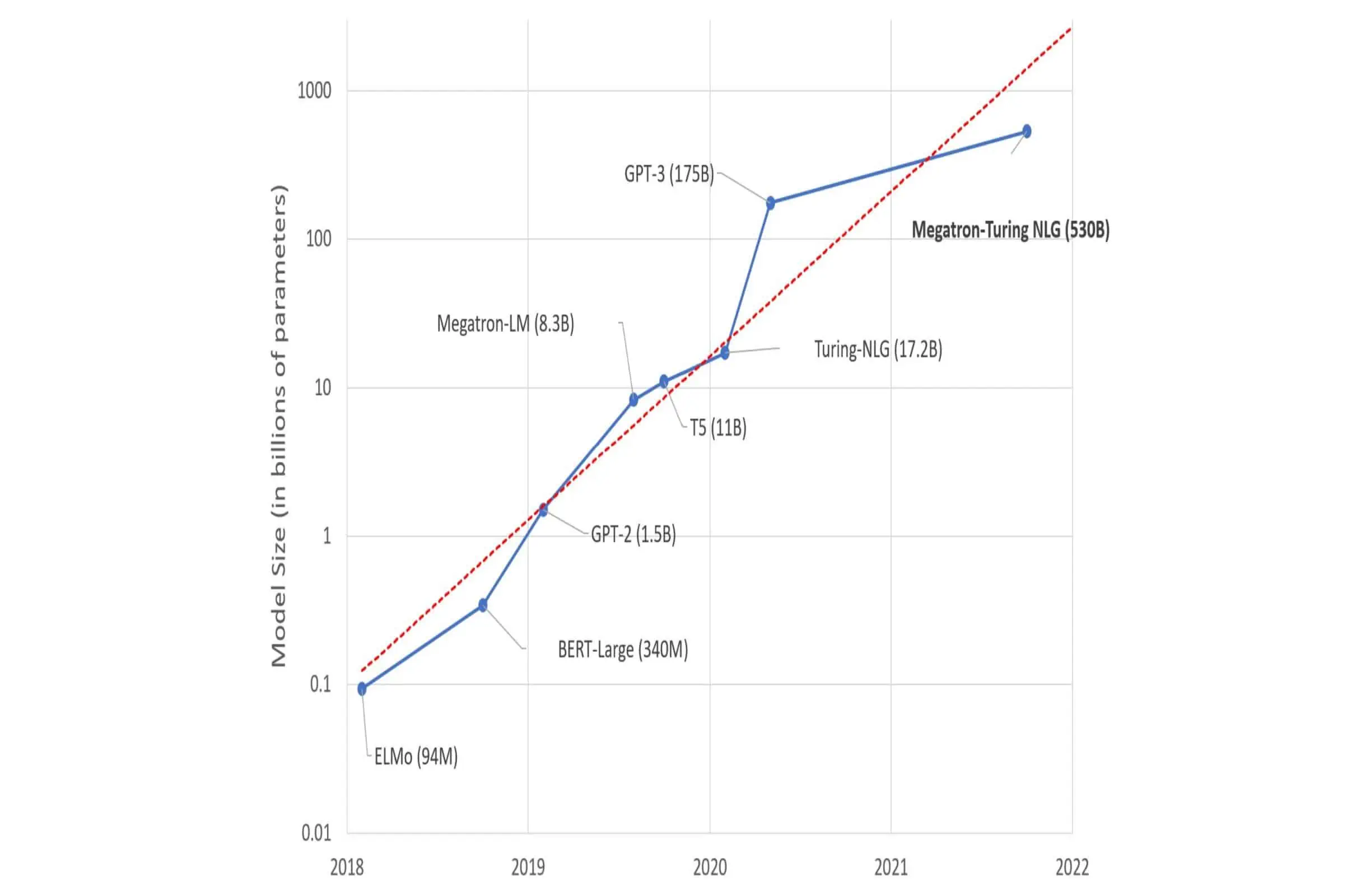

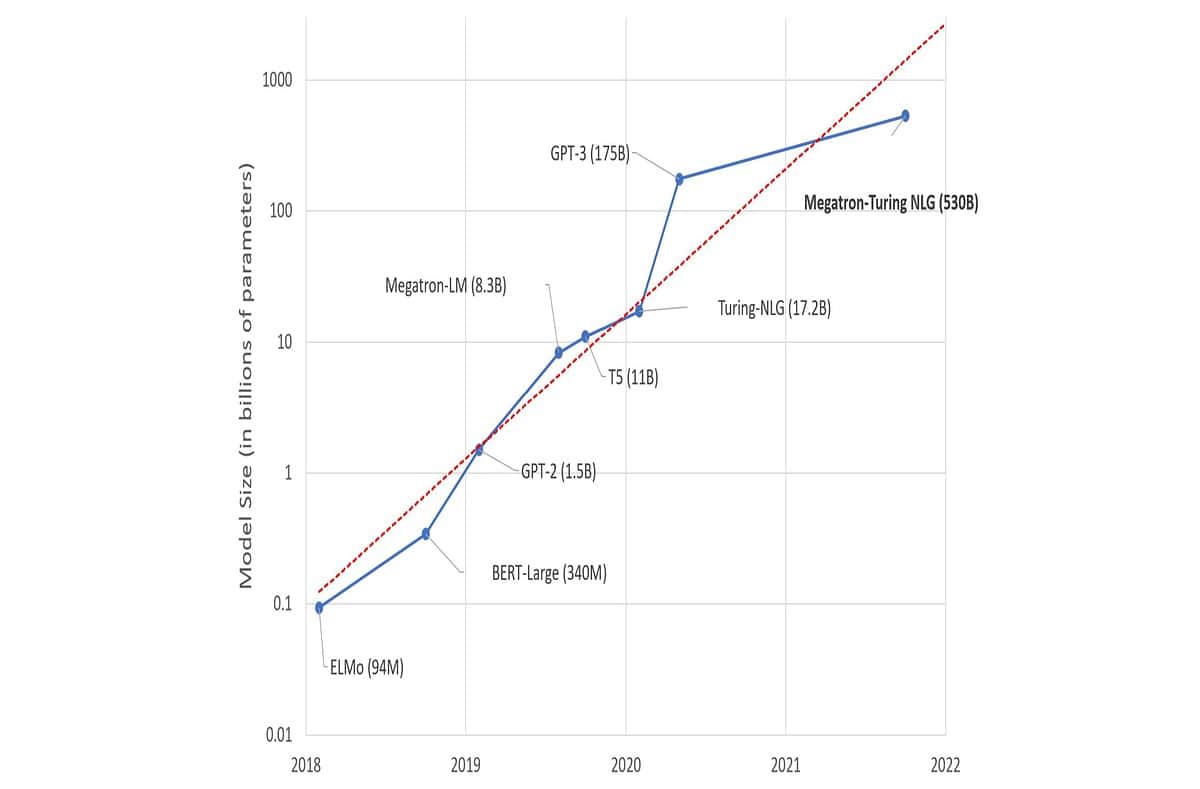

Microsoft i NVIDIA ogłosiły dzisiaj model Megatron-Turing Natural Language Generation (MT-NLG) oparty na technologii DeepSpeed i Megatron, największy i najpotężniejszy model monolitycznego języka transformatora, jaki został do tej pory przeszkolony. Model ten zawiera 530 miliardów parametrów, czyli 3 razy więcej parametrów w porównaniu z istniejącym największym modelem GPT-3. Szkolenie tak dużego modelu wiąże się z różnymi wyzwaniami. NVIDIA i Microsoft pracowały nad wieloma innowacjami i przełomami we wszystkich osiach AI.

Na przykład, ściśle współpracując, firmy NVIDIA i Microsoft osiągnęły bezprecedensową wydajność szkolenia, łącząc najnowocześniejszą infrastrukturę szkoleniową akcelerowaną przez GPU z najnowocześniejszym stosem oprogramowania do rozproszonego uczenia się. Zbudowaliśmy wysokiej jakości korpusy szkoleniowe języka naturalnego z setkami miliardów tokenów i wspólnie opracowaliśmy przepisy szkoleniowe, aby poprawić wydajność i stabilność optymalizacji.

Możesz dowiedzieć się więcej o tym projekcie z poniższych linków.

Forum użytkowników

Wiadomości 0