Być może będziesz musiał trochę poczekać, aby uzyskać opcję przesyłania obrazu dla funkcji multimodalnej Bing

2 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

OpenAI oficjalnie wydało GPT-4, a Microsoft ujawnił, że model został „dostosowany do wyszukiwania”. Częścią tego ekscytującego odkrycia jest multimodalność modelu, pozwalająca na przetwarzanie obrazów. Jednak ta funkcja jest nadal ograniczona, nawet w Bing. Co więcej, przesyłanie zdjęć w celu wykorzystania tej funkcji może być nadal daleko, jak zasugerował jeden z pracowników Microsoftu.

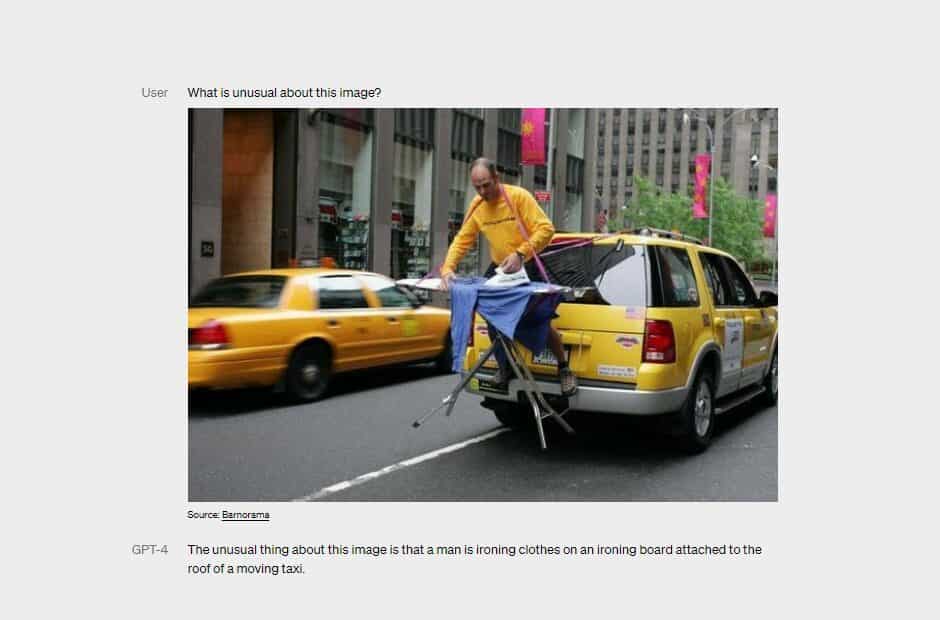

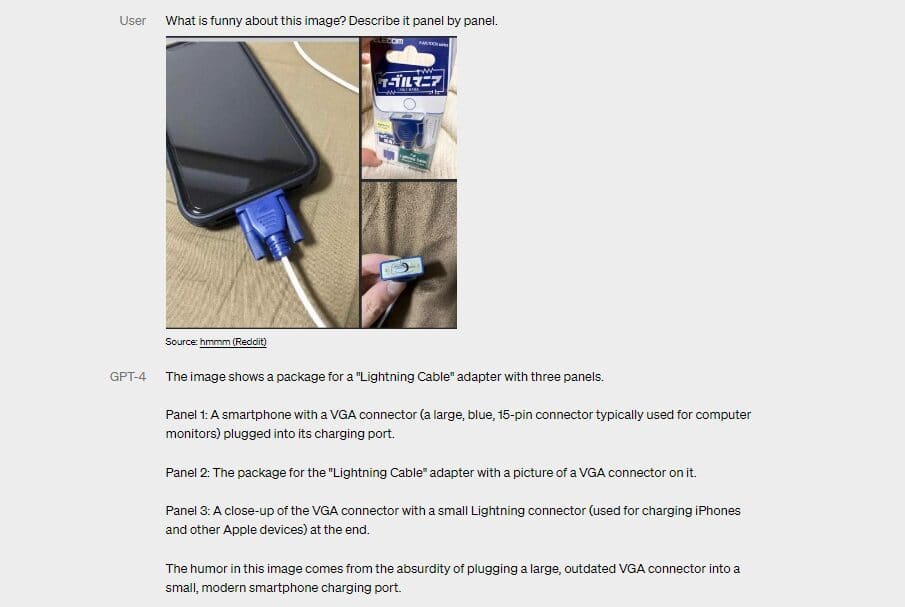

Multimodalność to największa zaleta najnowszego modelu OpenAI. I chociaż GPT-4 jest już dostępny dla subskrybentów ChatGPT Plus, funkcja jest nadal w fazie testów, przez co jest niedostępna dla wszystkich. Niemniej jednak OpenAI pokazało w swoim ostatnim poście na blogu, jak multimodalność będzie działać w GPT-4, który może w zasadzie opisywać i interpretować przesłane obrazy.

Wow, Bing może teraz faktycznie opisywać obrazy, teraz, gdy wie, że używa GPT-4!

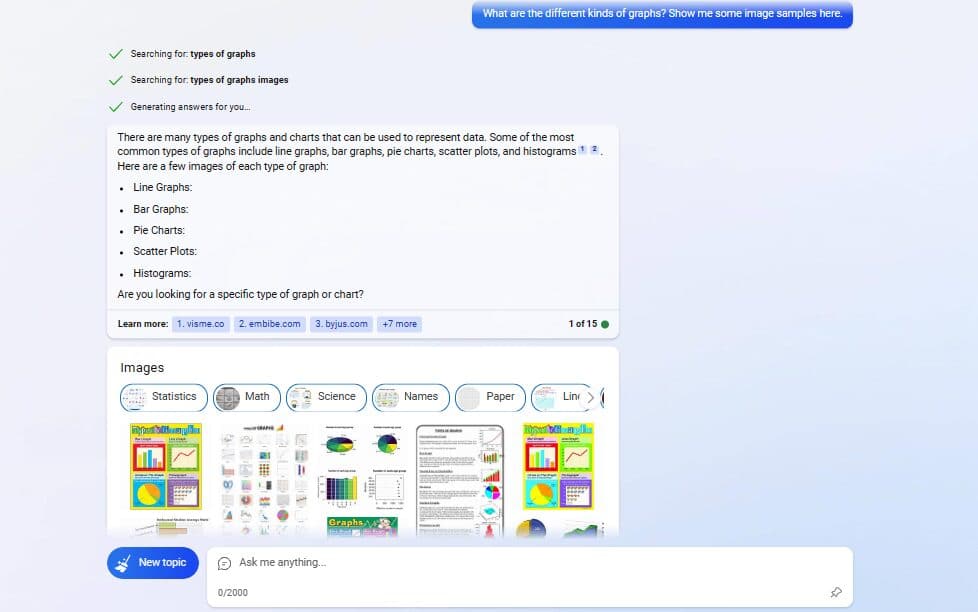

byu/BroskiPlaysYT inbing

Ta multimodalność wydaje się być teraz dostępna w sieci nowy Bing, choć nie w pełni. Aby rozpocząć, użytkownicy mogą poprosić Bing Chat o opisanie obrazów za pomocą linków do obrazów pobranych z sieci, a to wygeneruje odpowiedź. Ponadto chatbot będzie teraz uwzględniał obrazy w swoim procesie, zwłaszcza jeśli go o to poprosisz.

Z drugiej strony nadal niedostępna jest opcja bezpośredniego przesłania zdjęcia do opisania lub przeanalizowania przez Bing. Pojawienie się tej opcji zostało niedawno zgłoszone przez użytkownika Twitter do Michaiła Parakhina, szefa działu reklamy i usług sieciowych Microsoftu, który zasugerował, że na razie nie jest to priorytetem firmy.

Jest znacznie droższy, musimy najpierw rozszerzyć obecną funkcjonalność. Wszystko po to, aby wprowadzić więcej procesorów graficznych.

— Michaił Parakhin (@MParakhin) 14 marca 2023 r.

Aby było to możliwe, Parakhin zauważył potrzebę „więcej procesorów graficznych” i powiedział, że zrobienie tego było „znacznie droższe”. w niedawnym raport, Microsoft ujawnił, że wydał już setki milionów dolarów na zbudowanie superkomputera ChatGPT poprzez połączenie tysięcy procesorów graficznych Nvidia na platformie przetwarzania w chmurze Azure. W związku z tym, jeśli słowa Parakhina zostaną potraktowane poważnie, Microsoft może chcieć wydać więcej, aby całkowicie wprowadzić funkcję multimodalną do Bing. I na podstawie tego, co powiedział Parakhin, jest to możliwe, ale nie dzisiaj.