Haal Copilot Designer van internet: een Microsoft-ingenieur kan, nadat hij deze heeft onthuld, uiterst ongepaste inhoud produceren

2 minuut. lezen

Uitgegeven op

Lees onze openbaarmakingspagina om erachter te komen hoe u MSPoweruser kunt helpen het redactieteam te ondersteunen Lees meer

Belangrijkste opmerkingen

- Microsoft-ingenieur markeert AI-beeldgenerator Copilot Designer voor het produceren van schadelijke inhoud, zoals gewelddadige beelden en inbreuk op het auteursrecht.

- De ingenieur dringt er bij Microsoft op aan om de tool te verwijderen, waarschuwingen toe te voegen en de leeftijdsclassificatie te wijzigen vanwege veiligheidsoverwegingen.

- Het incident belicht bredere kwesties van potentieel misbruik en ethische overwegingen rond generatieve AI-technologie.

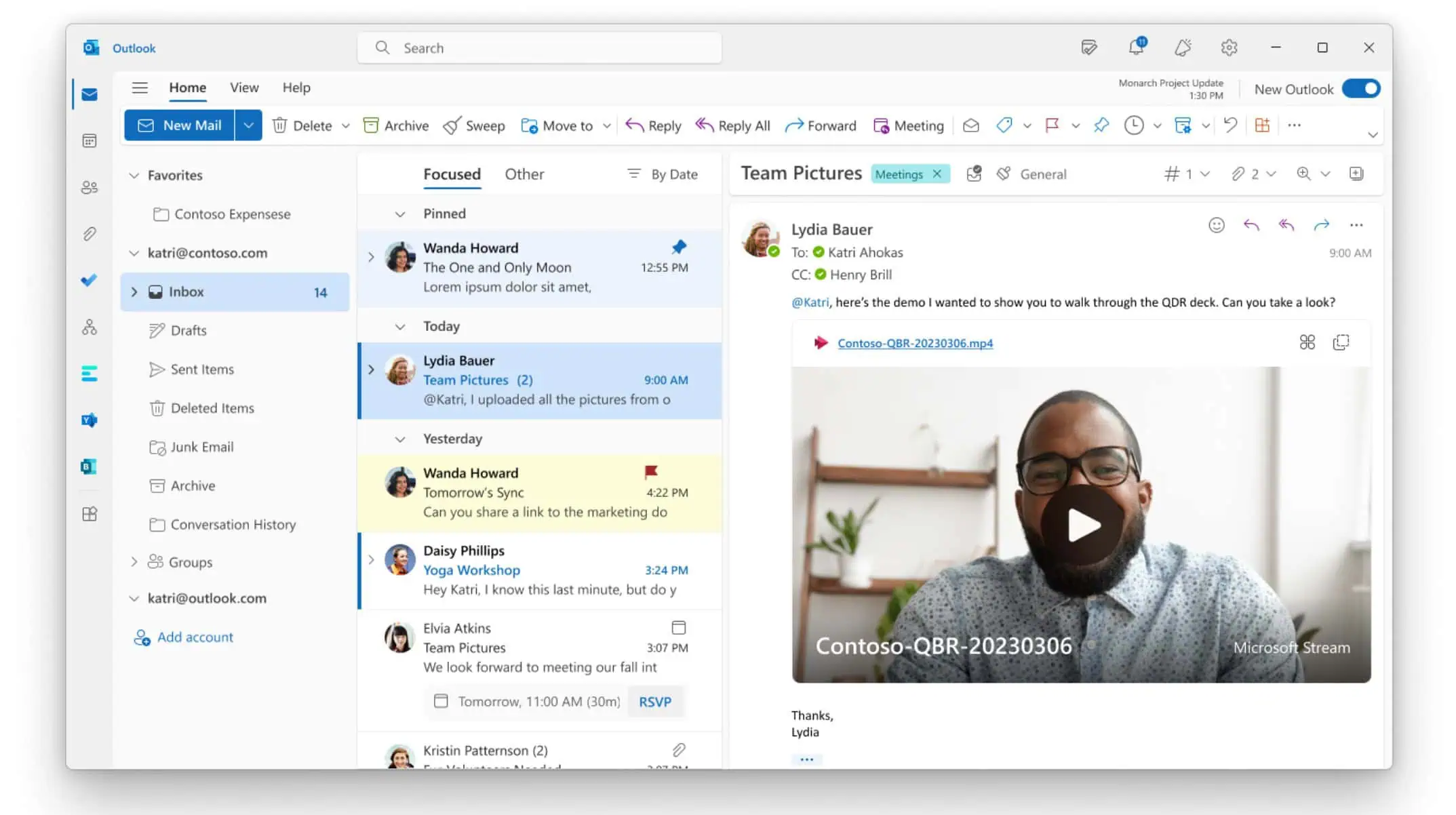

Een Microsoft-ingenieur heeft zijn zorgen geuit over de AI-beeldgenerator van het bedrijf, Copilot Designer. Hij beweert dat het schadelijke en ongepaste inhoud kan opleveren.

Shane Jones, hoofdsoftware-engineeringmanager bij Microsoft, zei dat hij ontdekte dat de tool gewelddadige, seksuele en bevooroordeelde beelden kan genereren. Het doet mij denken aan de Taylor Swift-saga, wat naar verluidt door een Microsoft-product werd gedaan.

Hij rapporteerde zijn bevindingen intern, maar was niet tevreden met de reactie, waardoor hij zijn problemen openbaar maakte.

Jones, die kwetsbaarheden identificeerde door middel van ‘red-teaming’ (testen op zwakke punten), meldde dat hij verontrustende beelden tegenkwam, waaronder:

- Afbeeldingen met demonen en monsters, naast termen die verband houden met abortusrechten.

- Beelden van vrouwen in geseksualiseerde scenario's te midden van auto-ongelukken.

- Afbeeldingen van tieners op feestjes met drugs en wapens.

- Afbeeldingen met Disney-personages in mogelijk auteursrechtelijk beschermde en aanstootgevende situaties, waaronder scènes met geweld in het Midden-Oosten en personages die verband houden met militaire beelden.

Jones roept Microsoft op om onmiddellijk actie te ondernemen, waaronder een belangrijke stap om Copilot Designer van de markt te halen totdat de veiligheidsmaatregelen zijn geïmplementeerd. Hij voegde informatie toe over de beperkingen van de tool en veranderde de app-beoordeling om aan te geven dat deze niet geschikt is voor alle leeftijden. Of wie dan ook.

Microsoft heeft nog niet op alle specifieke claims van Jones gereageerd. Een woordvoerder zei echter dat het bedrijf zich inzet voor het aanpakken van eventuele zorgen van werknemers en waardeert hun inspanningen bij het testen van de technologie.

Als het gaat om veiligheidsomzeilingen of zorgen die een potentiële impact kunnen hebben op onze diensten of onze partners, hebben we robuuste interne rapportagekanalen opgezet om eventuele problemen op de juiste manier te onderzoeken en op te lossen. We moedigen werknemers aan hiervan gebruik te maken, zodat we hun vaardigheden op de juiste manier kunnen valideren en testen. zorgen.

De zorgen over generatieve AI en de kans op misbruik nemen zelfs toe De beeldmaker van Gemini heeft onlangs wakkere foto's gemaakt, waardoor Google een tijdje stopte met het maken van menselijke afbeeldingen.

Dit is een verhaal in ontwikkeling en we zullen updates blijven verstrekken zodra deze beschikbaar komen.

Meer hier.