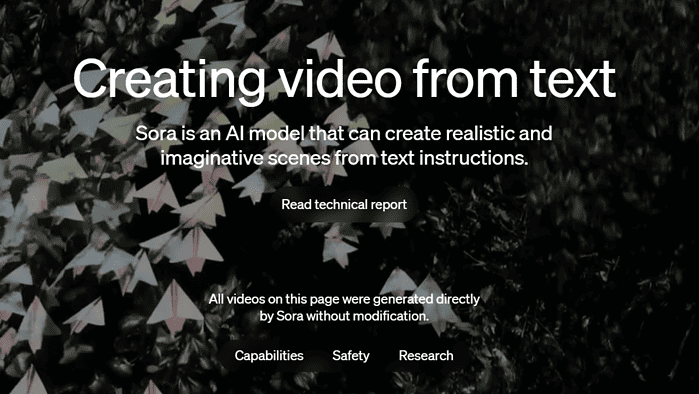

Maak kennis met Sora, het nieuwe tekst-naar-video-model van OpenAI dat verbluffende HD-video's maakt op basis van tekstprompts

Het is niet de vraag ‘kunnen we het doen’, maar ‘moeten we het doen’.

2 minuut. lezen

Uitgegeven op

Lees onze openbaarmakingspagina om erachter te komen hoe u MSPoweruser kunt helpen het redactieteam te ondersteunen Lees meer

Belangrijkste opmerkingen

- OpenAI heeft zojuist een nieuw tekst-naar-video AI-model aangekondigd, Sora, en het ziet er tegelijkertijd indrukwekkend en eng uit.

- Mensen maken zich nu zorgen of dit model hun banen zal overnemen.

- Het model zal C2PA-metadata bevatten zodra het in de toekomst in een OpenAI-product wordt geïmplementeerd.

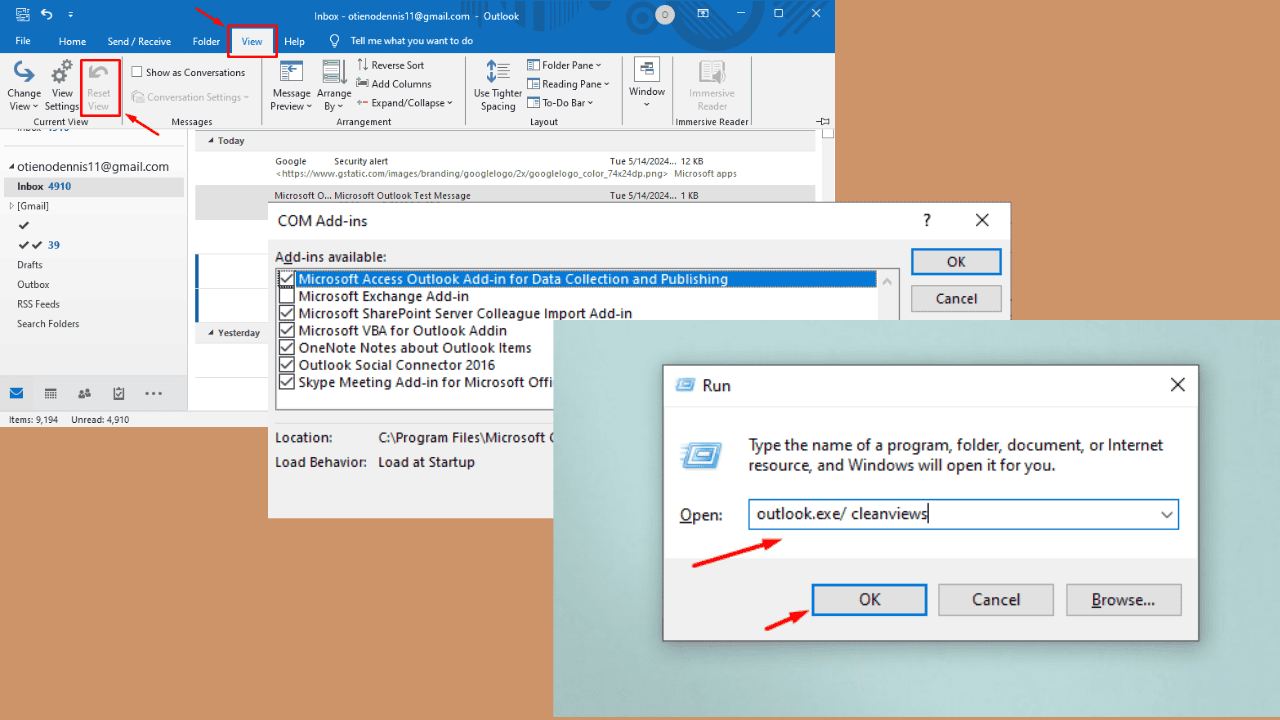

OpenAI heeft zojuist een nieuw tekst-naar-video AI-model aangekondigd, Sora, en het ziet er indrukwekkend uit. Het uitgangspunt ervan ziet er vrij eenvoudig en toch opmerkelijk uit: je kunt elk woordprompt typen, hoe gedetailleerd je maar wilt, en dan komt het AI-model terug met een zeer gedetailleerde video van 60 seconden.

Bekijk enkele van de resultaten die Sora zou kunnen bereiken:

Dat is eerlijk gezegd eng en indrukwekkend tegelijk. De publieke reactie daarop is een mix van ontzag en ongerustheid, vooral als er rekening mee wordt gehouden OpenAI is verleden legaal geschillen met journalistieke bedrijven omdat ze hun artikelen zouden hebben gebruikt om het model te trainen zonder hun toestemming.

En we moeten ook praten over potentiële banen die vervangen kunnen worden. Zelfs OpenAI-baas Sam Altman zelf, die ooit uit de functie werd gezet, zei dat het tempo van ons AI-onderzoek is geweest gaat veel te snel vooruit en de hoeveelheid aanpassingen die de mensheid moet maken is alarmerend.

Dit model bouwt voort op eerder DALL-E- en GPT-onderzoek, waarbij gebruik wordt gemaakt van de unieke hercaptioneringsmethode van DALL-E 3 om uiterst beschrijvende bijschriften voor de visuele trainingsgegevens te genereren. Echter, het staat nog steeds voor uitdagingen in het realistisch simuleren van complexe scènes, het begrijpen van oorzaak-gevolgrelaties en het niet verwarren van ruimtelijke details van een prompt.

Wanneer het in de toekomst wordt geïmplementeerd in een OpenAI-product, of het nu ChatGPT, een nieuw aanbod of Copilot is, zal het model C2PA-metagegevens bevatten, vergelijkbaar met wat Microsoft heeft gedaan op Afbeeldingsmaker van Designer. Tekst- en beeldcontroles beschermen OpenAI-producten tegen schadelijke inhoud zoals geweld, haatzaaiende uitlatingen en inbreuk op intellectuele eigendomsrechten.

“We verlenen ook toegang aan een aantal beeldend kunstenaars, ontwerpers en filmmakers om feedback te krijgen over hoe we het model kunnen verbeteren, zodat het zo nuttig mogelijk is voor creatieve professionals”, zegt OpenAI.