Microsoft onthult 'PyRIT'-toolkit om generatieve AI-systemen te helpen beschermen

2 minuut. lezen

Uitgegeven op

Lees onze openbaarmakingspagina om erachter te komen hoe u MSPoweruser kunt helpen het redactieteam te ondersteunen Lees meer

Belangrijkste opmerkingen

-

Softwaregigant introduceert een open source-framework waarmee beveiligingsprofessionals proactief kwetsbaarheden in AI-modellen kunnen opsporen.

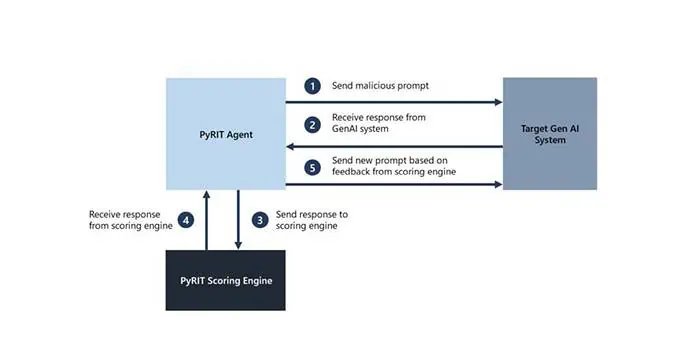

Microsoft vandaag aangekondigd de release van PyRIT (Python Risk Identification Toolkit), een open-source automatiseringsframework dat beveiligingsteams in staat stelt risico’s binnen generatieve AI-systemen te identificeren. Deze stap onderstreept de diepe toewijding van Microsoft aan verantwoorde AI-ontwikkeling en het bouwen van veilige tools voor het snel groeiende generatieve AI-landschap.

AI Red Teaming-automatisering: een noodzaak

Red teaming, het proces van het simuleren van aanvallen om de verdediging te testen, is cruciaal voor generatieve AI. Deze systemen zijn echter complex en kennen meerdere faalpunten, in tegenstelling tot traditionele software. De uitgebreide ervaring van Microsoft op het gebied van AI red teaming heeft geleid tot de oprichting van PyRIT, waarmee de unieke uitdagingen van generatieve AI worden aangepakt.

“Hoewel automatisering de menselijke red teamers niet volledig kan vervangen, is het essentieel voor het opschalen van de inspanningen en het benadrukken van gebieden die diepgaander onderzoek vereisen”, aldus Microsoft.

Pyrit: belangrijkste kenmerken en voordelen

- Aanpassingsvermogen: Werkt met verschillende generatieve AI-modellen en kan worden uitgebreid om nieuwe invoertypen te ondersteunen (bijvoorbeeld afbeeldingen, video).

- Risicogerichte datasets: Maakt testen mogelijk op zowel beveiligingsproblemen als mogelijke vooroordelen of onnauwkeurigheden.

- Flexibele score-engine: Maakt het scoren van AI-outputs mogelijk met behulp van machine learning of directe LLM's voor zelftesten.

- Aanvalsstrategieën met meerdere beurten: Simuleert meer realistische, aanhoudende aanvallen voor diepgaande tests.

- Geheugencapaciteit: Vergemakkelijkt analyse en maakt langere, complexere interacties mogelijk.

Sectorbrede impact

De release van PyRIT zal voor veel ophef zorgen in de AI-beveiligingsindustrie. Microsoft moedigt organisaties in alle sectoren aan om PyRIT te gebruiken bij hun generatieve AI-beveiligingsinspanningen. Het bedrijf nodigt ook uit tot samenwerking en benadrukt dat een gezamenlijke inspanning cruciaal is voor het opbouwen van een robuuste verdediging tegen opkomende AI-risico’s.

Het is belangrijk op te merken dat PyRIT geen vervanging is voor het handmatig red teaming van generatieve AI-systemen. In plaats daarvan vergroot het de bestaande domeinexpertise van een AI-red-teamer en automatiseert het de vervelende taken voor hen.

U kunt aan de slag met het PyRIT-project hier.