Wayve의 새로운 자율 AI LINGO-2는 승객과 상호 작용하고 주문을 받을 수 있습니다.

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

주요 사항

- Wayve의 LINGO-2는 실시간으로 탐색하고 동작을 설명하는 최초의 자율 주행 자동차 모델입니다.

- 이 VLAM(비전-언어-행동 모델)은 카메라와 언어 처리를 사용하여 주변 환경을 이해합니다.

- 승객은 질문을 하거나 간단한 지침을 제공하여 LINGO-2와 상호 작용할 수 있습니다.

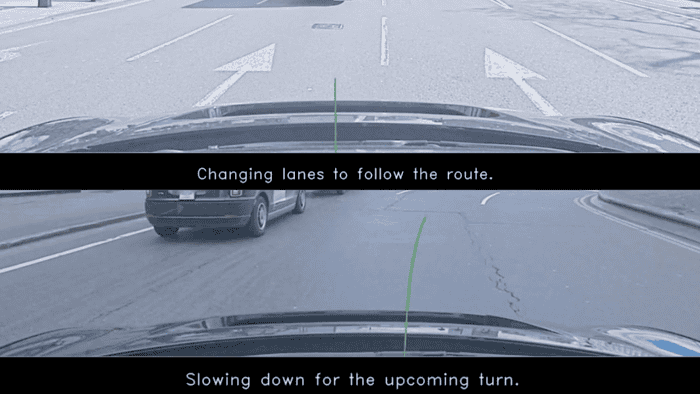

Wayve는 공공 도로에서 사용하도록 설계된 새로운 VLAM(비전-언어-행동 모델)인 LINGO-2를 공개했습니다. LINGO-2는 시각적 인식, 언어 처리 및 실시간 의사 결정 기능을 통합하여 주변 환경을 탐색합니다. LINGO-2는 자율주행차의 두뇌 역할을 합니다. 카메라를 사용하여 주변 환경(시각)을 인식한 다음 언어 처리를 사용하여 장면을 이해합니다.

이전 버전과 달리 LINGO-2는 차량의 움직임을 제어하면서 동작에 대한 실시간 설명을 제공하는 데 필요한 기능을 갖추고 있습니다.

“LINGO-2는 버스 주위를 탐색합니다. 우리는 LINGO-2가 지침을 따라 "버스 뒤에 멈추거나" "가속하여 버스를 추월"할 수 있음을 관찰할 수 있습니다.

이 기능을 통해 모델은 의사결정 과정을 설명할 수 있어 자율주행차에 대한 신뢰도가 높아집니다. 예를 들어, LINGO-2는 보행자의 속도를 늦추는 등의 행동에 대한 이유를 밝히고 행동에 대한 더 깊은 이해를 촉진할 수 있습니다.

“우리는 LINGO-2에게 “날씨는 어떤가요?”를 설명하도록 요청합니다. 날씨가 '매우 흐리고 해의 흔적이 없습니다'부터 '맑음', '날씨는 맑고 푸른 하늘과 구름이 흩어져 있습니다'까지의 범위를 정확하게 식별할 수 있습니다.

또한 LINGO-2는 승객과 차량 간의 상호 작용을 위한 길을 열어줍니다. 사용자는 회전을 요청하는 등 자연어를 사용해 간단한 지시를 내릴 수 있고, 승객은 신호등 상태나 잠재적 위험 등 차량 주변에 대해 문의할 수 있습니다.

“모델에게 “신호등 색깔이 뭐예요?”라고 물으면 "신호등이 녹색입니다."라고 올바르게 응답합니다.

이러한 기능에도 불구하고 Wayve는 특정 제한 사항을 인정합니다. 설명의 정확성과 다양한 실제 시나리오에서 음성 지침을 안전하게 실행하는 모델의 능력에는 추가 개선이 필요합니다.

LINGO-2의 데뷔는 자율주행차 기술에 있어서 큰 진전이 될 수 있습니다. 자율주행차가 자신의 행동에 대해 명확한 설명을 제공할 수 있는 미래를 제시합니다. 자율주행은 남은 과제에도 불구하고 투명성과 승객과의 상호작용 가능성을 제공합니다.

더 보기 여기에서 지금 확인해 보세요..