Mixtral 8x22B 오픈 소스 모델이 마침내 도착했으며 Torrent를 통해 다운로드할 수 있습니다.

지금까지 AI 업계에서 며칠간 바쁜 시간을 보냈습니다.

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

주요 사항

- Mistral은 AI 경쟁이 치열해지면서 개척 모델인 Mixtral 8x22B를 출시했습니다.

- 오픈 소스 모델에는 176B 매개변수와 65K 토큰의 컨텍스트 길이가 있습니다.

- 토렌트를 통해 다운로드 가능합니다.

Mistral이 큰 발표를 가지고 돌아왔습니다. 수요일 오전, 마이크로소프트가 지원하는 프랑스 회사는 AI 경쟁이 가열되면서 개척 모델인 Mixtral 8x22B를 출시했습니다.

그것의 가장 좋은 부분은 무엇입니까? 오픈소스 시스템이며, AI 스타트업으로 파일 크기 281GB로 토렌트를 통해 다운로드할 수 있다. 자석 링크를 게시했습니다. X(이전에는 Twitter로 알려짐)에서. 현재 다음에서도 사용 가능합니다. 포옹 얼굴 and 퍼플렉시티 AI 연구소.

Mistral은 대부분 Google과 Meta의 전 직원으로 구성되어 있습니다. 회사의 이전 모델인 Mixtral 8x7B는 시작 작년 2월에는 MMLU, ARC Challenge, MBPP 등과 같은 특정 벤치마크에서 Llama-70 3.5B 및 OpenAI의 GPT-XNUMX와 같은 경쟁 제품을 능가한 것으로 알려졌습니다.

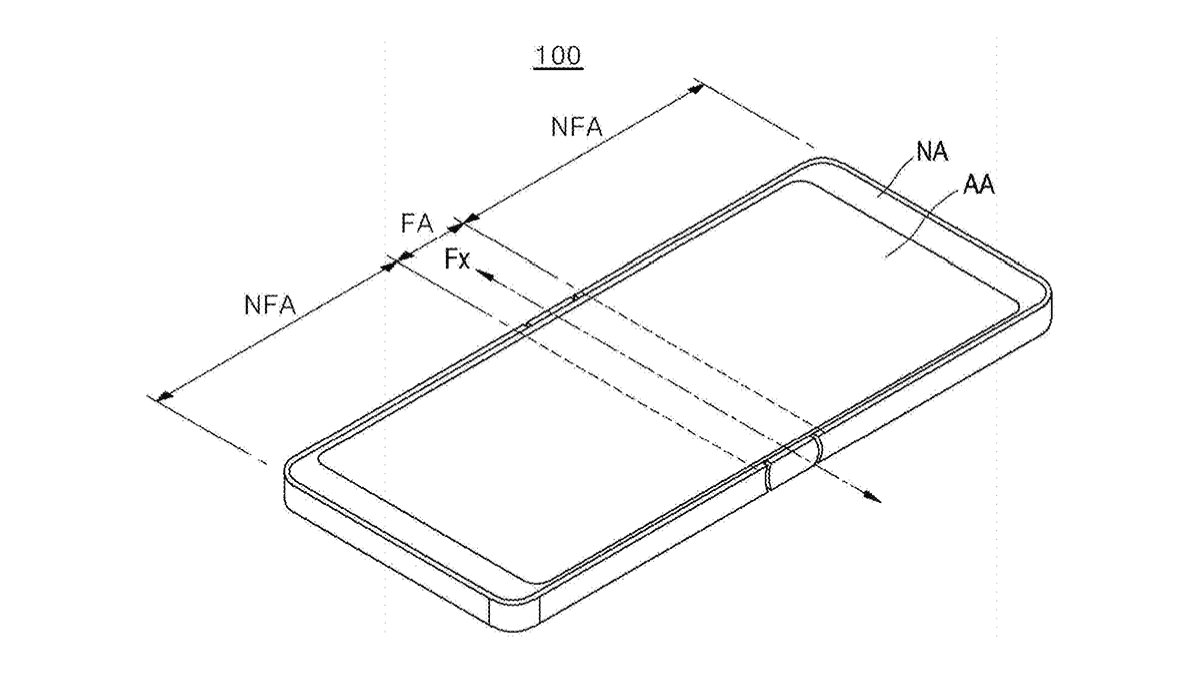

이제 Mixtral 8x22B에는 176B 매개변수와 65K 토큰의 컨텍스트 길이가 있습니다. 크기가 크더라도 각 작업에 더 작은 부품(44B)만 사용하므로 사용하기가 더 저렴합니다.

의심의 여지 없이 AI 업계에서 가장 바쁜 24시간 중 하나였습니다. 구글이 드디어 해냈다 Gemini 1.5 Pro 사용 가능 대부분의 국가에서 개발자용 Duet AI의 브랜드를 다음과 같이 변경했습니다. 제미니 코드 지원, 인프라를 Codey에서 Gemini로 이전합니다.

메타가 전하는 또 다른 소식, 정보 Facebook 소유자가 다음 주에 더 작은 Llama 3 버전을 출시할 준비가 되었다고 독점적으로 보고했습니다.

사용자 포럼

0 메시지