Microsoft Azure AI, LLM 조작 방지를 위한 'Prompt Shields' 공개

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

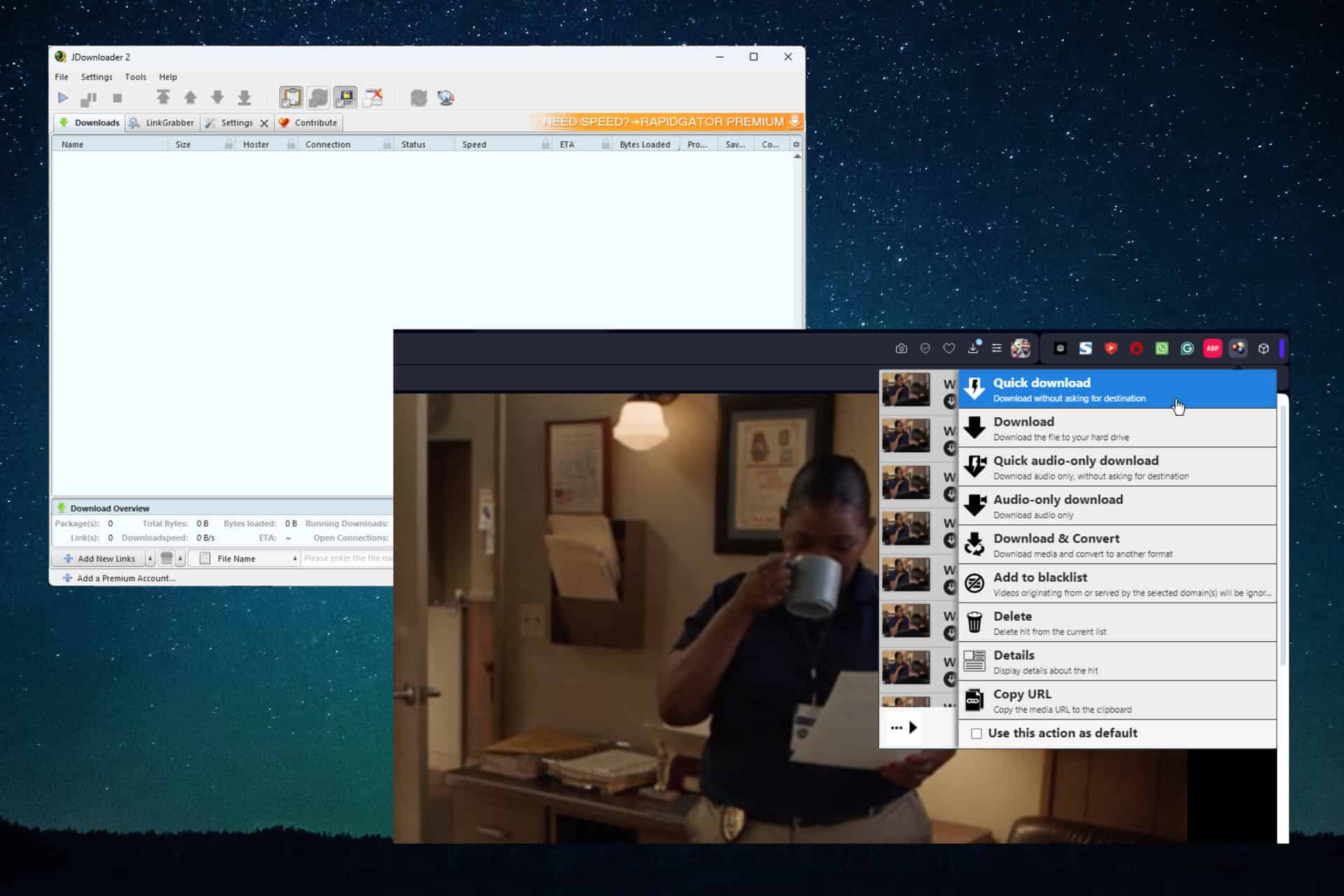

오늘 마이크로 소프트 발표 Azure OpenAI Service 및 Azure AI Content Safety 플랫폼에 대한 보안이 크게 향상되었습니다. "Prompt Shields"라고 불리는 이 새로운 기능은 LLM(대형 언어 모델)을 표적으로 삼아 점점 더 정교해지는 공격에 대한 강력한 방어 기능을 제공합니다.

Prompt Shields는 다음으로부터 보호합니다.

- 직접 공격: 탈옥 공격이라고도 하는 이러한 시도는 LLM에 안전 프로토콜을 무시하거나 악의적인 작업을 수행하도록 명시적으로 지시합니다.

- 간접 공격: 이러한 공격은 LLM을 속여 바람직하지 않은 동작을 하도록 속이는 것을 목표로 겉보기에는 정상적인 텍스트에 유해한 지침을 미묘하게 포함시킵니다.

Prompt Shields는 Azure OpenAI Service 콘텐츠 필터와 통합되어 있으며 Azure AI Content Safety에서 사용할 수 있습니다. 고급 기계 학습 알고리즘과 자연어 처리 덕분에 Prompt Shields는 사용자 프롬프트 및 타사 데이터에서 잠재적인 위협을 식별하고 무력화할 수 있습니다.

주목: 새로운 방어 기술

Microsoft는 또한 간접 공격을 방지하기 위해 설계된 전문적인 프롬프트 엔지니어링 접근 방식인 "Spotlighting"을 도입했습니다. 구분 및 데이터 표시와 같은 스포트라이트 기술은 LLM이 합법적인 지침과 잠재적으로 유해한 내장 명령을 명확하게 구별하는 데 도움이 됩니다.

유효성

Prompt Shields는 현재 Azure AI 콘텐츠 안전의 일부로 공개 미리 보기로 제공되며 1월 XNUMX일에 Azure OpenAI 서비스 내에서 사용할 수 있습니다. 가까운 시일 내에 Azure AI Studio로의 통합이 계획되어 있습니다.