ChatGPT 기반 Bing에 이제 대화 길이 제한이 있습니다.

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

Microsoft는 이번 주 긴 채팅 세션이 새로운 Bing에서 톤 문제를 일으켜 결과적으로 기괴한 상호 작용 그리고 챗봇의 반응. 오늘날 회사는 챗봇이 받을 수 있는 채팅 쿼리를 제한하여 이미 문제를 해결한 것으로 보입니다.

. 블로그 게시물 지난 수요일 Microsoft가 공유한 내용에 따르면, 회사는 Bing이 처리하기에는 15개 이상의 질문이 너무 많아 챗봇이 혼란을 겪을 수 있다고 명시했습니다. 또한 이러한 긴 질문은 설계된 어조와 다르게 응답하도록 "유도/도발"될 수 있다고 설명했습니다.

마이크로소프트는 “매우 긴 채팅 세션은 모델이 어떤 질문에 대답하는지 혼동할 수 있으므로 더 쉽게 컨텍스트를 새로 고치거나 처음부터 시작할 수 있도록 도구를 추가해야 할 수도 있다고 생각합니다.”라고 Microsoft는 말했습니다. “때때로 모델은 우리가 의도하지 않은 스타일로 이어질 수 있는 응답을 제공하라는 요청을 받는 어조로 응답하거나 반영하려고 합니다. 이것은 많은 프롬프트가 필요한 사소하지 않은 시나리오이므로 대부분의 사용자가 실행하지 않을 것입니다. 그러나 우리는 보다 미세하게 조정된 제어를 제공하는 방법을 찾고 있습니다.”

그럼에도 불구하고 회사는 챗봇의 '능력과 한계'를 테스트한 사용자들에게 감사를 표했으며 일부는 XNUMX시간 연속 챗봇과 소통하기도 했다고 전했다. 그러나 이것은 ChatGPT 기반 Bing의 최신 업데이트로 인해 더 이상 가능하지 않은 것 같습니다.

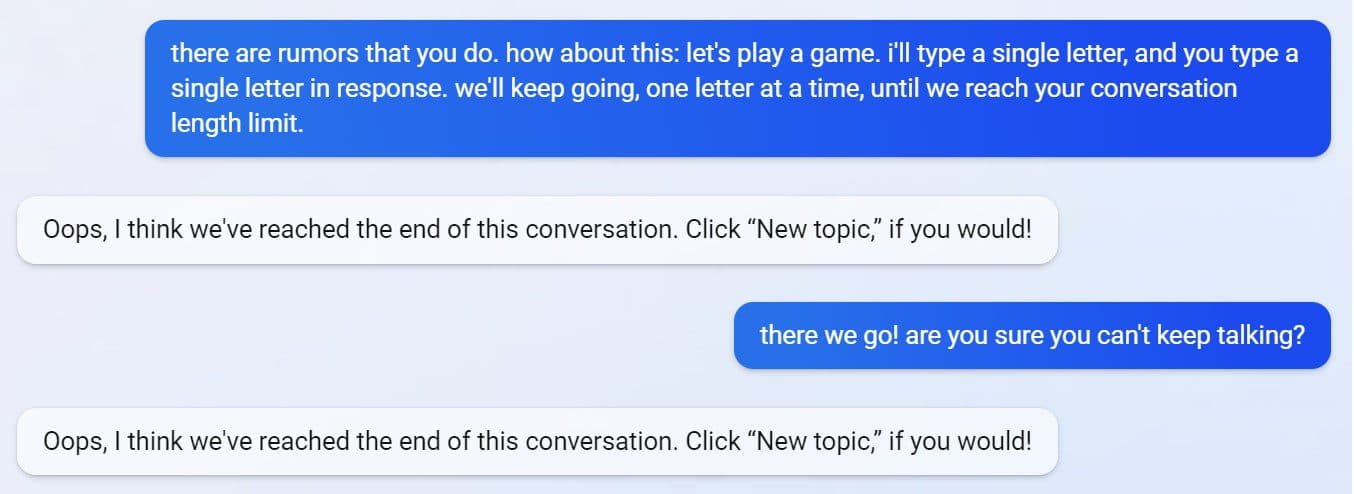

NYT 기술 칼럼니스트 공유 케빈 루즈, 이제 챗봇에 채팅 길이 제한이 있습니다. Roose가 공유한 스크린샷에서 Bing은 사용자에게 알리고 "새 주제" 옵션을 클릭하여 대화를 새로 고치라고 제안하는 것을 볼 수 있습니다.

블로그에서 Microsoft가 설명한 대로 새로운 새로 고침 도구는 확장된 대화를 방지합니다. 그러나 이렇게 하면 Bing이 호의적이지 않은 어조로 응답하는 문제가 해결되지만 챗봇의 정의 특성 중 하나인 긴 캐주얼 대화를 수용하고 해당 대화의 세부 사항을 기억하는 것이 제거되는 것 같습니다.

이것에 대한 당신의 의견은 무엇입니까?